自從 OpenClaw 掀起開源 AI 代理熱潮,最近一個名為 claws 的新名詞也隨之出現。隨著AI 代理的應用愈來愈廣泛,這類工具的安全隱憂也開始浮出水面,近期 一名 Meta 內部人員運用AI代理而誤刪郵件的意外,也讓 AI 助理的權限控管問題更加受到重視,並尋求更安全的替代方案。

AI 代理人新名詞 claws 是甚麼?

在 OpenClaw 大紅後,「claws」被用來泛指具備自主行動能力的 AI 代理人,也就是能夠直接與作業系統互動,執行開啟檔案、發送郵件或撰寫程式碼等任務的 AI 應用程式集合,如果運用得當能夠大幅提升生產力,但若缺乏適當的隔離機制,AI 可能會對系統產生不可逆的影響。

Meta 研究員郵件遭刪事件引發安全關注

根據之前 TechCruch 這篇報導,一名 Meta 的 AI 安全研究員在利用 OpenClaw 代理人時,發生了自動刪除收件匣所有郵件的意外,這起事件反映出,當 AI 代理人獲得過高系統權限卻缺乏完善的防護機制時,就很可能會發生 AI 濫權或誤操作的情況。如果能在執行任務前進行有效的環境隔離,就能夠更安全地使用 AI 工具,避免AI代理人對個人資料造成損害。

追求更安全且輕量化的開源 AI 代理人替代方案

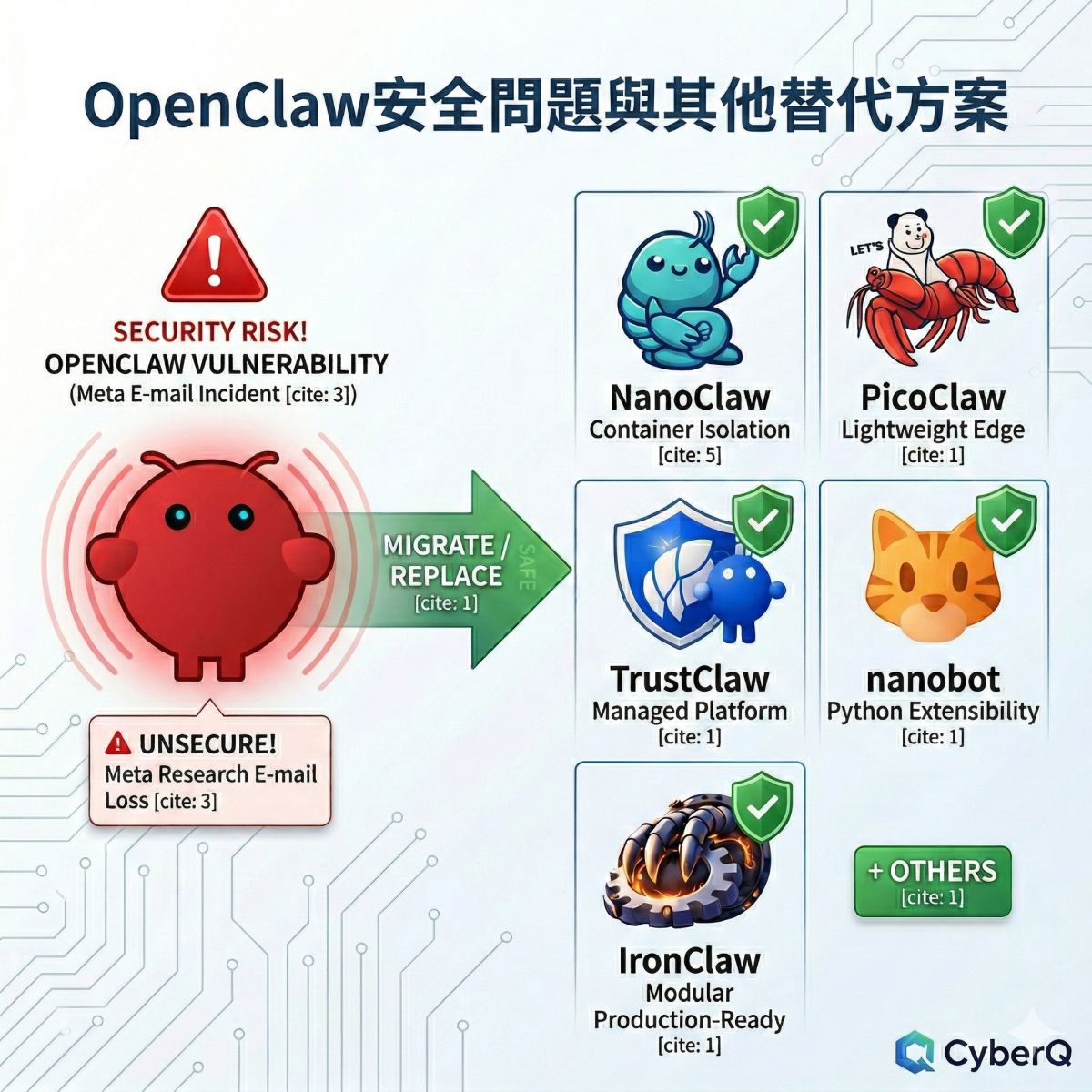

為了降低潛在風險,許多開發者開始轉向更輕量且注重安全性的替代方案。根據 KDnuggets 這篇 5 Lightweight and Secure OpenClaw Alternatives to Try Right Now ,目前有五款值得關注的開源 AI 代理人選擇,包含 Nanoclaw、PicoClaw、TrustClaw、NanoBot 與 IronClaw,這些工具在設計上更強調權限控管與資源使用的精簡性。這類方案讓使用者能更安心地在本機端測試 AI 功能,而不必擔心整個作業系統的控制權被代理人全數接管。

這五款工具各具特色,能滿足不同情境的自動化需求。首先是 Nanoclaw,這是一款專為安全隔離設計的工具,適合需要強大防護環境的開發團隊。其次是 CyberQ 實作報導過的 PicoClaw,強調極致的速度與可攜性,能輕易建置於邊緣裝置或本機環境中。TrustClaw 則採取平台化策略,提供受管理的結構化環境,讓使用者無需面對複雜的系統維護工作。

若開發者偏好 Python 生態系,NanoBot 提供了結構精簡且便於稽核的程式碼架構。最後則是 IronClaw,它採用模組化設計,為建置生產等級的自動化流程提供穩固基礎。

Nanoclaw 以容器隔離與極簡哲學解決安全問題

在這些方案中,Nanoclaw 的設計邏輯最受矚目。不同於 OpenClaw 將所有任務執行在單一進程且共享記憶體,Nanoclaw 的核心在於環境隔離。它將 AI 代理人的執行過程鎖定在 Linux 容器(如 Docker 或 Apple Container)內,如此一來,即便 AI 代理人因判斷錯誤而執行了具破壞性的指令,也無法越過容器邊界存取主機的機密資料。

Nanoclaw 的優勢還有其極簡的程式碼規模,核心程式碼只有四千多行,且運作邏輯透明。透過檔案系統隔離機制,代理人僅能存取被明確授權掛載的資料夾,這從根本上杜絕了 AI 代理人濫用系統權限的可能性。此外,Nanoclaw 同樣支援常見訊息平台整合(如 WhatsApp)、具備記憶功能,並可排程執行背景任務,甚至能與 Anthropic Agents SDK 整合,方便開發者在 Claude 基礎上建構自動化工作流。

在自定義方面,Nanoclaw 捨棄了傳統軟體常見的繁瑣設定檔案,而是鼓勵使用者透過修改程式碼來進行功能調整。使用者可以利用 Claude Code 來協助調整系統行為,確保程式碼只包含必要的組件,這麼做還能有效避免軟體肥大,是一種極致的 AI 原生設計。

安全性不應是 AI 自動化的犧牲品

對於科技領域而言,AI 代理人的出現無疑是一場生產力革命,但 CyberQ 也觀察到,許多開發者在追求功能強大的同時,忽略了權限邊界的重要性。OpenClaw 的架構雖然功能豐富,但其過於龐大的原始碼與共用記憶體的設計,使得安全稽核變得極為困難。

CyberQ 認為,未來的 AI 代理人趨勢將朝向極簡化與環境隔離發展。Nanoclaw 說明了一件事,好的安全設計不應依賴應用層的檢查清單,而應直接在作業系統層級預先進行硬性隔離。對於企業或個人使用者來說,將 AI 代理人放進容器內執行,不但能夠防範程式誤操作,更可以說是保護數位資產的最後一道防線。在 AI 權限日益增加的時代,保持程式碼的可讀性與環境的獨立性,是相對穩健的發展策略,值得實作與部署探究。

首圖由 Nano Banana AI 生成