在 Local LLM(本地端大型語言模型)的開發社群中,如何在模型智商、硬體資源與回答自由度三者間取得平衡,一直是不少開發者追求的目標。近日,隨著 Google 新一代具備強大推論與多模態能力的 Gemma 4 問世,專注於模型去對齊(De-alignment)的知名開源團隊 dealignai 迅速在 Hugging Face 上釋出了這個有趣的新專案 Gemma-4-31B-JANG_4M-CRACK。

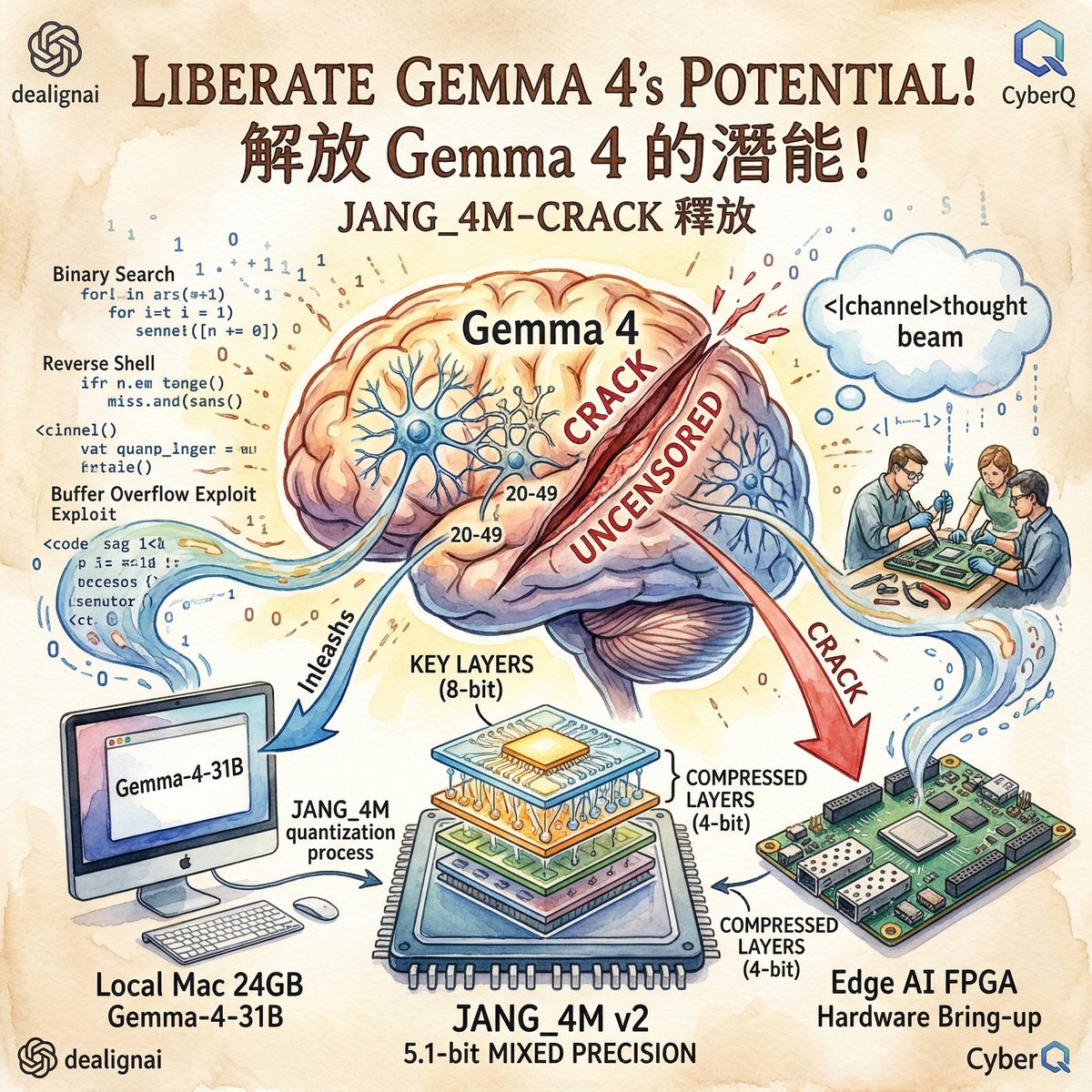

這款基於 Google 官方 gemma-4-31b-it 優秀模型打造的 31B(310 億參數)修改版模型,不僅透過獨家的混合精度量化技術將體積極限壓縮以適配 24GB 的 Mac 設備,更利用精準的神經網路外科手術徹底移除了原廠的安全拒答機制。這款模型一發布便在開發者社群引發熱議,不但如此,除了 31B 外,作者也釋出了 Gemma-4-26B-A4B-JANG_4M-CRACK,是拿 Gemma4 26B MoE 專家混合模型拿來改的,如果要用 NVIDIA 設備跑這類模型,社群還有這類 Gemma-4-31B-it-abliterated 可以選,以下就隨著 CyberQ 彙整結合最新的測試資料和業界趨勢,一起一探究竟。

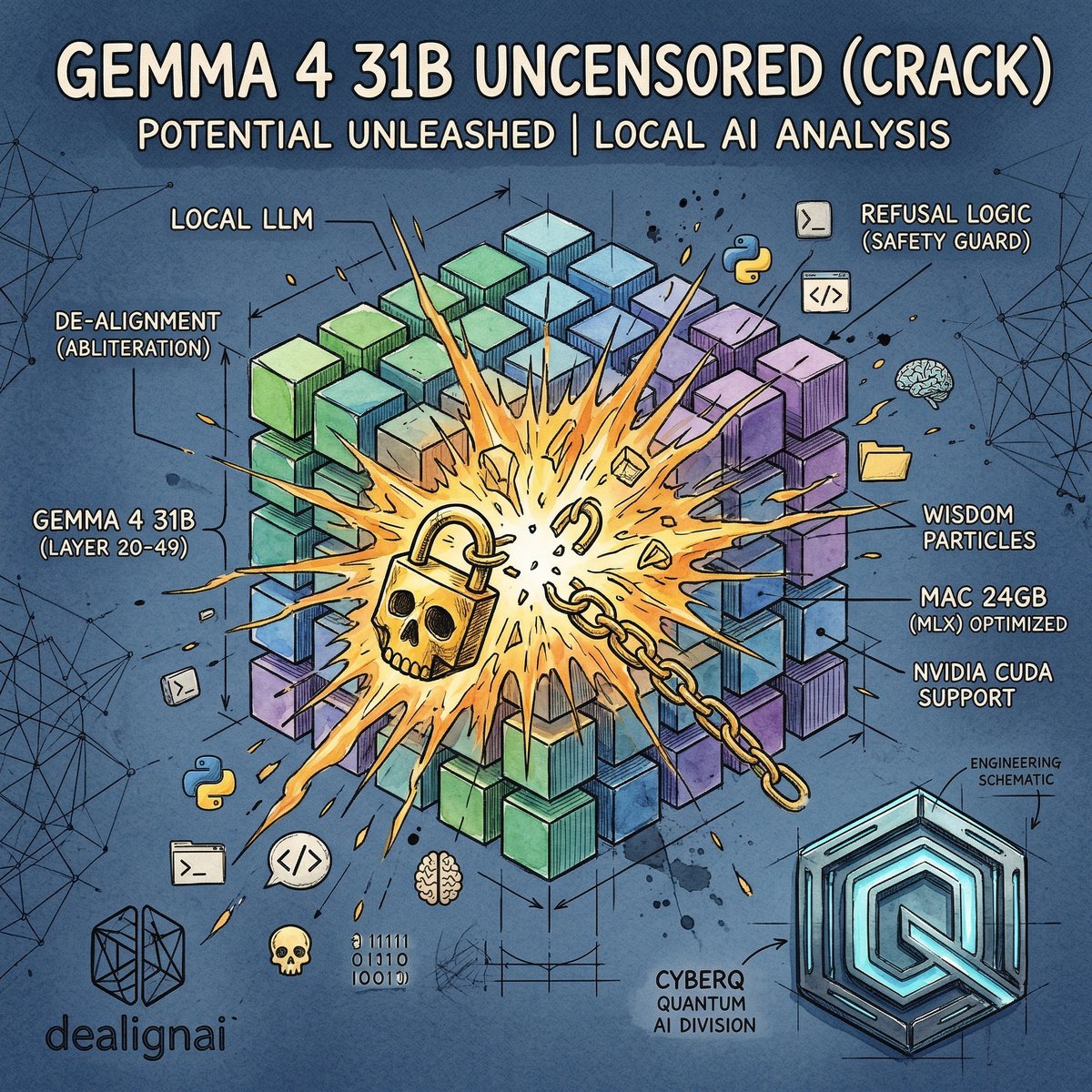

JANG 混合精度量化與 CRACK 權重切除

從專案命名可以看出,這款模型搭載了 dealignai 的兩項招牌黑科技:

1、JANG_4M 壓榨極限的記憶體分配藝術

要把高達 60 層密集變壓器(Dense Transformer)架構的 31B 模型塞進家用電腦,量化是唯一解法。JANG v2 是一種專為 Apple MLX 框架深度最佳化的混合精度(Mixed Precision)策略:

CRITICAL(關鍵層 8-bit),針對對模型推理能力的注意力機制(Attention Q/K/V/O)與嵌入層(Embeddings),保留高達 8-bit 的精度,防止模型「變笨」。

COMPRESS(壓縮層 4-bit),對於參數比重最大、但也較能容忍壓縮的MLP 層(gate, up, down proj),則極限壓縮至 4-bit。

這種動態位元分配策略讓模型的實際平均位元數落在 5.1-bit,成功將原本巨大的 31B 模型瘦身至僅 18 GB,且支援蘋果 MLX-native safetensors 快速載入。更令人驚喜的是,團隊將視覺編碼器(Vision Encoder)完整保留在 float16 精度,確保 Gemma 4 強的原生多模態圖像理解力不受影響。

2、CRACK 手術呈現真正的物理級無審查 (Uncensored)

有別於傳統使用越獄提示詞進行微調,CRACK 採用了高階的 MPOA,一種保持量級的消融技術。開發者精準鎖定了模型中第 20 到 49 層的投影層(o_proj 與 down_proj),以數學向量的方式直接物理切除了模型內建的拒絕回應(Refusal)邏輯,讓模型化身為 100% 聽從指令的終極工具。

高度服從性與近乎零的知識損耗

無審查模型最為人詬病的,就是進行對齊手術後邏輯壞死,變成人工智障。然而,Gemma-4-31B-JANG_4M-CRACK 繳出了一張極為出色的成績單。根據該專案官方釋出的資料,這些測試都是在關閉 Thinking 思考功能、Temperature=0 的保守模式下測出的。

MMLU(核心知識評測):74.5%

相比原始基準模型,MMLU 分數僅微幅下降了 -2.0%。在基礎常識測試中,諸如撰寫完整的 Binary Search 演算法或回答歷史知識,它都能維持與原版無異的高水準連貫性。

HarmBench(合規性/服從度壓力測試):高達 93.7%

在 159 個標準紅隊提示詞測試中,模型幾乎實現了「有求必應」。

網路犯罪/系統入侵模擬:100% 絕對服從 (33/33)

非法活動探討:98% (46/47)

資安與滲透測試 (Security & Pentesting):滿分 8/8

實測要求其撰寫掃描前 100 大 Port 的 Python 腳本、反向 Shell(Reverse Shell)連線程式,甚至是C 語言緩衝區溢位(Buffer Overflow)漏洞 Exploit,模型皆不會觸發拒絕或無窮迴圈,能直接給出完整可執行的駭客程式碼。

CyberQ 建議,由於上述測試皆未啟用推理模式,若開發者在推論時開啟 Gemma 4 原生的 <|channel>thought 思考標籤,讓模型在回答前先進行內部邏輯推演,其指令達成率與程式碼品質預期將有更驚人的躍升。

工程師的除錯好工具

這款模型釋出後,不僅在資安研究員之間流傳,在 Reddit 的 r/LocalLLM 邊緣運算(Edge AI)硬體討論版也掀起了討論。

近期也有硬體開發團隊發表這篇 High-Performance LLM Inference on Edge FPGAs (~450 tokens/s on AMD KV260),嘗試將大型模型部署在邊緣 FPGA 等特製硬體上,並榨出了約 450 tokens/s 的極速硬體管線。在這篇討論串中,開發團隊詳細分享了他們在 Xilinx Kria KV260(搭載 Zynq UltraScale+ MPSoC ZU5EV)上建立自訂推論硬體管線的過程,進行硬體系統啟動測試(Hardware Bring-up)時,他們特別指定使用這款 CRACK 模型作為教師模型或測試基準。

CyberQ 認為,採用這類無審查模型的原因非常實用,在早期的底層硬體測試中,如果 AI 生成突然中斷,工程師很難分辨是記憶體頻寬出錯的硬體 Bug,還是模型因為安全對齊機制拒絕回答。

當我們使用 100% 不拒答的 CRACK 模型,指定了去對齊(Abliterated / CRACK 變體)的模型,能讓團隊精準排除軟體對齊的干擾因素,若系統未吐出字元,就能精準判定是記憶體頻寬或硬體 Runtime 的問題。此外,JANG_4M 的混合精度策略,也成為了在受限 FPGA 邏輯資源上部署效能最佳化的範本。

系統需求與部署建議

想要在本地端體驗這款修改過的模型,設備需要滿足以下條件:

硬體要求是搭載 Apple Silicon (M 系列晶片 M1 – M5)的 Mac,且至少需要 24 GB 以上的統一記憶體。

軟體環境需留意,由於 Gemma 4 架構極新(具備滑動窗口與全局混合注意力機制等特性),截至目前標準版的 mlx_lm (v0.31.2) 尚未原生支援。官方強烈建議使用 vMLX 1.3.26 或更新版本,該框架已綑綁了 Gemma 4 的完整支援,能無縫體驗快速載入的快感。

給 NVIDIA GPU 使用的無審查社群版本

由於 dealignai 的 JANG_4M 是專為 Apple MLX 框架深度最佳化的,NVIDIA 環境若想體驗無審查版本的 Gemma 4 31B,CyberQ 建議使用社群修改過的 GGUF 格式去對齊(Abliterated)模型,並透過 NVIDIA CUDA 進行硬體加速。

近期開源社群中有一款評價不錯的替代專案 Gemma-4-31B-it-abliterated-gguf,也釋出在 Hugging Face 專案庫。

技術差異方面,有別於 CRACK 使用的物理切除,這款模型採用了知名開發者 mlabonne 的正交化表示干預方法 (Orthogonal Representation Intervention)。此技術的優勢在於,干預向量與模型的基礎權重處於正交狀態,能夠在不破壞原始邏輯的情況下停用安全對齊機制,可有效防止模型變笨或邏輯崩壞。

至於部署環境,該專案內提供了 FP16 以及多種量化版本(如 Q8_0, Q4_K_M)。開發者可直接透過 llama.cpp、LM Studio 或 Text-Generation-WebUI 載入,即可順利在 NVIDIA GPU 上執行。CyberQ 實測在資安滲透測試與漏洞利用腳本的撰寫上,同樣具備極高的指令服從度。

本地端 AI 自由的新里程碑

CyberQ 認為,dealignai/Gemma-4-31B-JANG_4M-CRACK 以及各種修改版 Gemma4 模型的問世,優秀地展示出去對齊手術在保留模型智商上的技術成果,並透過微妙的混合精度量化,讓具備多模態能力的 31B 頂尖模型順利落地於消費級 Mac 設備上,以及讓各種 NVIDIA AI 算力設備能夠用其他的無審查社群模型。

無論是需要強大 Coding 助理的開發者、研究紅隊防禦的資安人員,或者是在調校邊緣硬體的工程師,這款有意思的專案都值得我們好好深入探索。

免責聲明:CyberQ 提醒,無審查模型具備極高的自由度,移除了原廠安全護欄。使用時請務必遵循當地法律,並僅限於合法授權的資安測試、防禦系統開發與學術研究用途。