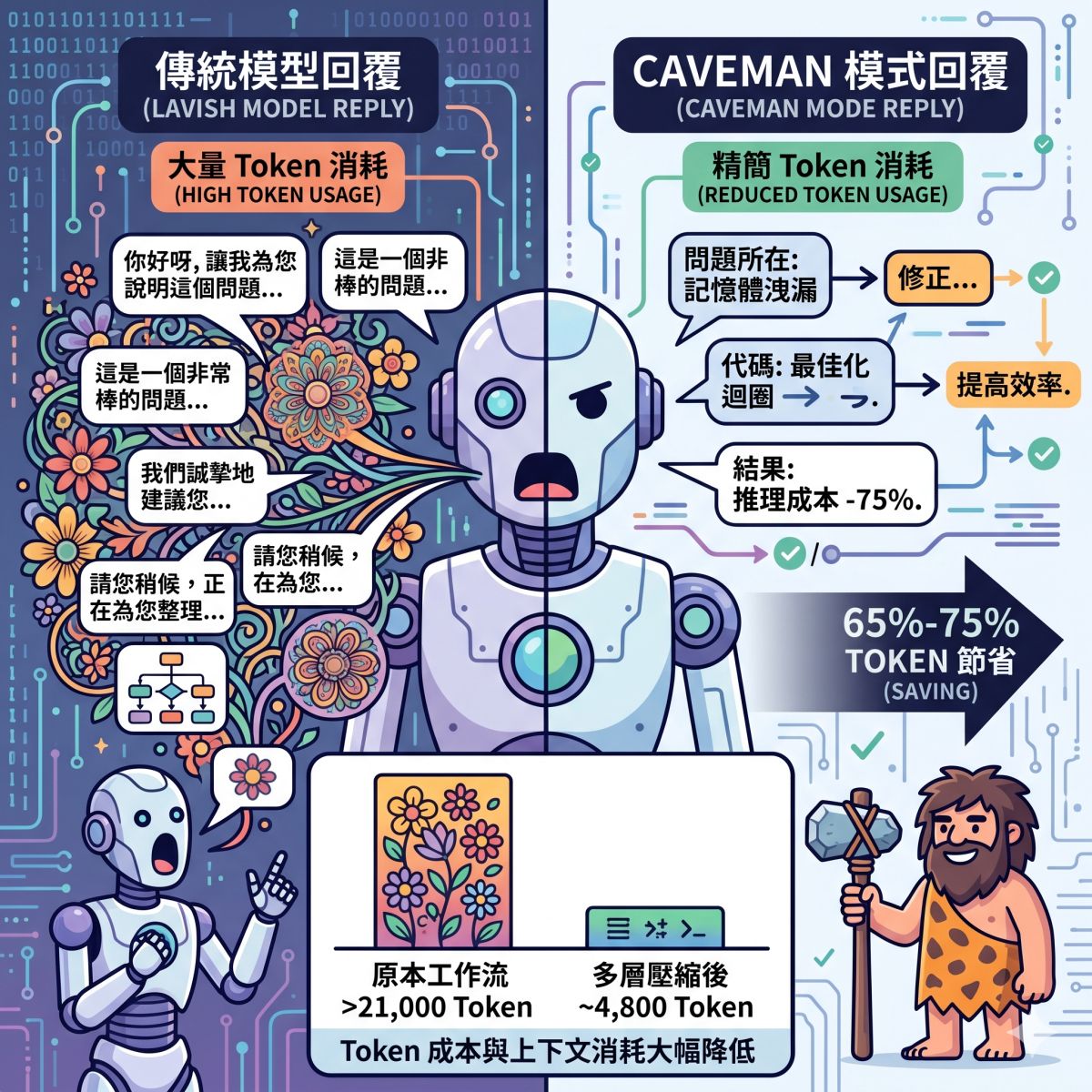

近期在 AI 開發者圈與 GitHub 社群中,一個名為 Caveman 的開源專案因為能幫助開發者省下大量Token而突然爆紅。這項專案的核心概念相當反直覺,他不要AI 提供更完整的回答,而是要求 AI 像原始人一樣說話。

根據開發者公開的資料顯示,Caveman 能在不影響技術內容正確性的情況下,減少約 65% 至 75% 的輸出 Token 消耗,這對於大量依賴 Claude Code、Codex、Cursor、Copilot 等 AI Coding Agent 的工程師來說,代表推理成本、Context Window 壓力與 API 費用都可能明顯下降。

原始人模式核心機制與 Token 壓縮原理

隨著 AI Coding Agent 進入實際開發流程,許多工程師發現大型語言模型容易浪費 Token。模型常習慣性加入大量修飾詞、禮貌用語、重複解釋與冗長推理,即使內容正確,模型的這些習性仍會持續消耗昂貴的 Context Window 與 API 額度,尤其在 Claude Code 這類型的 Agent 工作流中,模型需要反覆處理專案文件、終端機輸出與程式碼差異,此時當上下文越長,Token 成本便會迅速累積,成為開發流程中的隱性負擔。

Caveman 作者 Julius Brussee 認為 AI 回覆中存在大量語言冗餘,因此設計出這種極端壓縮風格,強迫模型只保留必要資訊的方式,這種所謂的原始人的說話模式本質上是一種 Prompt Compression 技術,也就是要求 AI 省略冠詞、刪除修飾語、避免客套話,並使用關鍵詞與箭頭來取代完整句子,例如原本需要完整敘述的內容,最後僅剩幾個關鍵字與流程指示。這種方式雖然外觀簡略,但在長時間的工作流中,確實能夠有效降低Token消耗量。

支援多款開發工具與生態系完整佈局

Caveman 擁有極高的相容性,目前已支援包含 Claude Code、Gemini CLI、Cursor、Copilot、Cline 與 Windsurf 等超過 40 種 AI 開發工具。而且使用者只需透過單行指令就能快速安裝。除了標準英文壓縮外,Caveman 甚至還提供文言文模式,利用其高度濃縮的語法特性進一步降低字元與 Token 使用量。部分開發者測試後發現,在特定開發與除錯工作流中,壓縮模式並未明顯降低技術準確性,反而能讓開發者快速掌握關鍵資訊。

目前這項專案已逐漸演變成完整的 Token 壓縮生態系,包含負責長效記憶管理的 Cavemem,以及主打自動化工作流程與規格導向開發的 Cavekit,相關工具還能生成精簡的 Git Commit 訊息與單行 Code Review 建議。官方展示案例顯示,原本超過 21,000 Token 的工作流,在多層壓縮後可降至約 4,800 Token,節省超過七成的Token使用量,能在長時間工作流中降低成本同時提升開發效率。

精簡輸出的效益與推理能力的雙重考量

許多人會擔憂過度精簡的回答是否會影響 AI 的判斷能力。CyberQ 觀察到近期 Reddit 與社群中,關於 Token 節流的討論大幅增加,部分研究指出,過長的 AI 回應有時反而可能增加推理偏移與錯誤累積,精簡的輸出在某些任務中反而有助於提升一致性。這也呼應了近年 AI 開發圈對 Token 效率的重視,將運算資源集中在問題解決上,而非浪費在轉折詞與重複描述。

然而,Caveman 並不是完全沒有副作用。部分開發者指出,當模型被強迫過度壓縮輸出時,複雜推理能力可能會下降,畢竟對大型語言模型而言,Output Token 本身也是推理過程的一部分,若無法展開完整推理鏈,可能導致邏輯跳步或遺漏邊界條件。

連 Caveman 的作者本人也坦承,在處理高風險的程式設計工作時,他未必敢完全依賴此模式。CyberQ 認為,整體而言,Caveman 的爆紅反映出 AI 產業未來的競爭核心,可能在於誰能更有效率地利用 Token 並降低推理成本,畢竟在 AI Agent 的時代,Token 已成為整個工作流的核心資源。

首圖由 Nano Banana AI 生成