NVIDIA 空間智慧實驗室(Spatial Intelligence Lab)近期發布的 Kimodo 專案,是基於運動學的動作擴散模型(Kinematic Motion Diffusion Model),Kimodo 在 GitHub 上釋出不久便迅速累積超過 1,400 顆星,受到AI 與機器人相關開發者的關注。Kimodo 能夠透過文字提示與運動學約束條件,生成高擬真度的 3D 人體與機器人動作。

技術核心與架構重點

CyberQ 觀察,在過去,生成式動作模型往往受限於公開動態捕捉資料庫的規模,導致生成的動作容易出現滑步、漂浮等不自然的物理偽影。Kimodo 的技術重點在於其採用了兩階段去噪器(Two-stage Denoiser)架構,將根節點(Root)與身體動作的預測分離。這項設計有效地減少了動作運算時的誤差,同時讓模型能夠靈活地適應各種嚴格的約束條件。

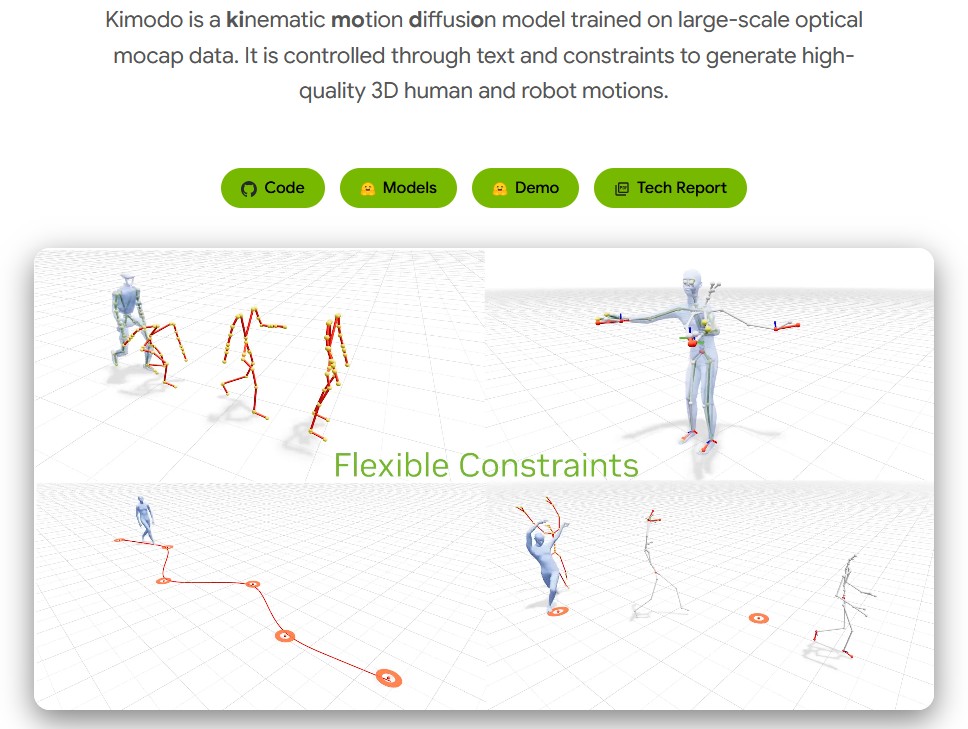

值得注意的是,NVIDIA 運用了高達 700 小時的商業級光學動態捕捉大量資料(Bones Rigplay 1)來訓練該模型。這使得 Kimodo 不僅能理解複雜的自然語言提示(例如,跳舞、與環境互動),還能精準遵循諸如全身體位關鍵影格、端點(手腳)的絕對位置與旋轉、2D 導航點以及密集路徑等空間約束條件。

開發者視角,社群反應與實務問題

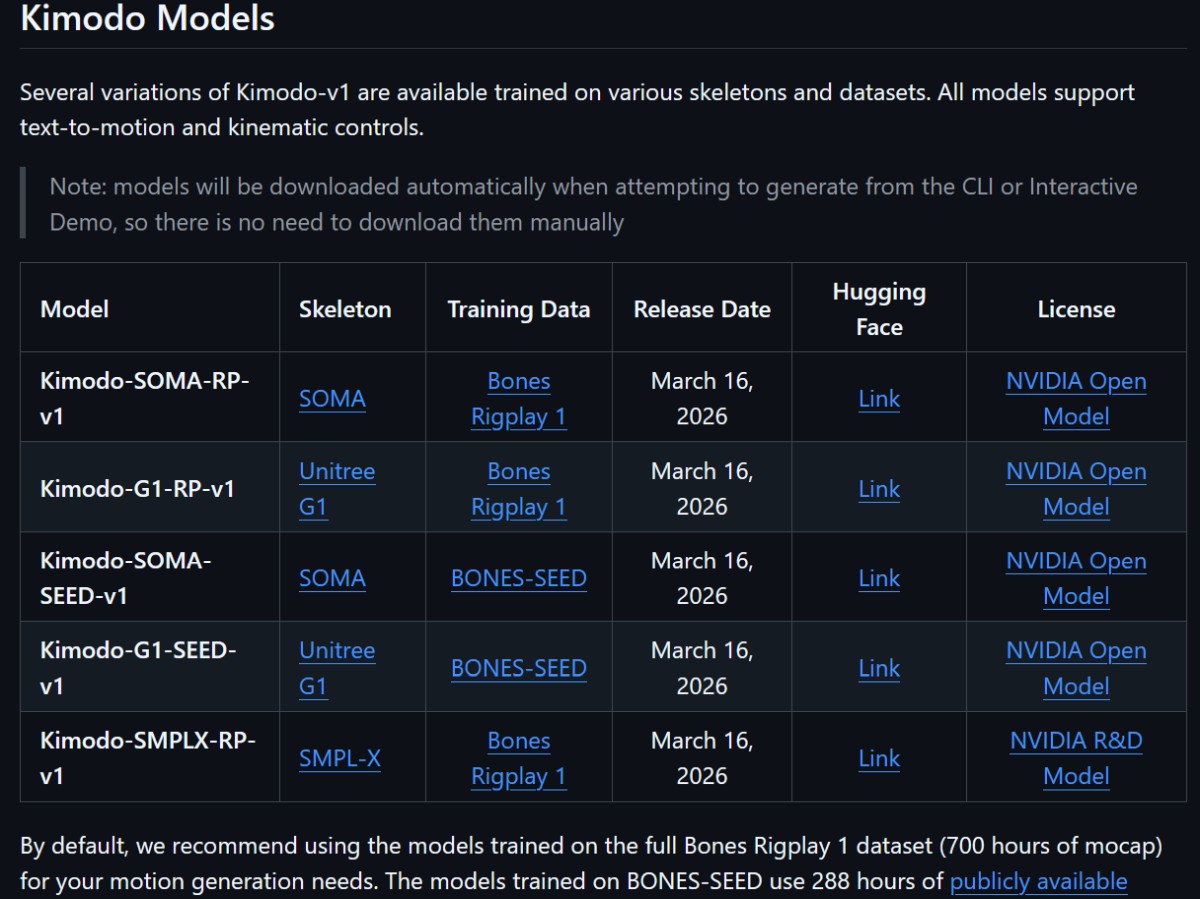

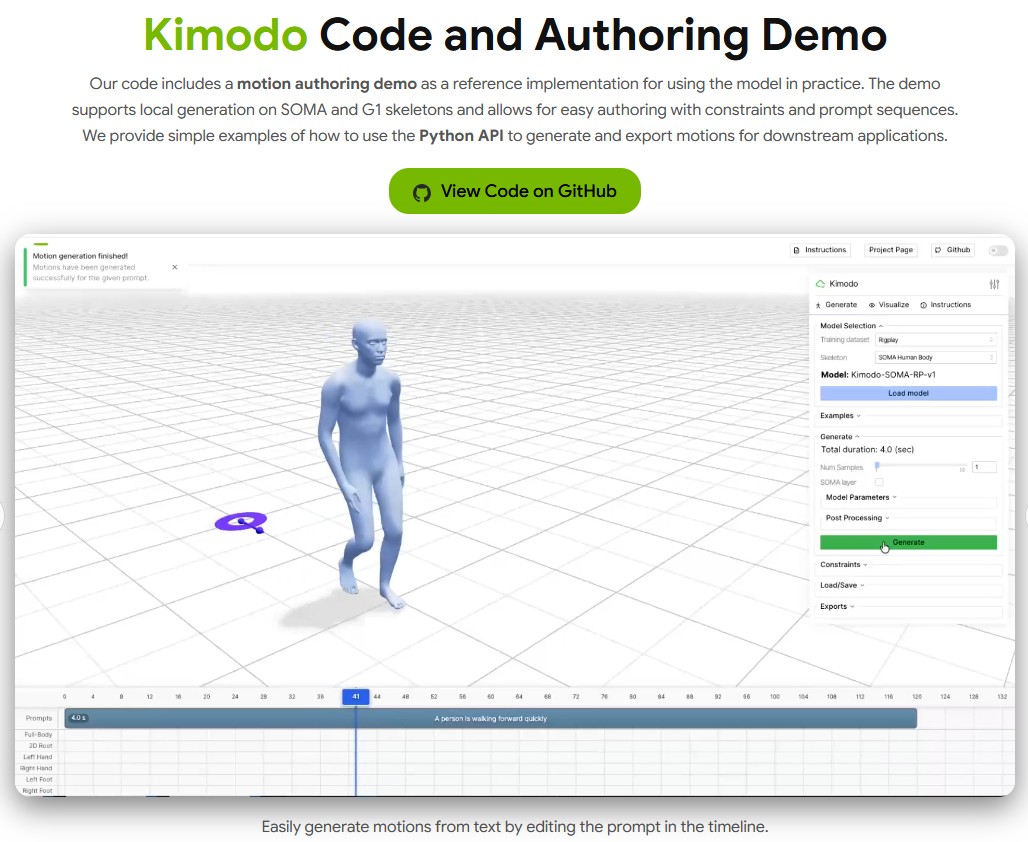

從 AI 工具程式開發的視角來看,Kimodo 提供了非常完整的開源生態。其 GitHub 儲存庫內建了基於 Web 的互動式介面(Interactive Demo)與 CLI 工具,並原生支援 SOMA、Unitree G1 與 SMPL-X 等多種骨架格式。開發者可以透過直覺的時間軸介面,編輯文字提示與約束條件,並即時預覽 3D 渲染結果。

然而,在實際部署與執行層面上,社群也面臨了一些挑戰。首先是硬體門檻,由於內建了龐大的文字嵌入模型,Kimodo 在本地端執行至少需要約 17GB 的 VRAM。對於習慣在具備 GB10 晶片等高效能運算(HPC)環境中部署大型專案的開發者來說,這點運算需求或許游刃有餘,但對依賴一般消費級顯示卡的開發者而言,這是一道必須克服的硬體門檻,通常需要配置 RTX 3090 或 4090 才能確保順暢的開發體驗。

另一個實務考量是如何將生成的動作無縫整合至下游的機器人應用中。目前 Kimodo 能將生成的動作直接匯出為 MuJoCo 的 qpos CSV 格式或 NPZ 格式,這對於後續在 ProtoMotions 框架中訓練物理策略(Physics-based policies)有極大的幫助,大幅最佳化了從虛擬生成到物理模擬的開發工作流。

資安合規與資料治理考量

在探討開源 AI 模型應用的同時,資安與合規性是企業導入時不可忽視的環節。Kimodo 的開源程式碼本身採用了相對寬鬆的 Apache 2.0 授權,但其對應的模型權重(例如針對公開資料庫 BONES-SEED 或內部資料庫 Bones Rigplay 1 所訓練的不同版本)則適用於 NVIDIA Open Model 或特定的研發授權規範。

企業在將此類工具整合進自動化產線或商業軟體時,必須嚴格審視授權邊界。特別是當這些生成的合成動作資料被用於進階訓練實體機器人控制系統時,確保訓練資料的合法性、授權範圍以及資料溯源(Data Lineage),是建立完善 AI 治理框架、避免未來智財權爭議的重要防線。

加速機器人技術商業化落地

Kimodo 是強大的動作生成工具,在實體人工智慧(Physical AI)與人形機器人領域可說是關鍵拼圖。傳統上,訓練機器人做出複雜動作需要依賴耗時、昂貴且缺乏彈性的遠端操作(Teleoperation)來收集示範資料。Kimodo 的出現,讓研發團隊能夠透過文字描述與簡單的空間路徑,以極低的成本快速生成高品質的訓練資料。

透過這種合成資料(Synthetic Data)驅動的模式,產業正跨越現實世界中資料收集的物理瓶頸。結合 NVIDIA 旗下的 SOMA 身體模型、ProtoMotions 模擬框架以及 GEAR SONIC 等專案,Kimodo 正在促成一個完整的機器人開發系統,加速人形機器人技術的成熟與商業化落地。

軟硬整合的最後一哩路

然而,要讓這些在虛擬環境中生成的複雜動作與策略真正在現實世界中發揮作用,硬體載具的配合不可或缺。這正是 NVIDIA 推出 Jetson Thor 運算平台的戰略意義。

要讓這些在虛擬環境中生成的複雜動作真正在現實世界中發揮作用,必須填補從幾何運動到物理控制,再到硬體執行的鴻溝。

首先是 NVIDIA Isaac Sim 與 Isaac Lab 的物理模擬橋樑。Kimodo 產出的純粹是運動學(Kinematics)資料,包含空間中的座標與姿態變化,但並不具備重力、摩擦力或馬達扭力等真實物理法則。開發者可以將 Kimodo 生成的高品質動作匯入 Isaac 平台中,在這個符合真實物理法則的數位雙生(Digital Twin)環境裡,虛擬機器人透過強化學習(Reinforcement Learning)練習如何出力才能完美重現 Kimodo 指示的動作,同時保持平衡並適應地形,進而訓練出強健的物理控制策略(Physics-based policies)。

接著,便是打通軟硬整合最後一哩路的 Jetson Thor 運算平台。Kimodo 在雲端或高效能工作站中扮演了虛擬訓練場的角色,快速生成龐大的合成資料。Isaac 平台負責將這些動作轉化為符合物理定律的肌肉記憶,而搭載新一代架構的 Jetson Thor,則是作為機器人的實體大腦,負責在邊緣端以極低的延遲執行這些經過複雜訓練的模型。

Kimodo 在雲端或高效能工作站中扮演了虛擬訓練場的角色,以相對較低的成本生成龐大的合成資料來訓練通用人形機器人基礎模型(如 Project GR00T),而搭載新一代架構的 Jetson Thor,則是作為機器人的實體大腦,負責在邊緣端以極低的延遲執行這些經過複雜訓練的物理策略。從 Kimodo 的動作生成、Isaac 平台的物理模擬,再到 Jetson Thor 的邊緣部署,NVIDIA 實質上已經打通了人形機器人從軟體開發、虛擬訓練到硬體落地的完整生態鏈。

CyberQ 認為,NVIDIA Kimodo 為 3D 動作生成與控制設定了不錯的技術框架,可說是解決了開發者在動作捕捉與調整上的長期問題,更為實體 AI 的規模化訓練有更好的實作。隨著底層演算法的持續最佳化與算力環境的升級,這類技術將在未來幾年內,逐步影響機器人產業、自動化模擬以及虛擬內容創作的發展軌跡。