AI 繪圖與多模態生成工作流工具 ComfyUI 近期正式釋出 v0.21.0 版本。對於長期使用 Stable Diffusion、FLUX、WAN、LTXV、ControlNet、LoRA 與各類影片生成模型的創作者與開發者來說,針對記憶體管理、圖片與影片載入、模型支援、節點相容性與 Headless Server 使用情境的系統性調整是很不錯的。

根據ComfyUI 官方 GitHub Release,更新內容涵蓋 DynamicVRAM 搭配 –cache-ram 2、改用 PyAV 取代 Pillow 載入圖片、降低 Video Tiny VAE 的峰值 VRAM 與解碼時間、支援 CogVideoX、GPTImage2 節點自訂解析度等多項變更。

CyberQ 這次分別在 RTX 5060 Ti 16GB、RTX 3060 12GB、RTX A2000、NVIDIA DGX Spark GB10,以及 QNAP NAS TS-855X 作為模型與工作流儲存節點的環境中進行測試。整體來看,v0.21.0 對於本地 AI 繪圖、複雜節點工作流、影片生成與多模型切換的穩定性確實有感改善,但這次更新的真正重點,除了 VRAM 更省,而是 ComfyUI 對系統 RAM、VRAM 與模型權重載入策略進行了更聰明的重新分工。

Dynamic VRAM 是降低系統 RAM 壓力

這次最受關注的功能之一,是 Dynamic VRAM 與 –cache-ram 2 的導入。許多使用者看到名稱時,可能會直覺認為這代表 ComfyUI 會大幅降低顯示卡 VRAM 使用量,但官方維護者其實曾明確說明,Dynamic VRAM 的主要目標是降低系統 RAM 使用量,而不是單純降低 VRAM。官方討論中也提到,Dynamic VRAM 可降低 RAM 使用、讓受記憶體限制的硬體執行更快,減少因模型權重沒有妥善卸載而造成的 OOM,並改善初次模型載入與 LoRA 套用速度,同時,VRAM 使用量變高反而可能是正常現象,因為系統正在更有效地使用 GPU 上速度更快的記憶體。

這一點對於 RTX 3060 12GB 這類仍有大量使用者的顯卡特別重要。過去在執行 FLUX、ControlNet、多 LoRA、高解析度放大,或是影片生成類工作流時,系統 RAM 與 page file 的壓力常常才是真正拖慢整體流程的原因。即便 VRAM 還沒有完全爆掉,只要模型權重在 RAM、VRAM 與磁碟之間反覆切換,生成速度就會明顯下降,甚至導致 ComfyUI 整個工作流中斷。

在 RTX 5060 Ti 16GB 測試平台上,多模型切換與複雜工作流的連續執行有改善。當工作流包含基礎模型、LoRA、ControlNet、臉部修復與高解析度放大時,首次載入仍然需要等待,但後續切換與再次執行的卡頓感有所降低。RTX 3060 12GB 則更能感受到 Dynamic VRAM 對中階顯卡的實用價值,雖然它不能讓 12GB VRAM 突然變成高階卡等級,但確實降低了複雜工作流直接報錯或中途停住的機率。

換句話說,Dynamic VRAM 不應被理解為魔法式的顯存壓縮,而是更接近一套智慧化的權重調度與記憶體壓力管理機制。對一般玩家來說,最直接的感受是工作流更不容易中途崩潰,對工作室與商業部署來說,則是長時間執行與多任務切換時的穩定性有所提升。

PyAV 取代 Pillow:圖片與影片載入流程更接近多模態工作流需求

v0.21.0 另一個值得關注的變更,是 ComfyUI 開始使用 PyAV 載入圖片,而不是過去主要仰賴 Pillow,包括使用 PyAV 載入圖片、處理 metadata rotation、支援 PNG tRNS、降低 8-bit 格式的峰值記憶體使用,以及 Video Loader Node 同時讀取音訊與影片。

這個改動對一般純文字生圖使用者可能感受不明顯,但對於大量處理素材、影片逐幀生成、參考圖批次輸入、影像轉影片、影片轉影片的工作流來說,意義相當大。過去 ComfyUI 的核心使用者多集中在圖片生成,但近一年開源影像模型已經快速往影片、3D、音訊、多模態節點發展,圖片載入不再只是讀一張圖這麼簡單,而是整個素材管線的一部分。

CyberQ 在測試中發現,若工作流只是單純文字生圖,PyAV 改動帶來的體感差異有限,但如果是批次載入參考圖、影片節點、VAE 解碼或多張圖片連續處理,整體穩定性與載入流程會更合理。這對將 ComfyUI 放在工作室生產線或自動化後端服務的人來說,比單純畫布拖曳是否更順更有價值。

Video Tiny VAE 與影片生成

隨著 WAN、LTXV、CogVideoX 等影片生成模型逐漸進入玩家與工作室的實作環境,ComfyUI 的瓶頸也從單張圖片生成,延伸到 VAE 解碼、影片幀處理、音訊同步與多段工作流銜接,降低 Video Tiny VAE 的峰值 VRAM 與解碼時間,並加入 CogVideoX 支援。

在 RTX 5060 Ti 16GB 與 RTX 3060 12GB 測試時,影片類工作流仍然比圖片生成更吃資源,特別是在解析度、幀數與模型大小提高時,硬體限制仍然很明顯。不過,v0.21.0 對 VAE 與載入流程的改動,讓部分原本容易在解碼或中後段卡住的流程變得較穩定。

開源模型生態持續擴張

ComfyUI v0.21.0 也加入 Flux2 latents 高品質預覽支援,這對調整提示詞、檢查中間輸出與修正工作流相當有幫助。FLUX 系列模型近年已經成為本地 AI 生圖的重要選項,尤其在商業視覺、封面圖、產品圖與高品質插畫生成上,有不少創作者已經將 FLUX 納入標準工作流。

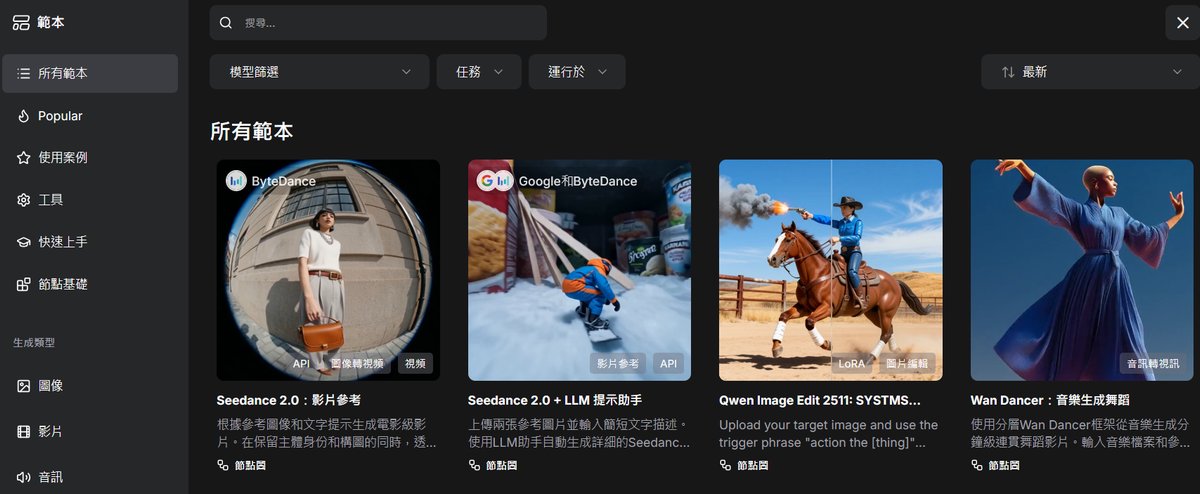

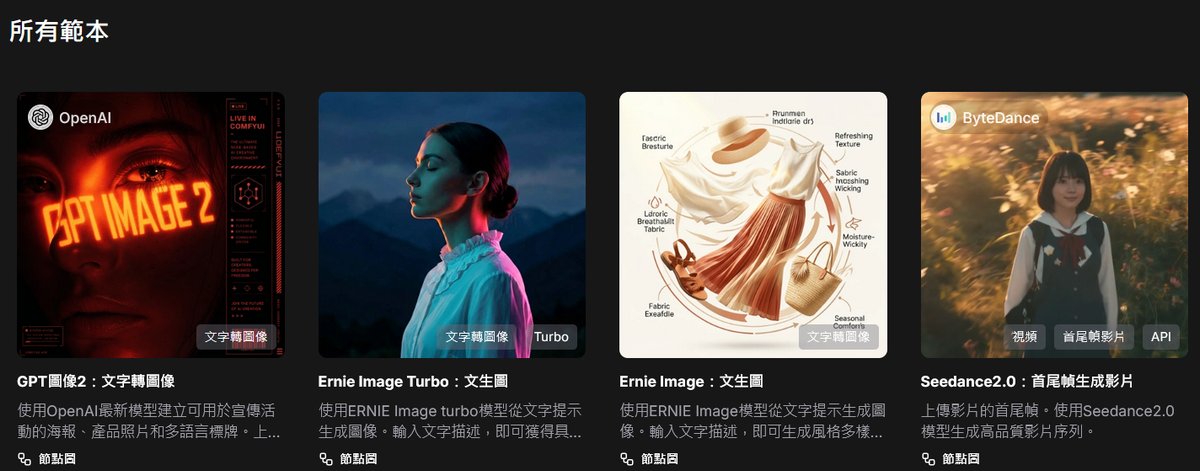

這次更新同時也包含 CogVideoX、OneTrainer ERNIE LoRA 支援、Gemma4 text generation support、GPTImage2 節點自訂解析度等變更,當模型種類變多、資料來源變複雜、產出格式涵蓋圖片、影片、音訊與 3D 時,節點式流程的可視化與可重複執行能力,反而成為它和一般 AI 工具最大的差異。

QNAP NAS 搭配 ComfyUI:模型集中管理與備份比想像中重要

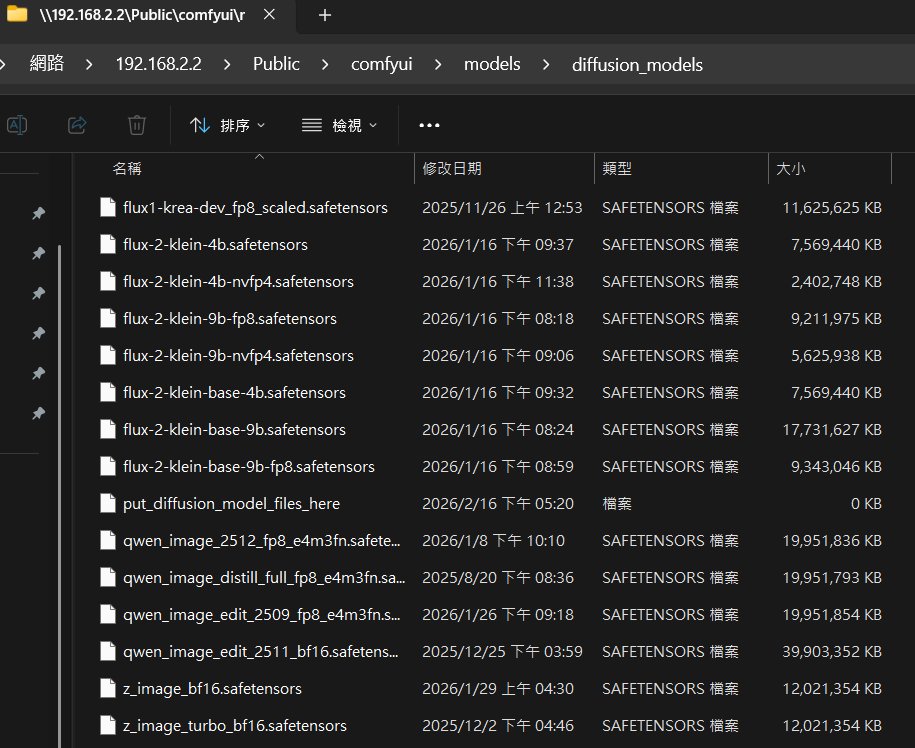

隨著 FLUX、WAN、LTXV、ControlNet、LoRA、Upscaler、VAE 與各類 Custom Nodes 模型檔案越來越多,本地 AI 繪圖環境很快就會遇到一個現實問題,模型不是幾個 GB,而是動輒數百 GB,甚至超過 1TB。這時候若每台電腦都各自下載一份模型,不僅浪費空間,也會讓版本管理與工作流同步變得混亂。

在這次測試中,QNAP NAS TS-855X 的角色不是直接取代 GPU 工作站,而是作為模型庫、工作流檔案、輸出素材與備份資料的集中儲存節點。這種架構有幾個好處,第一,模型可以集中管理,避免不同工作站各自散落版本,第二,工作流與輸出檔案可以自動備份,降低創作資料遺失風險,第三,若搭配 10GbE 或更高頻寬網路,對大型模型讀取與多設備協作會更友善。

不過,NAS 掛載模型資料夾也不是沒有代價。若使用 SMB 或 NFS 掛載模型路徑,必須注意權限、路徑一致性、檔案鎖定、延遲與網路穩定性。尤其是 ComfyUI 搭配 Custom Nodes 時,不同節點可能會假設模型在本機路徑,若路徑設計不一致,容易造成找不到模型或工作流無法跨機器重現。

CyberQ 建議,商業公司或工作室環境可以採用「NAS 集中存放模型與備份,工作站保留常用模型快取」的混合策略。常用模型可以放在本機 SSD,以確保載入速度,大型模型、歷史版本、輸出素材與工作流則放在 NAS 上集中管理。若是 DGX Spark GB10 或其他本地 AI 伺服器,則可將 NAS 作為模型倉庫,再依照實際效能決定是否同步到本機高速儲存。

UI 與前端體驗:大型工作流更適合長期維護

ComfyUI 的節點式介面向來強大,但缺點也很明顯,當工作流節點數量一多,就會變成俗稱的「義大利麵條」,看起來超複雜。v0.21.0 也持續更新 workflow templates、frontend package 與多項節點修正。

實測中,大型工作流的操作體驗仍然取決於瀏覽器、前端版本、節點數量與自定義節點品質。新版並不會自動把混亂的工作流整理乾淨,但在載入、執行與錯誤定位上,整體體驗比早期版本成熟許多,CyberQ 建議實作時,可以固定命名、分組、加上註解節點、保存可重現版本,以及把正式接案用 workflow 和實驗 workflow 分開管理。

升級前注意 Custom Nodes 仍然是最大風險

ComfyUI 的強大,很大一部分來自 Custom Nodes,但升級風險,也往往來自 Custom Nodes。v0.21.0 這類底層改動較多的版本,可能讓部分久未維護的第三方節點出現紅框錯誤、依賴版本衝突、API 不相容或模型路徑異常。

CyberQ 建議,升級前至少完成以下幾件事。

第一,備份 custom_nodes、models、input、output、user、workflows 等重要資料夾。尤其是正式商業工作流,不要只依賴瀏覽器暫存或單一 JSON 檔案。

第二,若使用 Git 版 ComfyUI,升級前先確認目前版本與本機是否有修改。若是 Windows Portable 版本,也建議整個資料夾複製一份再更新。

第三,ComfyUI Manager 的 Update All 可以作為升級前置動作,但它不是萬靈丹。部分冷門節點若原作者已經停止維護,即使更新依賴仍可能失效。

第四,正式環境與測試環境要分開。公司端、工作室、接案環境不建議直接在生產機上升級,應先複製一份 ComfyUI 到獨立資料夾,確認常用工作流都能正常跑完,再切換正式環境。

第五,若模型資料夾放在 QNAP NAS 或其他網路儲存設備上,要確認掛載路徑在所有機器上保持一致。Windows、Linux、DGX Spark GB10 與 NAS 之間若路徑命名不同,會讓同一份 workflow 在不同機器上出現找不到模型的問題。

升級建議

CyberQ 建議,對一般玩家來說,ComfyUI v0.21.0 值得升級,尤其是使用 NVIDIA GPU、經常遇到 RAM 壓力、LoRA 套用慢、模型載入等待久,或是複雜工作流容易 OOM 的使用者。RTX 3060 12GB 這類中階顯卡雖然仍有硬體天花板,但新版的記憶體調度確實讓它更適合繼續服役。

對創作者與工作室來說,用來生產封面圖、產品圖、短影片素材、廣告視覺或大量批次圖像時,少一次中途報錯,往往比單張圖快幾秒更重要。

對企業端或內部 AI 團隊來說,ComfyUI 已經可以被視為一套可編排的生成式 AI 工作流引擎。若搭配 NAS 集中儲存、GPU 工作站、DGX Spark GB10 這類本地 AI 伺服器,以及版本控管與備份策略,就能建立一套比單機玩家更接近生產線的內部 AI 影像平台。

不過,企業端也不應忽略治理問題。模型來源、授權條款、輸出素材版權、Custom Nodes 的安全性、API 金鑰管理、使用者權限、資料夾同步與備份策略,都應該納入部署規劃。ComfyUI 越強大,越需要用正式系統的角度管理。