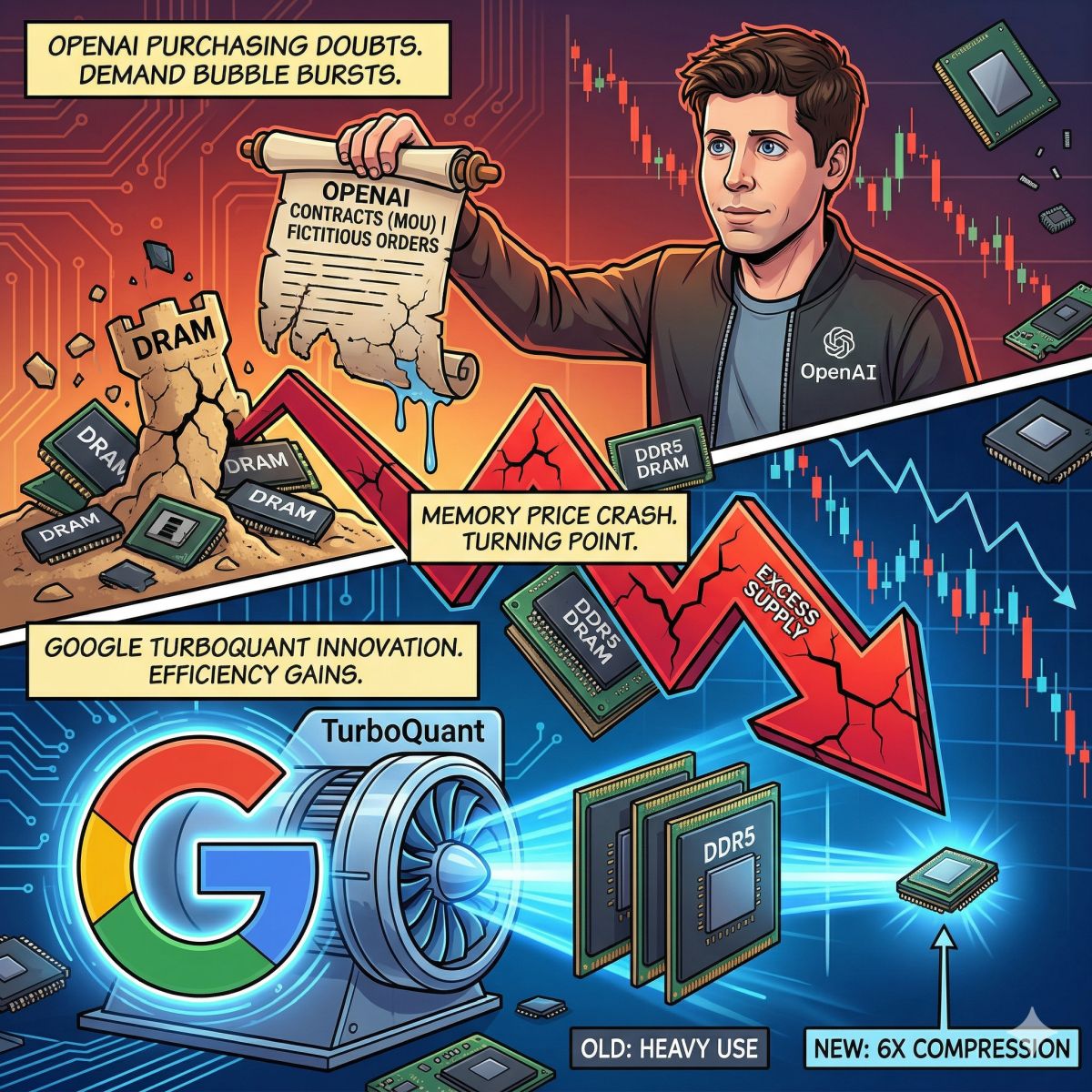

近期科技圈與金融圈均傳出多項與記憶體相關的關鍵訊息,顯示過去一年由大廠帶動的記憶體備貨需求可能存在著部份膨脹的情形。隨著 OpenAI 採購策略的調整以及 Google 、NVIDIA 與開源社群在軟體演算法上的重大進展,市場對於 DDR5 等高端儲存組件的供需預期有可能會有轉向的情況,甚至引發部分記憶體市場價格下跌的擔憂。

OpenAI 採購計畫遭質疑非實質訂單

近期在社群平台 X 上引發熱烈討論的焦點,在於 OpenAI 執行長 Sam Altman 先前對外宣稱的龐大硬體採購計畫。根據 Times of India How Sam Altman’s OpenAI may have caused the worst consumer hardware crsis with purchase orders that were never real 報導中指出多位分析師懷疑 OpenAI 與硬體大廠簽署的合約,本質上可能只是不具備法律約束力的意向書,而非實際的採購訂單。

如果這些訂單並非真實存在,過去這段時間記憶體價格的走揚,可能一部分是基於幻象的泡沫,儘管整體的需求仍舊是上升的。一旦需求比預期的少個二、三成,有可能會直接衝擊市場報價。

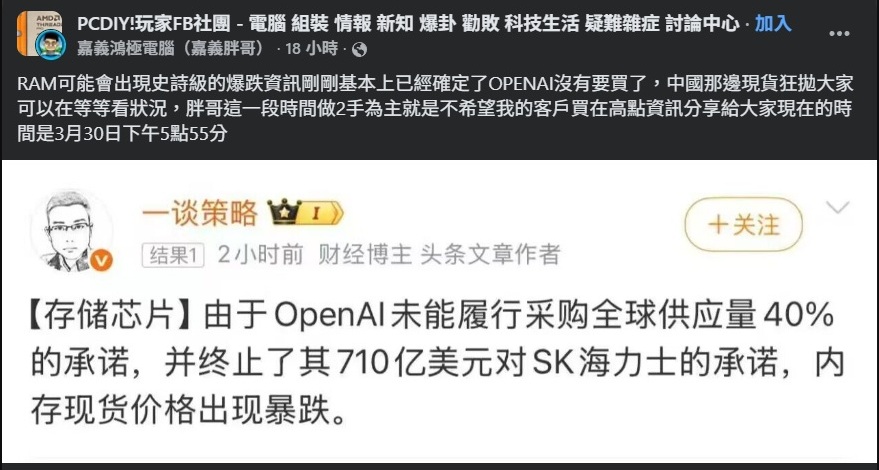

社群傳 OpenAI 終止對 SK 海力士 710 億美元協議

除了分析師的觀點,社群媒體上也正流傳著更為具體且具破壞力並未經證實的負面消息。根據部分硬體社團轉貼的資料顯示,市場正高度關注 OpenAI 是否未能履行原先記憶體採購量的承諾。

更令人震驚的傳言指出,OpenAI 可能已經終止了先前對 SK 海力士高達 710 億美元的採購協議。這項未經證實但廣為流傳的消息,中國現貨市場一度出現拋售潮,許多投資者擔心這將引發記憶體價格顯著的下跌。

Google 演算法 TurboQuant 大幅降低對記憶體的依賴

除了需求端的疑雲,技術方面的突破可能也成為影響價格的另一隻手。Google Research 近期發表的全新演算法 TurboQuant ,透過全新的資料壓縮方式,能夠將大型語言模型運算時的記憶體需求降低 6 倍,這項技術對於 AI 基礎設施的影響可說是極其深遠,這代表未來公司在布署同樣規模的 AI 模型時,不再需要耗費巨資來採購大量記憶體。而開發者社群推出類似的專案 TurboQuant+,其演算法比 Google 的 TurboQuant 更強,能壓縮更多記憶體的用量,對 AI 推論影響的程度同樣也微小,以及其他衍生的各種演算法的討論和實作,都讓記憶體價格下跌有了更多的市場討論熱度。

另外,NVIDIA 的 KVTC 技術,也可以大幅減少 AI 運算時對記憶體的需求量,並已經逐步要實作到 NVIDIA 生態系中,也很值得關注。

這項發展在 Reddit 社群對於記憶體價格泡沫的討論串中也引發廣泛關注,開發者普遍認為這項壓縮技術將使未來公司布署 AI 模型時,不再需要依賴大量的硬體採購。 VentureBeat 對於 Google 技術最佳化如何降低成本的報導 進一步提到,這種技術提升能讓運算速度加快 8 倍,同時將營收成本削減 50%。當軟體效率能以倍數成長,大廠對於硬體產能的稀缺感自然隨之消失。

市場供過於求導致 DDR5 現貨報價持續走低

受上述雙重因素夾擊,記憶體市場的價格表現已經開始反映趨勢的轉變,以 DDR5 為代表的高階記憶體產品,其現貨市場價格已經出現明顯下滑。DigitalToday 的 DDR5 prices plunge as OpenAI cuts data centre spending and boosts efficiency 一文中提到關於記憶體價格重挫與 OpenAI 支出縮減的關聯性分析,指出 OpenAI 的策略正從過去的大規模採購硬體自建資料中心轉向租賃模式,這種轉變讓資料中心對新硬體的拉貨力道大幅減弱。

CyberQ 觀點

這次記憶體價格的波動,也是讓市場思考效率優先的選項,或其他成本可降低的可能性。畢竟在過去兩年間,市場盲目追求硬體軍備競賽,認為只要有更多的 GPU 與記憶體就能換取更強大的算力,推升了記憶體、硬碟、SSD 與伺服器設備的價格。然而,當 Google 與開發者社群們都證明了能夠透過演算法能節省數倍的記憶體空間,且不會犧牲太多精確度的情況下,加上 OpenAI 這種 AI 指標性公司開始務實考量營收成本與租賃效益時,硬體供應商的議價能力必然會受到威脅。

CyberQ 認為,對台灣相關供應鏈來說,也是一個需要高度關注的發展中議題。倘若未來產能或需求有變化,如何配合軟體技術的變革,提供更具能源效率與成本優勢的解決方案,將會是維持營收穩定的關鍵。記憶體價格的崩跌並非代表 AI 需求的消失,不如說我們正在和市場一起歷經這個過度溢價的修正過程。

不過,從長期來看,AI 的需求仍舊是強勁,對 AI 算力、AI 儲存 (SSD 與硬碟) 的需求持續,但記憶體即便是需求量變小,大廠還是會採購相當數量的高速記憶體來進行訓練與推論的任務,長期需求還是看好的。畢竟,記憶體壓縮歸壓縮,如果能夠跑更大更多的模型和多樣化的綜合效果,還是會想要用高規格的設備來實現最頂尖的相關任務。

至於日常的推論需求,以及各家企業建構自己的 AI 代理人,有可能受惠於這些技術而獲得些許的成本喘息空間,讓地端 AI 陸續就位,也是不錯的發展呢。

首圖由 Nano Banana AI 生成