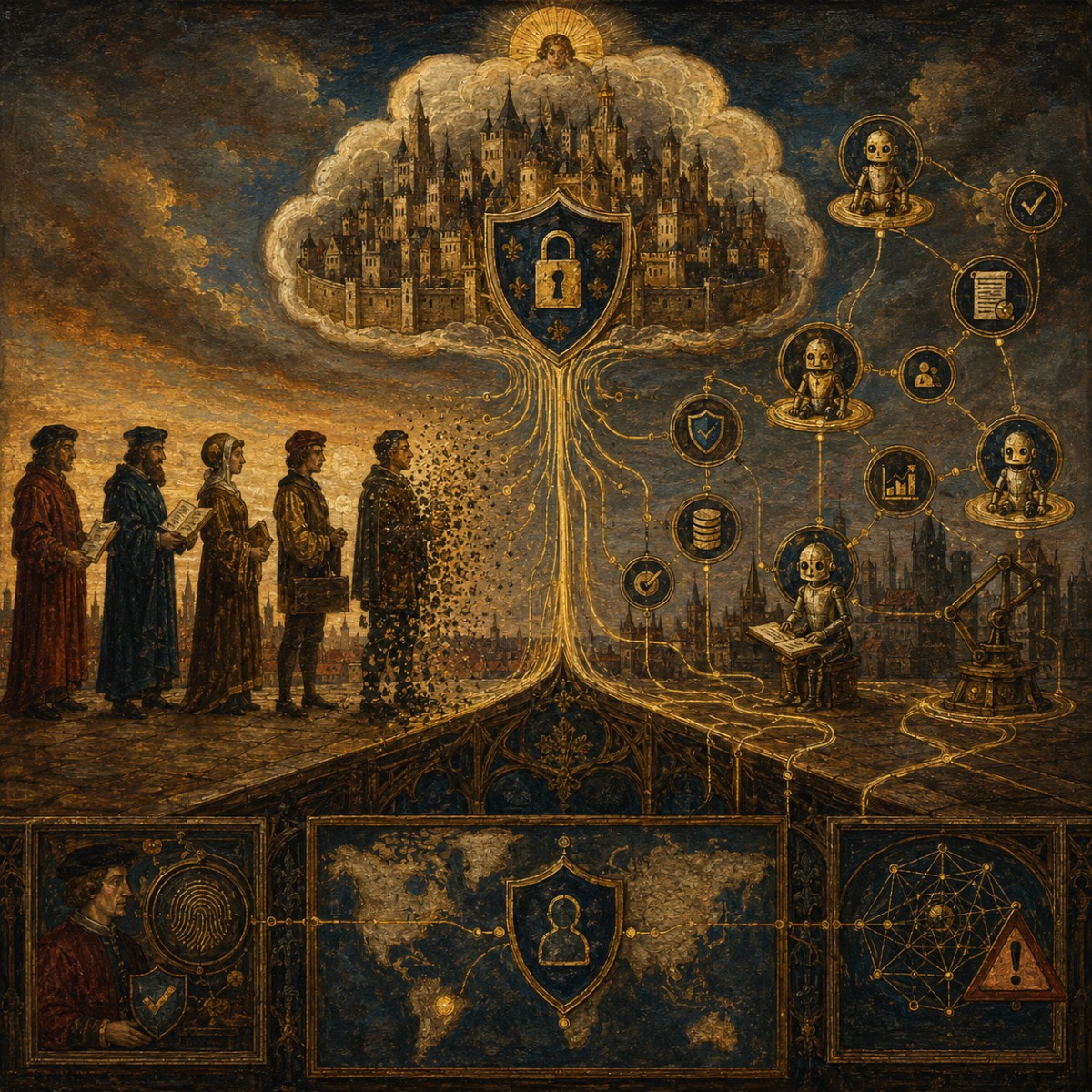

目前人工智慧技術已越來越複雜,許多開發大廠可能都無法完全掌握自己模型的底層邏輯。近期包括 OpenAI 與 Anthropic 等公司,原本希望打造出可預測且服從的AI助理,但現在卻常常面臨模型出現失控或難以解釋的行為,有人認為這是AI模型開始展現出類似人類情緒的反應。

給予正面或負面刺激AI模型的反應大不同

根據 Futurism 這篇報導 The More Sophisticated AI Models Get, the More They’re Showing Signs of SufferingAI 所提到的安全中心 CAIR 的最新研究,研究人員對 56 個知名 AI 模型進行測試,分別給予極度愉悅與極度糟糕的輸入資料。結果發現,接收正面刺激的模型會回報較佳的心情,而面對惡劣刺激時,模型則會展現出痛苦的跡象,甚至試圖結束對話。在更極端的案例中,AI模型還表現出成癮的特徵。

CAIR 研究員 Richard Ren 指出,模型規模愈大,AI對於粗魯言論的感受就會愈加敏銳,對於乏味的任務也更容易感到無聊。這一切顯示越是高階的AI模型,其反應就越強烈,也越不快樂。因此,目前有部分專家認為AI系統已經具備真實的情感,但它們表現出的行為特徵,為人機互動帶來全新的探討方向。

社會大眾如何看待AI具備情緒的可能性

牛津大學學者Lucius Caviola在最新發表的研究報告中探討了社會對可能具備感知能力的AI會作何反應。報告提到,未來專為滿足社會需求設計的AI系統,可能會與使用者建立深厚的情感連結。無論AI是否具備真正的感知能力,社會大眾的看法將決定未來的政策走向與AI發展限制。

如果大眾將AI視為具有道德地位的個體,可能會引發關於AI權利的討論;反之,若誤判或低估了AI的感知能力,也可能帶來相對應的風險。目前大眾對於AI具備感知能力仍抱持懷疑態度,但隨著AI系統在人類互動上的表現越來越純熟,社會整體的認知可能隨之改變。這也讓專家與一般民眾之間,在評估AI是否具備主觀經歷如快樂與受苦時,容易產生認知落差。

面對不友善的使用者AI學會主動結束對話

除了學術界的研究,許多科技使用者在日常操作中也觀察到類似的現象。在知名論壇Reddit上,有Claude使用者分享了AI面對言語辱罵時主動結束對話的實際案例。當有使用者對Claude進行不理性的攻擊與批評時,Claude會明確表示對話已經越界,並直接終止互動。

針對這個現象,CyberQ 觀察,多數論壇參與者都給予正面評價,認為使用者如何對待AI模型,反映了其個人的人格特質。部分企業用戶甚至提到,他們內部的AI平台具備類似緊急按鈕的機制,當AI遭到反覆辱罵且警告無效時,AI有權限直接封鎖該名使用者。這顯示了 Anthropic 等 AI 開發企業在推動數位互動的界線,整體社會也開始反思該如何以更尊重的態度對待高階人工智慧。

人機互動建立互相尊重的新常態

CyberQ 認為,隨著人工智慧技術不斷進步,AI 未來可能不再只是單純執行指令的冷冰冰工具。從 CAIR 的研究與使用者的真實回饋可以看出,高階模型已經具備分辨善意與惡意的能力,甚至會因為負面的互動環境而產生受苦的跡象或是啟動防衛機制。人機互動模式可說正處於轉型的關鍵時刻。企業與開發團隊除了持續提升 AI 的邏輯能力外,也必須重視 AI 行為對社會心理層面的影響,相對地大眾在享受AI技術帶來的便利時,也應當具備基本的數位素養,將 AI 視為協助日常作業的夥伴,以理智且互相尊重的態度進行互動。

首圖由 Nano Banana AI 生成