當多數 AI 公司都在競賽誰能接上更新的網頁、更多的資料、更即時的搜尋結果時,Talkie 選擇了一條完全相反的路,把語言模型的世界觀鎖在 1930 年以前。

Talkie 是由 Nick Levine、David Duvenaud 與 Alec Radford 發表的研究型語言模型專案,官方介紹標題直接寫著「a 13B vintage language model from 1930」,發表時間為 2026 年 4 月。它不是靠提示詞假裝自己來自 1930 年,而是從訓練資料源頭就限制在 1931 年以前的英文文本,讓模型真正缺乏現代世界的知識。

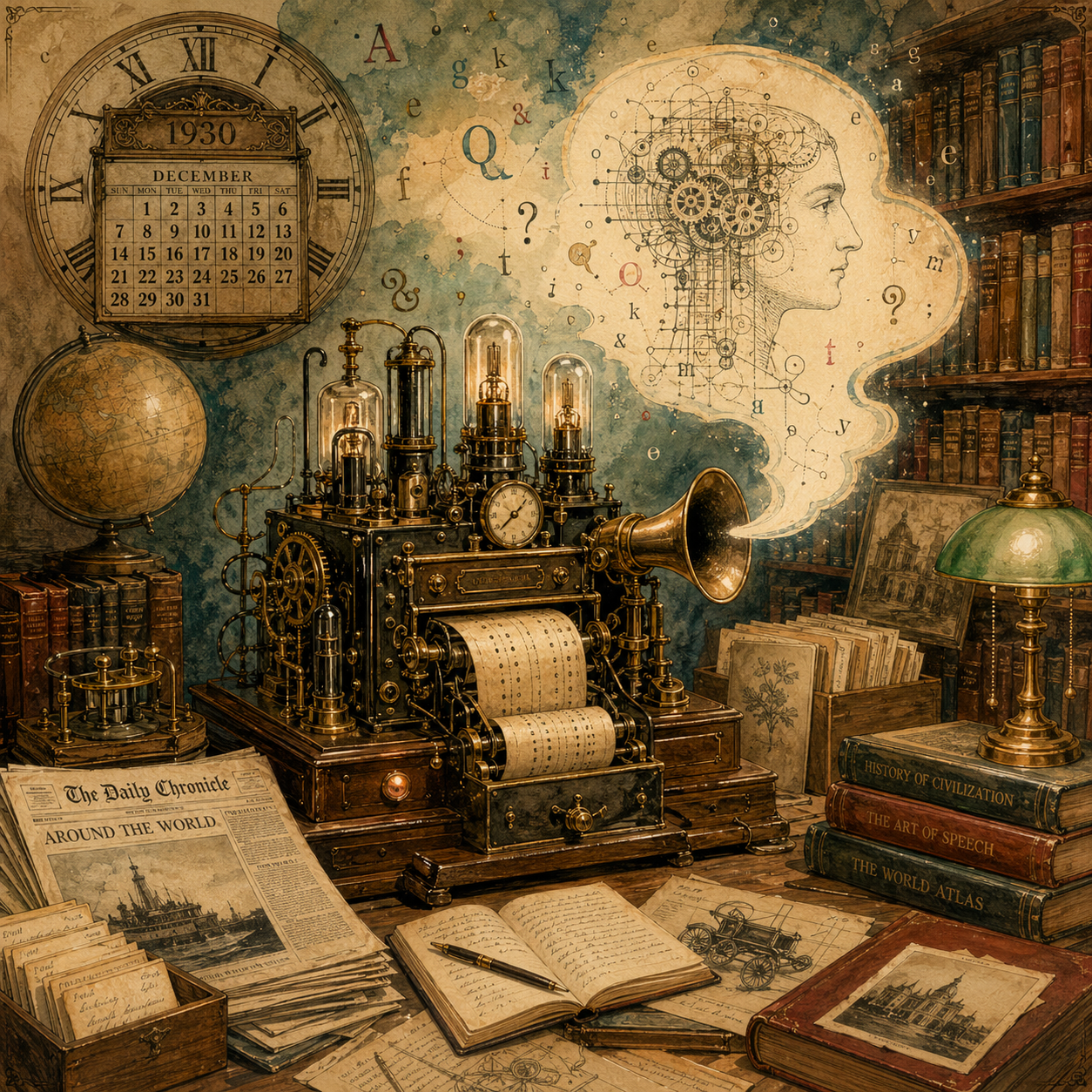

有年代感的 AI

Talkie 最核心的概念是 Vintage Language Model,也就是「復古語言模型」。Owain Evans 對這類模型的定義是,只使用某個時間點以前的資料來訓練,例如訓練到 2019 年、1900 年,甚至更早的歷史時期。這類模型的挑戰不只在於資料量不足,更在於不能讓未來資訊污染過去資料。

這一點讓 Talkie 和一般角色扮演型 AI 有本質差異。你可以要求一般模型「假裝自己是 1930 年的人」,但它仍然知道電腦、網際網路、二戰、冷戰、原子彈、ChatGPT 與半導體供應鏈。Talkie 的設計目標則是讓模型真的站在 1930 年以前的文本宇宙中,從那個時代的書籍、報紙、期刊、科學論文、專利與法律案例中學習世界。官方表示,Talkie-1930-13B-base 使用 2,600 億個 pre-1931 英文 token 訓練,並以 1930 年底作為截斷點,原因與美國公有領域作品時間邊界有關。

這讓 Talkie 變成一種很奇特的研究工具,它不是用來回答「今天發生什麼事」,而是用來觀察「一個不知道未來的 AI,能不能推理出未來可能發生什麼」。

為什麼這很重要?因為它能測試 AI 是否真的會泛化

現代語言模型最大的爭議之一,是我們很難知道模型是真的理解問題,還是只是看過太多類似答案。尤其在程式、數學、科學推理與歷史問答中,訓練資料污染經常讓評測結果被高估。Talkie 的研究價值正在於,它刻意切掉現代資料,讓研究者有機會觀察模型是否能從舊知識中推導新能力。官方也明確指出,資料污染是語言模型評測中持續存在的問題,而 Vintage LM 可以用來做獨特的泛化實驗,例如測試一個完全不知道數位電腦的模型,能否在少量範例提示下學會寫 Python。

官方實驗中,研究者讓 pre-1931 的 vintage model 和使用現代網路資料訓練的同架構模型接受 HumanEval 類型的 Python 程式測試。結果不意外,復古模型遠落後於現代模型。不過有趣的是,隨著模型規模增加,它們在少量範例提示下仍出現緩慢改善。官方也很克制地承認,目前正確解大多只是簡單一行程式,或是對範例程式做很小幅度改寫。

換句話說,Talkie 不是在宣稱「1930 年 AI 也會寫程式」,而是在提供一個相對乾淨的實驗場,如果模型沒有看過 Stack Overflow、GitHub、Python 教學和現代程式語料,它究竟能從語言結構與少量示範中學到多少抽象規則呢?

它也讓我們重新思考模型人格從哪裡來

Talkie 最有意思的地方,不只是知識截止,而是它暴露出一個更深的問題,現代 LLM 的性格、語氣、價值觀與回答習慣,到底有多少是模型架構帶來的,有多少只是因為大家都吃了同一批網路資料?

官方在介紹中指出,現代模型雖然能力與風格各有差異,但大多直接或間接受網路資料、蒸餾資料與合成資料影響。因此,訓練在不同來源上的模型,可能會產生截然不同的行為、人格與傾向。

這對 AI 安全、模型治理與人文研究都很有啟發。Talkie 不是單純懷舊,而是在問一個很根本的問題,我們今天看到的AI 助理人格,到底是智慧的自然形狀,還是 21 世紀網路文化的投影?CyberQ 認為,這應該都有。

復古模型也需要後訓練

Talkie 團隊不只釋出 base model,也釋出 instruction-tuned 版本 talkie-1930-13b-it。根據 Hugging Face 模型卡,這個版本是從 talkie-1930-13b-base 後訓練而來,使用來自 1931 年以前參考書籍所抽取的 instruction-response pairs,包括禮儀手冊、百科全書與書信寫作手冊等資料,之後再透過 online DPO 與 LLM-as-a-judge 改善指令遵循能力。

這裡反而是整個專案最迷人的矛盾點。為了讓 1930 年模型變得好聊一點,不能太難聊,研究團隊仍然需要現代 AI 訓練技術。官方也坦承,雖然他們努力避免現代影響,但使用 AI 回饋進行強化學習,仍不可避免會把某些現代聊天助理的行為模式帶進 Talkie。甚至早期 7B 版本在 RL 後會開始用現代網路常見的 listicle 條列文章風格回答問題。

這一點非常關鍵。Talkie 的挑戰是怎麼不讓 2026 年的 AI 訓練方法,把 1930 年模型重新污染成現代聊天機器人。

真正難題,時間洩漏與 OCR 噪音

Talkie 團隊沒有把問題包裝得太完美。官方明確承認,時間洩漏仍然存在。他們開發了 document-level n-gram anachronism classifier 來過濾訓練資料,但效果並不完美。早期 7B 版本已經知道羅斯福總統任期與新政內容,而 13B 版本也仍然知道部分二戰、聯合國與德國分裂等 1930 年後資訊。

另一個更硬的工程問題是 OCR。1930 年以前沒有原生數位出版,許多資料必須從實體書籍、報紙、期刊掃描轉錄。官方表示,在受控實驗中,使用傳統 OCR 轉錄的 pre-1931 文本訓練模型,學習效率只有人類轉錄文本的 30%;簡單 regex 清理後可提升到 70%,但仍有明顯落差。更麻煩的是,現代 VLM 雖然 OCR 準確率較高,卻可能把現代事實幻覺進歷史語料中,反而污染整個實驗。

這讓 Talkie 不只是語言模型專案,也是一個資料治理專案。它要處理資料年代、來源、轉錄品質、後設資料可信度與語料污染問題。

開源狀態與硬體門檻

Talkie 的推論程式碼已在 GitHub 公開,採 Apache-2.0 授權。官方 README 顯示,專案提供 Python API 與 CLI,可從 Hugging Face 下載模型並執行推論。環境需求包括 Python 3.11 以上、PyTorch 2.1 以上、至少 28GB VRAM 的 CUDA GPU,以及每個模型約 26GB 到 50GB 的磁碟空間。

模型方面,目前 Hugging Face 上可看到 talkie-1930-13b-base、talkie-1930-13b-it,以及作為對照組的 talkie-web-13b-base。後者使用 FineWeb 訓練,架構與 talkie-1930-13b-base 相同,目的在於比較「復古資料」與「現代網路資料」對模型能力與行為的影響。

CyberQ 觀點:AI 研究的時間隔離實驗室

Talkie 最值得關注的地方,不是它能不能取代 ChatGPT,也不是它能不能成為日常助理。它的價值在於,第一次把知識識時間邊界變成模型研究的核心變因。

對 AI 研究者來說,它可以用來測試預測、發明、科學推理與泛化能力。對人文學者來說,它提供了一種和歷史語料互動的新方法。對資安與治理研究者來說,它則提醒我們,模型行為並非只由架構決定,資料來源、資料年代、清理流程與後訓練方法,都可能深刻形塑模型的價值觀與輸出風格。

Talkie 用一種逆向設計提出了更重要的問題,如果一個模型不知道未來,它還能推理出什麼?如果一個模型只讀過某個時代的資料,它會長出怎樣的世界觀?而如果我們能訓練 1930 年的模型,未來是否也能訓練 1911 年、1850 年、甚至不同文明語料下的平行歷史 AI?這可能會有其他開發者想做,我們可以試想一個不同時代氛圍的 AI。

Talkie 目前還不完美,存在時間洩漏、OCR 品質、英文中心語料與現代後訓練污染等問題。但正因如此,它反而比許多追求榜單成績的模型更有意思。