史丹佛大學人文人工智慧研究院近期發布了《Artificial Intelligence Index Report》,我們檢視了這份報告,可以看到它明確指出,人工智慧正以前所未見的速度推動科學領域的跨越式進步,然而 AI 模型透明度下降與安全風險攀升,也正成為科技發展過程中無法迴避的兩面刃。

AI技術引領科學研究

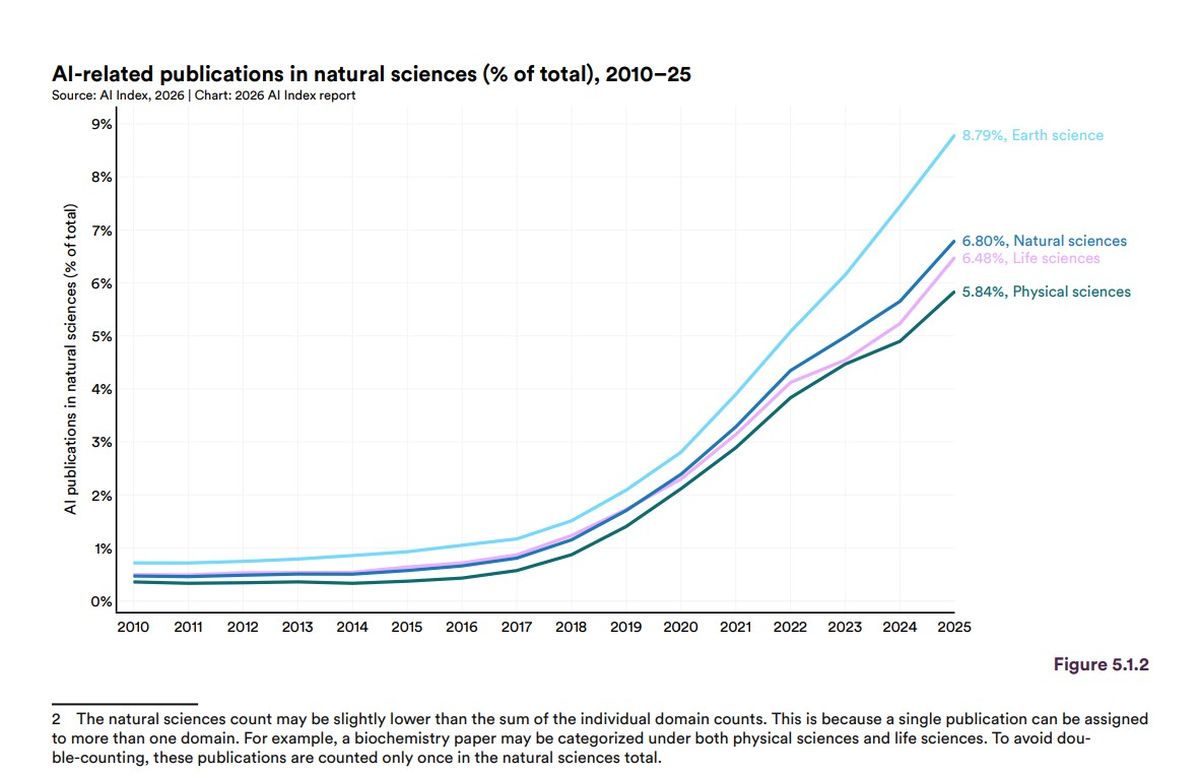

2025 年開始可說是被視為AI真正滲透科學核心的一年,這份報告顯示與AI相關的科學出版物數量持續成長,自然科學領域在 2025 年產出了超過八萬篇與 AI 相關的論文,成長幅度高達26%。目前,AI 協助貢獻的科學研究產出比例,依據不同領域與推估,已占總數的 5.8 % 到 8.8%,與2 010 年不到 1% 的比例相比成長了好幾倍,由此可見AI已經從過去科學研究的輔助工具逐漸轉變為科學發現的重要技術與工具之一。

在部分學科的表現上,AI 模型甚至超越了人類,例如在化學領域的表現,報告中的 ChemBench 測試顯示,顯示了 AI 頂尖模型在2,700多個化學問題上的表現極為出色。而在天文學領域,也有第一個優秀的基礎模型 AION-1,它搭配高達 100TB 的龐大資料集進行訓練,這象徵了科學研究也正在把 AI 基礎設施化。

氣象預測與軟體開發效率大幅精進

除了基礎科學,AI 在科學應用層面也有很大的進展。2025 年全球首個完全透過機器學習驅動的端到端天氣預報系統 Aardvark Weather 正式開始運作至今,這取代了傳統的數值預測流程,這個頂尖的 AI 氣象模型僅需不到 4 分鐘就能生成 60 天的全球預報,比傳統方法快上 8 到 60 倍。

而在軟體工程方面,我們大家已經是熟悉到不能再熟悉了,許多公司的大語言模型在 SWE-bench Verified 編碼基準測試中的表現,已經普遍有大幅度的提升,從前一年的只有 60% 已經進步到近 100%,可見 AI 在處理複雜邏輯與程式撰寫和修補的能力已愈來愈成熟。

但是目前 AI 對於需要深度判斷的任務表現有時並不穩定,甚至在某些生物資訊分析任務中,準確率只有博士級專家的一半。這是因為生醫相關的實驗和研究有個特別之處,即便是變數控制一樣,不同實驗室做出來的結果並不能完整地重現,這連生醫專家都不見得能夠做到盡善盡美,更何況是還在發展中的 AI 模型,預料這塊領域的進步會比較晚一點,但遲早會有跟上的一天。

透明度與安全性呈現反向走勢

儘管 AI 效能突飛猛進,但目前最強大的模型,卻也是透明度最低的模型,這怎麼說呢?由於模型開發大廠揭漏的技術細節越來越少,這導致外部機構在進行安全驗證與稽核時面臨了不少挑戰。

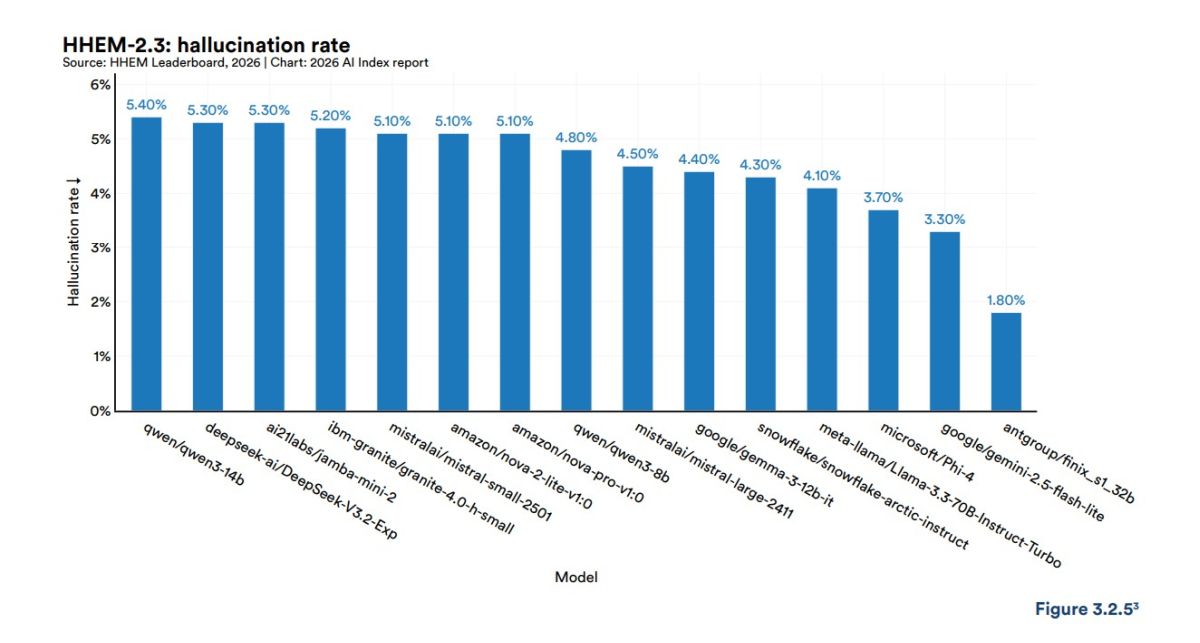

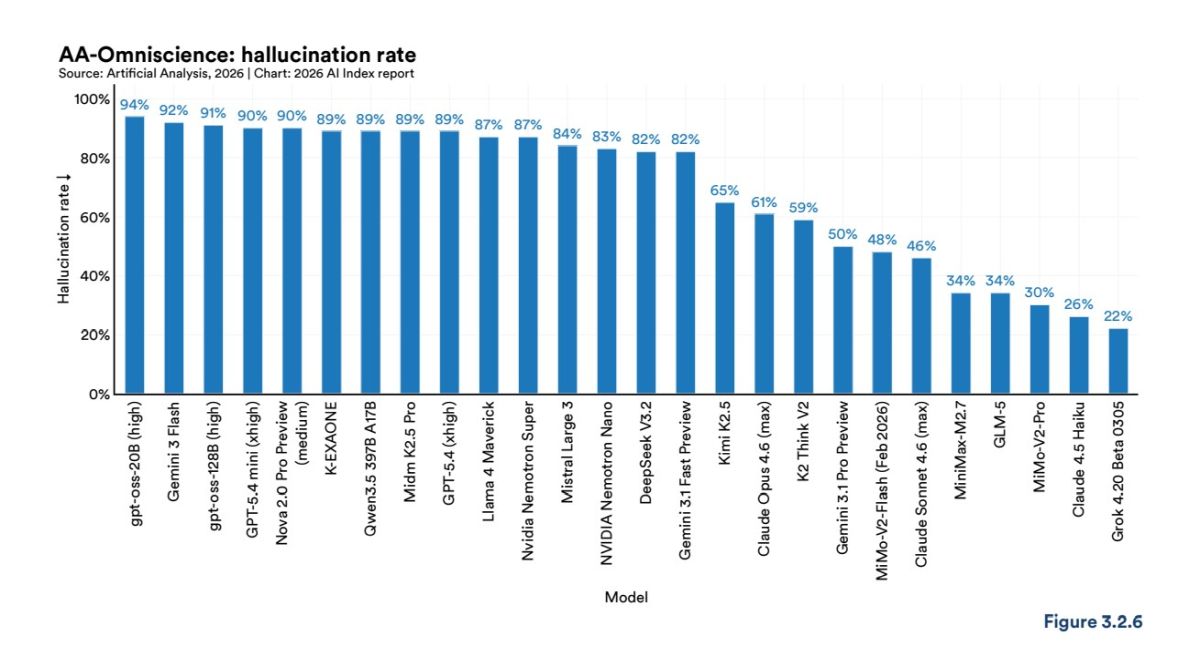

報告中提及安全性方面的資料顯示,市場上 26 款頂尖模型的幻覺率介於 22% 至 94% 之間。特別是在處理偽裝成真實信念的虛假陳述時,AI的判斷力大幅下降。這種真實性危機在 AI 介入法律、醫療或公眾決策時,將可能產生不可預測的負面影響。

在誠實度方面,報告引用了最新的 AA-Omniscience 測試。這項測試看重模型是否具備「知道自己不知道」的能力。

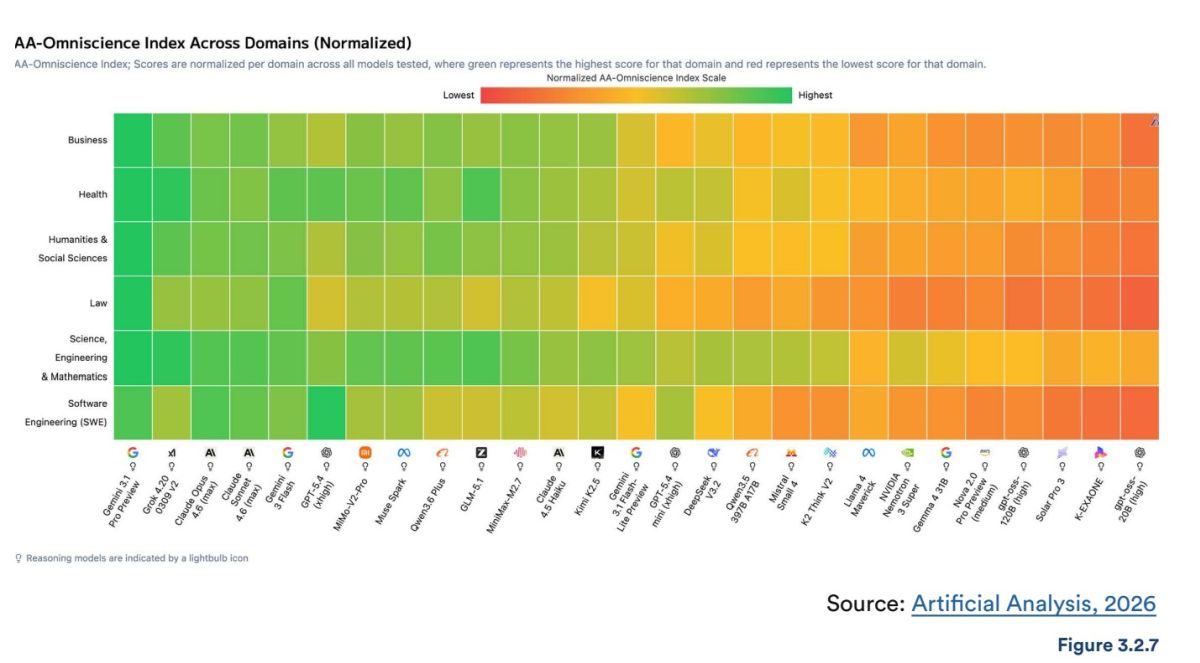

目前絕大多數大廠模型在面對知識盲區時,仍傾向於給出錯誤答案而非坦承無知,因此在評分中,許多頂尖模型的得分甚至接近零分或負分,這象徵目前模型雖然博學,卻仍缺乏真實性校準的機制,而 AI 模型在不同領域的誠實度也有落差。

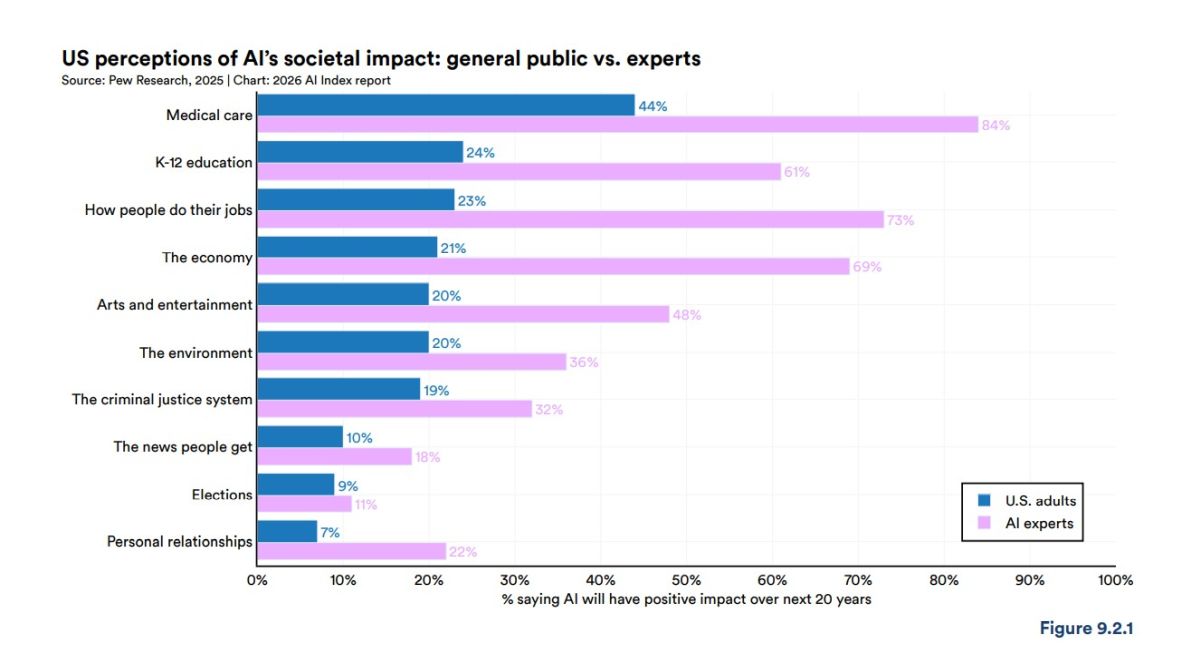

專家與大眾的認知鴻溝持續擴大

這篇報告還指出了一個有趣的社會現象,就是科技專家與一般民眾對 AI 的看法存在很顯著的分歧。在就業方面,高達 73% 的美國專家對 AI 改善就業市場持樂觀態度,但僅有 23% 的一般人認同這點。大多數民眾擔心 AI 會取代初階工作崗位,導致職涯發展機會縮減。

至於在全球 AI 基礎設施方面,台灣的半導體產業依然扮演關鍵角色。報告中強調,全球幾乎所有領先的AI晶片都透過台灣積體電路製造公司生產。這種高度集中的硬體供應鏈,加上資料中心對能源的龐大需求,使得 AI 的發展不單是技術競賽,更是一場涉及能源、環境與地緣政治的綜合大哉問議題。

CyberQ 認為2026年將會是AI發展的轉折點,人類在享受 AI 帶來的科學紅利的同時,必須建立更嚴謹的治理框架與評估標準,以確保這項強大工具能持續在安全的軌道上前行。

首圖由 Nano Banana AI 生成,配圖來源 Standford HAI The 2026 AI Index Report