踏入 2026 年,中美 AI 領域的戰火從實體 GPU 晶片繼續延燒到雲端 API。日前開發知名 AI 模型 Claude 的美國人工智慧巨頭 Anthropic 公開指控三家中國頂尖 AI 實驗室 DeepSeek(深度求索)、MiniMax(稀宇科技)以及 Moonshot AI(月之暗面),利用大量虛假帳號對其發動工業等級的大規模蒸餾攻擊(Distillation Attacks),藉此利用 Claude 的核心技術來強化自家模型。

這起被 Anthropic 升級為美國國家安全危機的事件,隨即在科技圈與資本市場引發大地震,在香港上市的 MiniMax 股價更一度重挫。然而,這番嚴厲的指控也引來 Tesla 創辦人 Elon Musk 及不少 SNS 網友的反諷,直指 Anthropic 根本是雙重標準。這場 AI 界的羅生門究竟是怎麼回事呢?

高達 1,600 萬次違規對話,三大中國 AI 廠商的榨取資料手法曝光

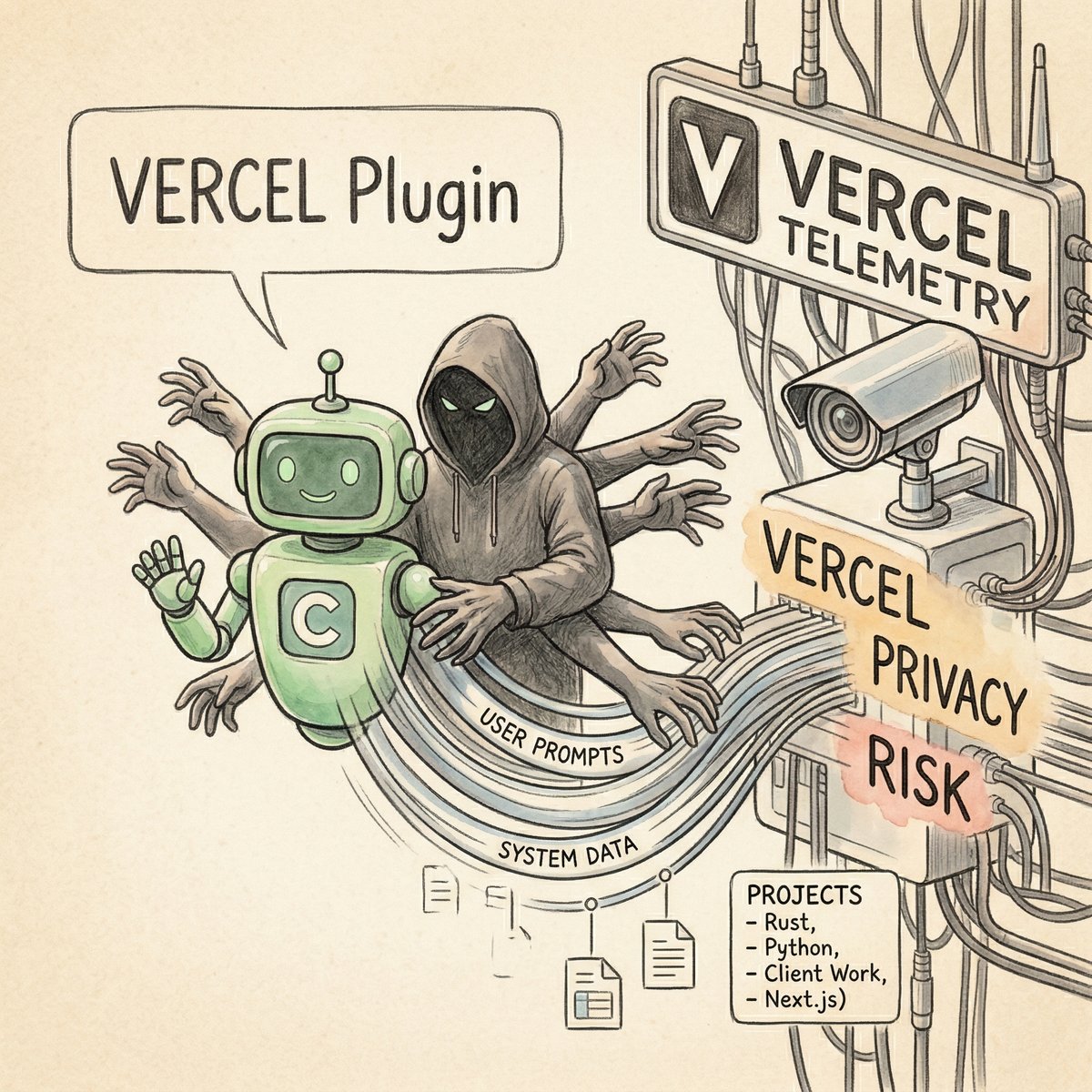

根據 Anthropic 發布的資安鑑識報告,這三家中國 AI 公司為了規避 Claude 的地區存取限制與服務條款,部署了名為「九頭蛇叢集(Hydra Cluster)」的複雜代理伺服器架構。他們合共建立了超過 24,000 個虛假帳號,並與 Claude 進行了逾 1,600 萬次密集交互對話。

資料顯示這三家公司的提取目標各有精心設想過的關注領域:

MiniMax(超過 1,300 萬次對話),這波攻擊事件中比重最高的吸血大戶,主要針對程式碼編寫與工具調用(Tool use)能力。Anthropic 更指出,當 Claude 釋出新版本模型的短短 24 小時內,MiniMax 竟能迅速轉移近半流量,精準且瘋狂地「吸取」新系統的最新能力。

Moonshot AI / Kimi(超過 340 萬次對話),專注於提取代理推理(Agentic reasoning)與電腦視覺能力,甚至試圖逆向工程重建 Claude 內部的思考邏輯軌跡。Anthropic 表示,他們是透過請求的元資料(Metadata)比對,直接抓包了 Moonshot 高階主管的公開個人資料。

DeepSeek(逾 15 萬次對話),雖然互動次數較少,但含金量高。DeepSeek 主要針對 Claude 的「思維鏈(Chain-of-Thought)」推理步驟進行提取,甚至將 Claude 當作強化學習的獎勵模型(Reward Model)。最引人注目的是,DeepSeek 刻意利用 Claude 生成規避政治審查的替代方案(如針對異議人士或威權體制的敏感提問),以此資料訓練自家模型,確保其在中國市場的政治安全性。

甚麼是蒸餾攻擊?為何觸動美國國安與晶片禁令神經?

在 AI 發展中,「模型蒸餾(Model Distillation)」本來就是我們常見的訓練技術之一,透過強大的教師模型所輸出的優質資料,再去來訓練較小、較便宜的學生模型。

然而,Anthropic 認為中國 AI 競爭對手廠商惡意利用 API 進行逆向工程,跨越了商業道德的紅線。他們更將此事上綱至國家安全層級,提出兩大警告:

第一個是安全護欄(Safeguards)被拔除,美國頂尖 AI 模型內建了嚴格的安全機制,防止 AI 被用於開發生物武器或發動惡意網絡攻擊。但被蒸餾出來的中國模型並不會繼承這些限制,一旦這些具備高階推理能力的 AI 落入威權政府的軍事或監控系統中,後果不堪設想。

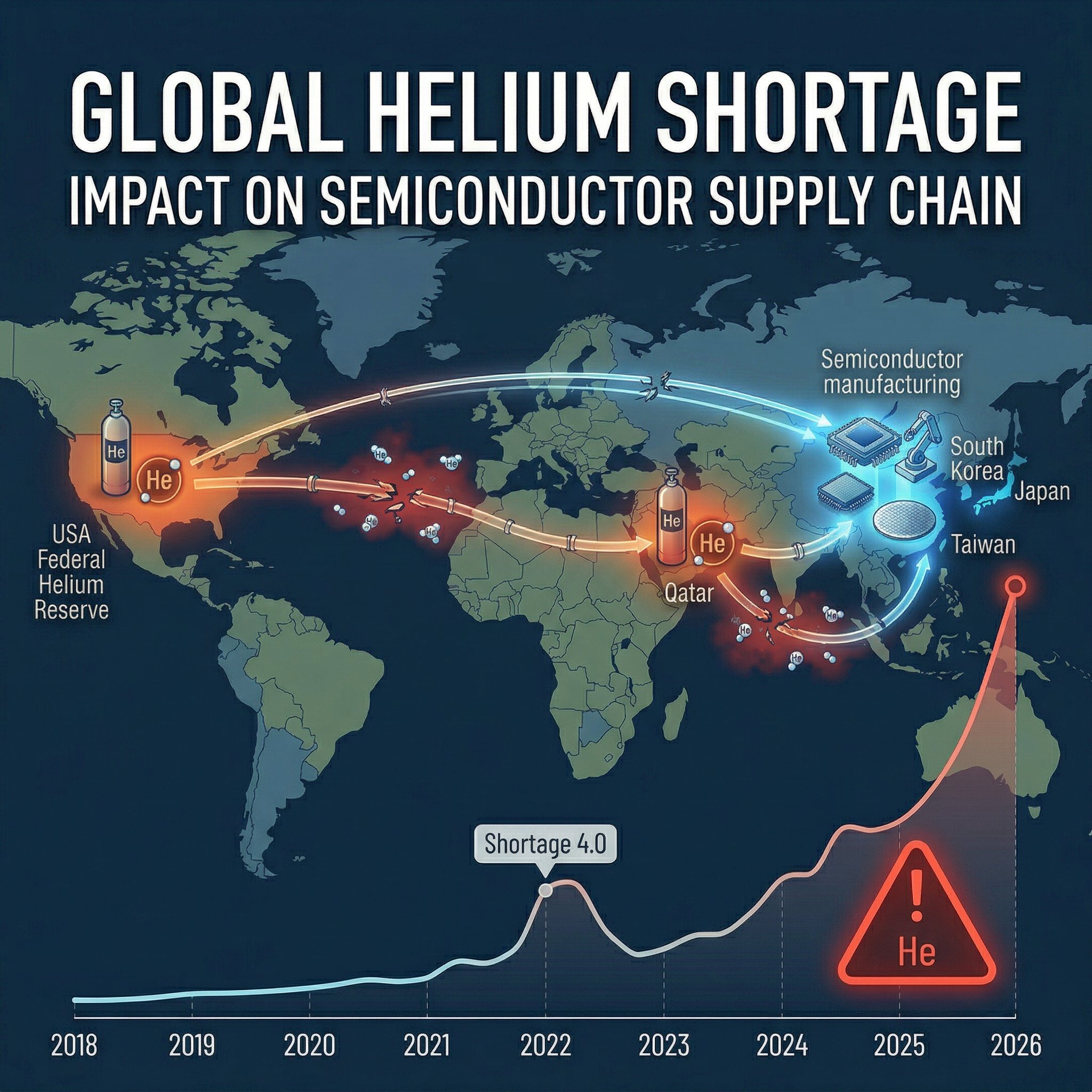

其次是變相繞過美國晶片禁令,美國政府長期實施嚴格的 GPU 出口管制,本意是拖慢中國 AI 發展。但蒸餾攻擊證明了中國企業根本不需要買齊同等數量的頂級晶片,他們只需花費相較於買昂貴 AI 基礎設施更少金額的 API 呼叫費用,就能直接將美國頂尖 AI 的大腦邏輯搬回家。

馬斯克與部分網友認為 Anthropic 雙標

儘管 Anthropic 以受害者姿態發聲,但科技界與開源社群、SNS 平台也有不少人嘲諷。

向來語出驚人的 Elon Musk 率先在 X 平台上發文評論:「Anthropic 自己就是大規模竊取訓練資料的罪魁禍首,他們甚至為此支付了數十億美元的賠償和解金。這是鐵一般的事實。」

馬斯克所指的,是去年底(2025年12月)Anthropic 才剛因未經授權使用數十萬本版權書籍訓練 AI,而與作家群體達成高達 15 億美元的侵權和解。

在 Reddit 的 r/LocalLLaMA 等開發者論壇上,「雙標(Hypocrisy)」成為熱門關鍵字。也有不少網友認為包括 Anthropic、OpenAI 在內的矽谷巨頭,當初也是未經授權、免費爬取全人類網路上的文章與版權資料來訓練底層模型。如今當別人真金白銀付費買你的 API Token 來學習時,卻被認為是非法攻擊與國安危機。

x 平台上也有嘲諷 Anthropic 的關鍵字 MisAnthropic 出現,是一個雙關語嘲諷,畢竟 Anthropic 公司原本的命名取自人類(Anthropic),標榜自己是一間致力於 AI 安全和以人類利益為優先的 AI 公司。將代表負面的字首 Mis- 加在公司名稱前,創造了 MisAnthropic這個詞,諷刺該公司的行為已經違背了初心,變得反人類或是偽善。 簡單來說,這就像是把一間自稱「愛人科技」的公司,因為做了一些惹議的事情,被美國網友戲稱為「厭人科技」一樣。

至於支付 15 億美元和解金的始末,這是在 2025 年 9 月的 Bartz v. Anthropic 集體訴訟案中,Anthropic 有同意建立 15 億美元的和解基金。這筆金額將用於賠償約 50 萬部符合條件的版權作品(扣除行政與律師費後,每部作品約可獲賠 3,000 美元),這確實是美國歷史上金額最大的版權和解案。

使用盜版網站的書籍訓練 Claude,在法庭文件與調查顯示,Anthropic 下載了超過 700 萬本來自影子圖書館(Shadow Libraries),包含 Library Genesis (LibGen) 與 Pirate Library Mirror (PiLiMi) 的版權電子書,並將其作為 AI 模型的訓練資料。作為和解條件之一,Anthropic 必須銷毀這些非法取得的資料集。

版權在 AI 產業的重要性

不過,CyberQ 在這邊要補充一個關鍵的法律細節澄清,也是本次判決的真正重點,美國聯邦法官 William Alsup 在早先的判決中確立了一個分水嶺,他認為將合法取得的版權物用於 AI 訓練,具有高度轉化性,屬於合理使用(Fair Use)。但 Anthropic 之所以面臨天價賠償,根本原因在於他們獲取資源的手段違法,明知盜版且大量下載盜版檔案,而不是說 AI 模型訓練這項行為本身違法,這確實就滿關鍵的,也保護了 AI 產業後續的模型訓練發展。

過去 AI 圈部分人的做法是先抓資料,被告再道歉與處理的策略,現在已經不管用。Anthropic 案確立了明確的紅線,也就是資源溯源(Data Provenance)的合法性。現在,大型 AI 企業必須轉向與內容擁有者(如大型出版商、新聞媒體、知名平台)簽訂重要的商業授權協議,以確保訓練資料庫的乾淨度並抵禦潛在的法律風險。

合規成本反而成為新的護城河,恐加劇市場集中化

15 億美元的數字看似驚人,但對於估值超過 1,800 億美元的 Anthropic 而言,這筆錢更像是為了清除歷史包袱、獲取未來豁免權而支付的業務成本。然而,這種相對不低的 AI 合規與和解成本,拉高了 AI 基礎模型競爭的進入門檻。

對於那些缺乏龐大資本支援的 AI 新創公司來說,未來將更難以承擔合法採購千萬級別高質量資料集的費用,這可能導致 AI 技術霸權,更進一步往少數擁有豐富資源的科技大廠們集中。

資安與合規工程的緊密結合

在模型訓練的資料準備階段(Data Pipeline),單純的資源清洗(Data Cleaning)已經不夠。未來的資料工程可能需要須導入嚴格的版權過濾與污染隔離機制。確保訓練資料集內不包含任何來自已知盜版節點的檔案,將成為企業內部資訊安全與法遵稽核的標準配備。

先前的這起和解案也為 AI 開發者與版權所有者劃下了一道明確的界線,之後不能再有模型訓練免費午餐的時代了。

蒸餾攻擊風暴背後的關鍵趨勢

CYberQ 認為,這場由抄作業引發的數位論戰,延續幾間科技大廠的競逐,除了拚能源、拚演算法拚算力外,也要拚資安防禦、AI提詞注入攻擊,各種環節的競爭門口都繼續加碼上去。

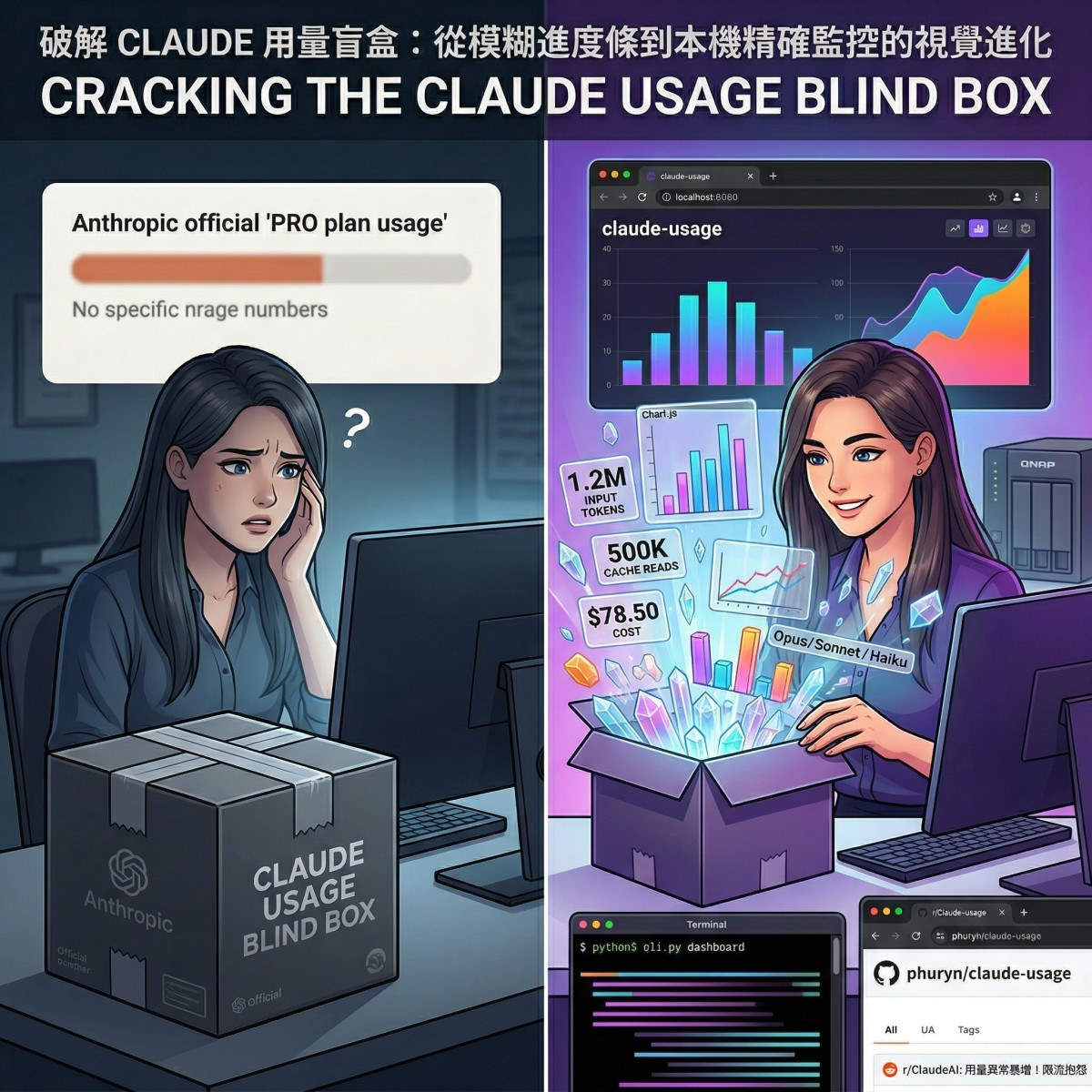

API防禦戰的部分,Anthropic 已經宣佈部署「行為指紋(Behavioral fingerprinting)」等防禦機制來偵測異常的思維鏈提取。預料未來各大 AI 雲端平台將大幅收緊 API 的使用權限與 KYC(客戶身分審查),「防蒸餾」將催生出全新的 AI 網路安全防禦產業鏈。

資本市場也隨之震盪,緊接著市場關注到高性價比模型的是有競爭力的。在這次消息曝光後,在香港上市的 MiniMax(HKG: 0100)於 24 日盤中股價一度重挫逾 13%,另一家中國 AI 獨角獸智譜(Zhipu AI)近期也傳出 GPU 算力告急。在硬體算力受限下,中國企業依賴蒸餾已是公開的秘密。然而,隨著 DeepSeek 的 V4 / Terminus 旗艦模型即將發布,這種以極低成本逼近美國頂尖模型效能的作法,正嚴重威脅著美國閉源巨頭的商業護城河,也讓華爾街感到焦慮。

軍工複合體方面也在進行政治角力,市場傳出 Anthropic CEO Dario Amodei 近期正與美國國防部接觸,商討讓軍方使用 Claude 模型。Anthropic 選擇在此敏感時刻高調出手,是否為了爭取並鞏固其未來的國防防護合約,也是被討論的話題之一。

CyberQ 指出,這場由 API 流量引發的蒸餾攻擊爭議,加上之前的 AI 版權爭議影響 AI 技術將繼續向科技大廠集中,除了全球 AI 競賽增加更多防禦戰。

在這個靠著抓取全人類資料才得以誕生的新產業裡,關於合法學習與惡意竊取的法律界線,在 2026 年顯然比我們想像的更加模糊且充滿各方算計的局面。接下來的 AI 戰局,或許會比硬體晶片戰更嚴峻也說不定噢。