本期 GitHub 趨勢週報呈現出一個非常清楚的方向,AI Agent 正從單一聊天工具、程式碼助手,快速演化成一整套可執行、可記憶、可路由、可本地部署的開發者基礎設施。從多模態桌面 Agent、金融服務 Agent、AI coding 技能庫,到 Apple Silicon 本地推理伺服器與 DeepSeek V4 Flash 專用引擎,開源社群的焦點正在從誰的模型更強轉向誰能把模型真正接進工作流程。

CyberQ 觀察指出,本地算力、Agent 工具鏈與個人 AI 主機,它們不只是開發者之間的技術玩具,而是可能改變市場逐步導入 AI、端點資料治理與本地推理架構的重要基礎呢。

本期 GitHub Trending 熱門專案速覽

以下星數是 CyberQ 觀察本周熱門專案,以及自己關注一些重要專案後,將之列在本期 Github 趨勢週報,由於星星數會隨時間更新,實際數字可能在發布後繼續變動。

| 專案 | 目前星數 | 今日新增 | 重點觀察 |

|---|---|---|---|

| bytedance/UI-TARS-desktop | 32,634 | 669 | 多模態 AI Agent 桌面堆疊,主打模型與 Agent 基礎設施整合 |

| anthropics/financial-services | 19,720 | 1,449 | 金融服務場景範例快速吸星,顯示產業 Agent 應用仍是主流焦點 |

| addyosmani/agent-skills | 39,120 | 1,065 | AI coding agent 技能模板化,代表工程實務開始被規格化 |

| CloakHQ/CloakBrowser | 5,371 | 496 | 反 bot 偵測 Chromium 與 Playwright 替代方案,兼具測試與資安觀察價值 |

| HKUDS/AI-Trader | 16,002 | 163 | 全自動交易 Agent,金融 AI 仍是高關注但高風險題材 |

| jundot/omlx | 13,513 | 185 | Apple Silicon 上的 LLM inference server,支援連續批次與 SSD caching |

| THU-MAIC/OpenMAIC | 17,326 | 109 | 多代理互動式教室,教育場景也開始 Agent 化 |

| datawhalechina/easy-vibe | 9,567 | 635 | Vibe coding 教學課程,AI coding 普及化進入教材化階段 |

| playcanvas/supersplat | 7,043 | 579 | 3D Gaussian Splat 編輯器,3D 視覺工具仍有穩定熱度 |

| lsdefine/GenericAgent | 10,812 | 174 | 自演化 Agent,強調技能樹成長與 token 消耗降低 |

| decolua/9router | 7,755 | 803 | AI coding provider router,串接 Claude、Codex、Cursor、Gemini 等服務 |

| datawhalechina/hello-agents | 47,286 | 748 | 從零開始建構智能體的中文教程,顯示 Agent 入門需求仍在升溫 |

本期區是週報我們覺得很值得注意的,現階段整個 AI Agent 工具鏈正在形成。UI-TARS-desktop 代表多模態桌面 Agent,agent-skills 嘗試將 AI coding agent 所需的工程能力整理成可複用技能,9router 則處理多模型、多供應商與多 coding assistant 之間的路由問題。

這代表 AI coding 的競爭焦點正在改變。模型能力仍然重要,但真正能改變日常開發流程的,是如何降低 token 浪費、保存上下文、讓 Agent 能依照規格工作,並在 Claude Code、Codex、Gemini、Cursor、Cline、Copilot 等工具之間維持可控的協作關係。

Caveman 生態誕生 ! 從少講廢話,到記憶與規格化開發

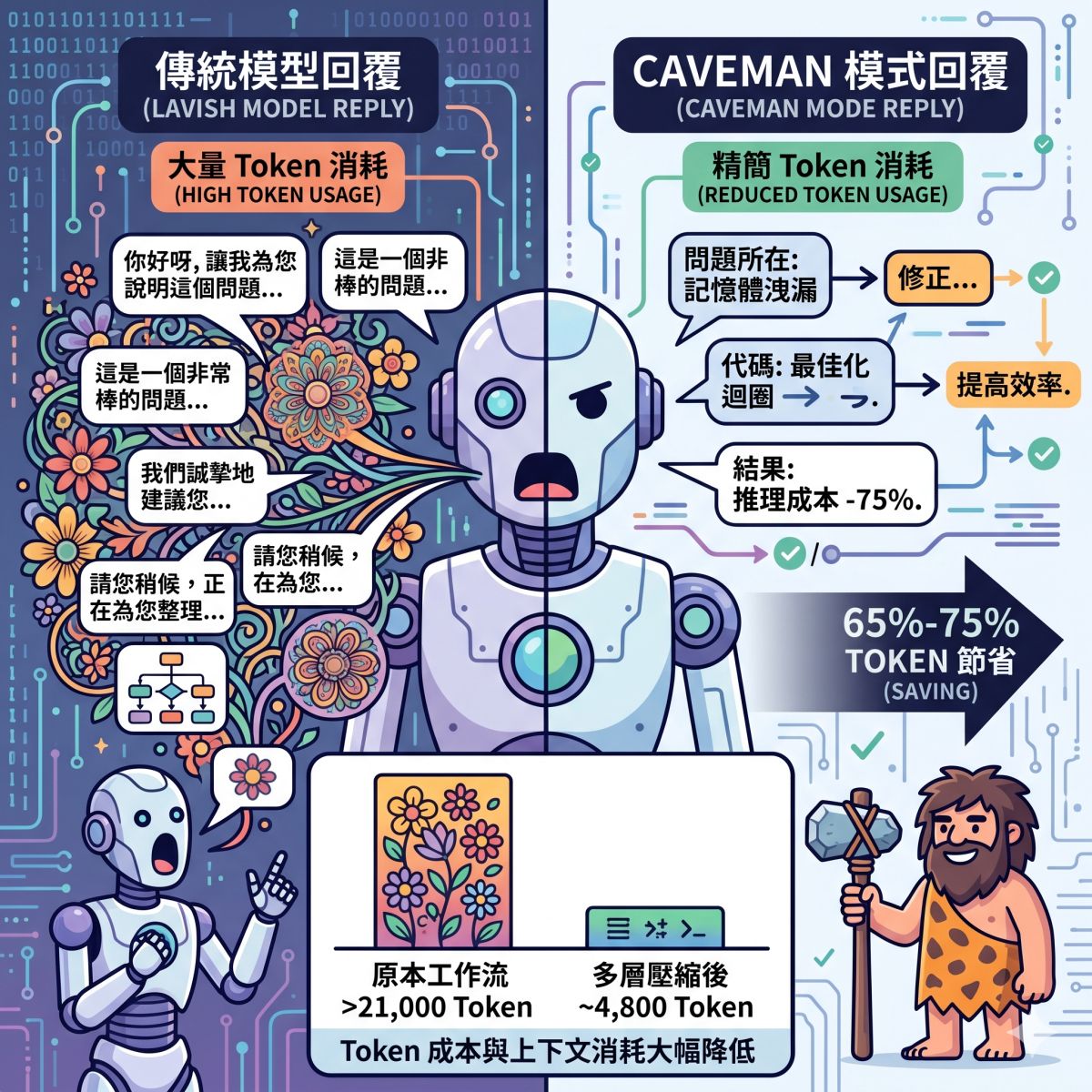

雖然 caveman 並不是近期最熱門的專案,但它的生態系非常值得放進本期觀察。caveman 目前約 57.9k stars,定位是讓 Claude Code、Codex、Gemini、Cursor、Windsurf、Cline、Copilot 等 AI coding agent 用更短、更直接的方式輸出,官方說法是可減少約 75% 的輸出 token,同時保留技術準確度。

這個方向看似幽默,實際上抓到了 AI coding 的核心問題。今天的 coding agent 很會解釋,也很會補充背景,但在真實工程環境中,過度冗長的回覆會增加 token 成本,也會干擾開發者判斷。caveman 的價值不是故意講得像穴居人,而是把輸出壓縮成更接近工程指令、狀態摘要與決策紀錄的格式。

更重要的是,caveman 已經不只是單一 prompt 或外掛,而是延伸出 cavemem 與 cavekit。cavemem 目前約 344 stars,主打跨 agent 的本地持久記憶,會在 session 邊界記錄觀察結果,壓縮後寫入本地 SQLite,並透過 MCP 工具讓 agent 查詢自己的歷史紀錄,它也強調預設本地、不依賴雲端網路呼叫。

cavekit 則約 873 stars,定位是 Claude Code plugin,可將自然語言需求轉為 blueprint,再轉成平行 build plan,並搭配自動迭代、驗證與跨模型 peer review。它提供 spec、build、check 等指令,讓 Agent 不只是回答問題,而是能依照規格、任務與驗證流程推進軟體開發。

這三者合在一起,代表 AI Agent 工具鏈的一個重要方向,少講、記住、照規格做。對企業開發團隊而言,這比單純追逐模型排行榜更務實。真正能進入生產流程的 AI Agent,必須能節省成本、保存上下文、尊重規格、留下可稽核的工作痕跡。

DeepSeek V4 Flash,不只是模型變強,而是在重新定義個人電腦

本期另一個最重要的技術焦點,是 DeepSeek V4 Flash 引發的本地推理討論。DeepSeek 官方模型卡顯示,DeepSeek-V4-Flash 是 MoE 架構模型,總參數 284B,啟用參數 13B,支援 100 萬 token context,並採用 FP4 與 FP8 混合精度。

這組規格的關鍵,不只是模型變大,而是巨大模型、低啟用參數、長上下文、低精度推理這幾個方向被放在同一個架構中。換句話說,它不是單純把模型塞得更大,而是讓大型開源模型更接近可被本地設備承載的範圍。

這也是為什麼 Redis 作者 antirez 大神的 ds4 專案會受到業界高度關注。antirez/ds4 目前約 7k stars,ds4.c 是專門為 DeepSeek V4 Flash 寫的小型原生推理引擎,不是通用 GGUF runner,也不是其他 runtime 的 wrapper,而是針對 DeepSeek V4 Flash 設計的 Metal 與 CUDA graph executor,包含模型載入、prompt rendering、KV state 與 server API 等流程。

antirez 在 README 中也指出 DeepSeek V4 Flash 的特殊性,包括較少啟用參數帶來速度優勢、thinking mode 在特定情境下可維持較短思考段落、支援 100 萬 token context,以及高度壓縮的 KV cache,這些特性讓本地長上下文推理變得更有想像空間。

另一個 antirez/llama.cpp-deepseek-v4-flash 則是 llama.cpp 的 DeepSeek V4 Flash 實驗分支,目前約 245 stars。它的重要性不在星數,而在於它代表 DeepSeek V4 Flash 與 llama.cpp/GGML 生態之間的接軌嘗試,讓大型模型本地推理不只是單一作者的實驗,而是進入更廣泛的開源推理基礎設施脈絡。

從 antirez 到 mitsuhiko、audreyt,本地推理的 fork 接力

DeepSeek V4 Flash 這波討論,很快從 antirez 的原始實作延伸到其他開發者的 fork。mitsuhiko/ds4 目前約 105 stars,頁面說明它是在 ds4.c 之上加入一些 patch,用來實驗更好的 streaming,以及讓 pi 能有 out-of-the-box 體驗,包括自動下載模型、編譯 ds4、管理 server lifecycle,而不需要手動編輯 models.json。

audreyt/ds4 則是另一個值得注意的 fork, 目前約 121 stars,雖然星星數不多,但 audreyt/ds4 的技術意義並不取決於星數,而在於它把 DeepSeek V4 Flash 的本地推理、Apple Silicon M5 Metal 支援、去限制 GGUF 版本與個人電腦運算敘事放在一起。作者可是唐鳳,她的 README 指出,這個 fork 目標是讓 CyberNeurova 的 abliterated GGUF 能在 Apple Silicon 上 end-to-end 執行,並在 M5 Max 上達到約 440 prefill tokens per second。

根據該 README 的 benchmark,MacBook Pro M5 Max 在特定 Q2_K GGUF、ctx 32768、3 次平均測試條件下,prefill throughput 可從 261.6 tok/s 提升到 442.4 tok/s,在另一組 2008 tokens prompt 中,甚至可達 625.5 tok/s。decode throughput 則約落在 24 到 37 tok/s。

CyberQ 提醒,這裡需要更精準地理解不受限制這件事,以 audreyt/ds4 來說,她使用的是 abliterated GGUF,這類社群版本通常被視為對模型拒答或 steerability 進行調整的版本,但它不是 DeepSeek 官方正式模型,也不應簡化成一般意義上的官方破解版。更精確的說法是,社群已開始針對 DeepSeek V4 Flash 的去限制量化版本、本地推理效能與可控性進行實驗。

個人電腦的意義正在改變

CyberQ 認為,這波 DeepSeek V4 Flash 與 ds4 的討論,真正重要的地方不只是筆電跑得動大型模型,而是它重新打開了個人電腦的定義。

過去幾年,大型 AI 模型幾乎等同於雲端 API。使用者把資料送到服務商,服務商負責模型、GPU、推理、更新、審查與成本控管。這種架構有明顯優點,包括規模化、穩定性、模型更新速度與商業支援能力。但它也帶來另一面問題,資料外送、網路依賴、延遲、成本不可控,以及企業內部合規與資料主權壓力。

DeepSeek V4 Flash、ds4、omlx 與 Apple Silicon 本地推理工具的崛起,高容量記憶體筆電、Mac Studio、本地工作站或企業內部伺服器,開始有機會承載更大的開源模型,並以本地 API 的形式服務個人、團隊或內部系統。這不會完全取代雲端模型,但會讓本地 AI 主機成為更合理的選項。

對資訊安全、研發、法務、醫療、金融與內部知識管理來說,這個轉變尤其重要。當模型可以在本地端處理長文件、程式碼庫、內部 log、封包分析資料或客戶文件時,企業就可以在資料不離開受控環境的前提下,建立自己的 AI workflow。這是成本議題,也是資料治理議題。

本期觀察與 CyberQ 觀點

從本期 GitHub 趨勢週報可以看出,UI-TARS-desktop、agent-skills、9router、GenericAgent 等 AI Agent 工具鏈逐漸成熟,caveman、cavemem、cavekit 則代表 Agent 需要更短的輸出、更好的記憶與更嚴格的規格化流程,DeepSeek V4 Flash、ds4、omlx 則代表大型模型本地推理正在向高階個人電腦與工作站逼近。

CyberQ 指出,這一期觀察當然不是單純地說 AI 又更強啦之類的,而是 AI 變得更容易被我們拿來可組裝、更本地化,也更接近真正的資訊環境基礎設施。

Caveman 生態讓 AI Agent 進入日常開發流程,若能少講廢話、記得上下文、依照規格工作,可省的 Token 和電力可觀。DeepSeek V4 Flash 與 ds4 以及地端 AI 的未來還是有潛力的,當 MoE、量化、KV cache、Metal 與本地推理引擎逐漸成熟,個人電腦也開始具備承載大型 AI 能力的可能。

下一階段的競爭,除了 AI 大廠們在頂尖模型之間的 API 價格戰外,還有雲端 AI、企業私有 AI 與個人本地 AI 之間的架構選擇和採購、日常營運策略的最佳化,老實說一切都還在發展和變動中,請保持適變能力。對開發者來說,這是工具鏈變革,各家公司則得想辦法搞定資料治理與 AI 主權的重新分配。我們過去習以為常的個人電腦,新的發展也許會是繼圖形介面、網際網路與行動運算之後,又一次蛻變為新角色呢。