今年的 TAIWAN AI EXPO 2026 呈現一個非常明確的市場趨勢,AI 已經火力展示的實驗室和成本高昂階段,全面走向落地應用與合規安全並重的企業級實戰。

走進 2026 年的未來展場,從「AI Infra」、「AI Next」到「AI Convergence」各大專區的熱絡程度,我們可以清楚看到,無論是國際科技大廠還是本土新創,都在積極解決企業導入 AI 時面臨的真實問題,也就是如何在保有極致運算能力的同時,確保公司機密資料的絕對安全。

以下是 CyberQ 這次看到的部份展覽重點觀察。

重點一 AI Agent 躍升主流,從單點工具進化為自主決策群體

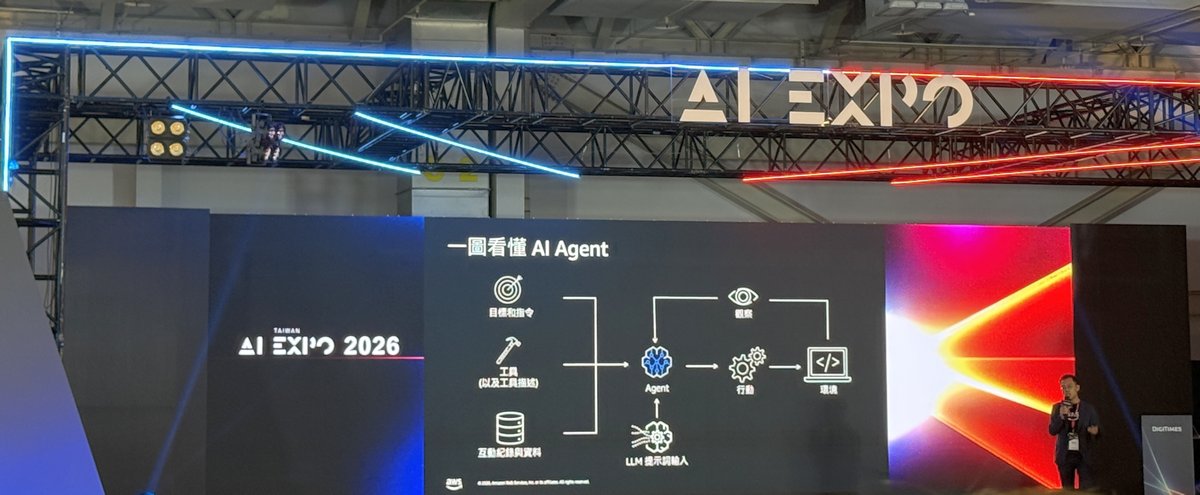

過去我們談論 LLM(大型語言模型),多半聚焦在對話生成,但在 2026 年的展覽上,AI Agent(人工智慧代理)無疑是最核心的關鍵字。

在 AWS 贊助的議程中,講者用「一圖看懂 AI Agent」精準拆解了其架構,結合了目標與指令、工具以及工具描述、記憶體與資料,讓 Agent 能夠透過 LLM 的提示詞輸入,自主進行觀察、行動,並與環境互動。

這與不少開發者目前在 AI 程式開發上的體悟完全一致。另外,Lablup Inc. 帶來的議程《從超大規模雲端到 AI PC,個人裝置上的群體式 AI Agent 管理》更是點出了未來的發展方向,運算力正在下放。

未來的個人裝置(AI PC)將不僅僅是執行單一模型,而是管理多個各司其職的 AI Agent 進行群體協作。這種將龐大運算力分散到邊緣裝置的架構,不僅能最佳化整體系統的反應速度,更是降低雲端依賴的關鍵一步。

重點二 地端 AI 成為資安優先需求,QNAP 展現強大 Edge 部署力

市場上顧問常被企業客戶問到的問題之一是,「把大量內部資料餵給雲端 AI,我們的機密會不會外洩?」

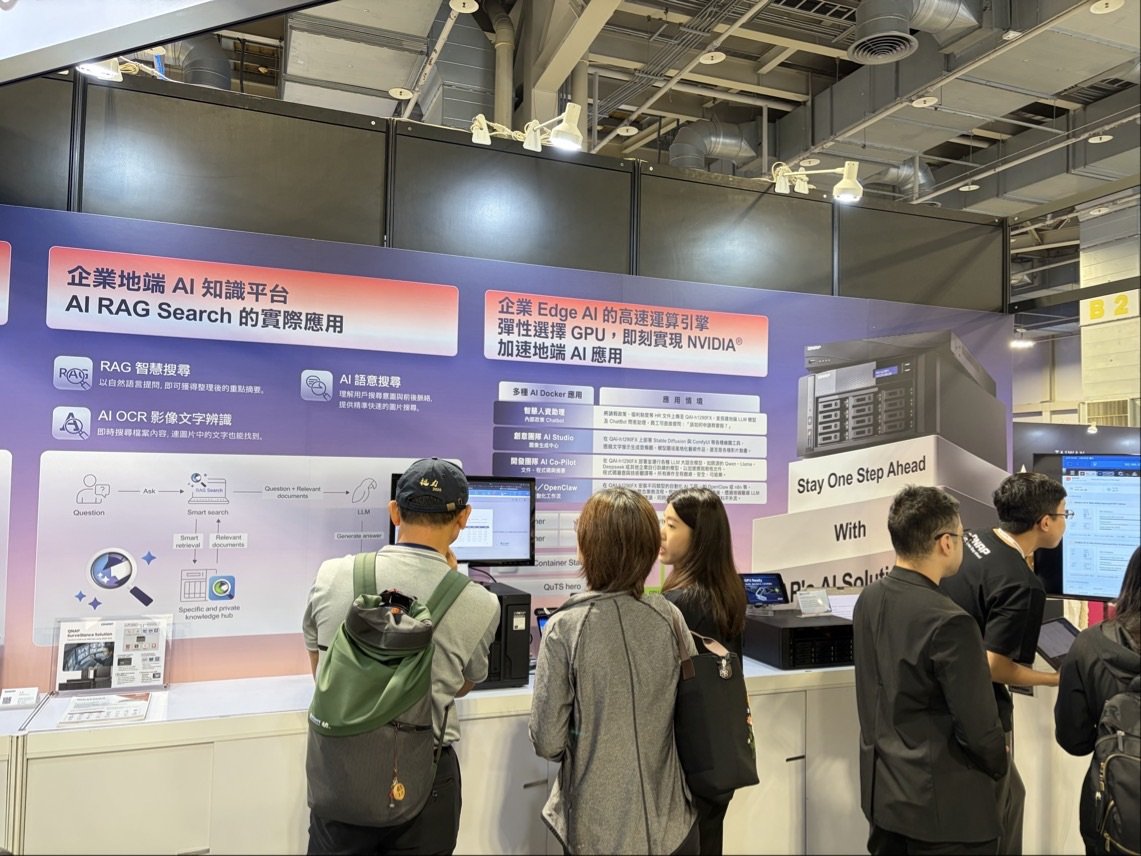

今年 QNAP(威聯通科技)的攤位給出了不錯的解答,以企業級備份品牌的角度,他們這次主打「企業地端 AI 知識平台」與「AI RAG Search 的實際應用」。

從現場展示可以看到,QNAP 透過支援彈性選擇 GPU 的硬體架構,結合 AI Docker 應用,讓企業能夠直接在本地端(Edge AI)執行各種應用程式,這對重視資安的企業來說有幾個點是具備吸引力的。

首先是機敏資料不落地,也就是不會離開辦公室網路,透過本地端的 RAG(檢索增強生成)技術,企業可以在內部建置 Chatbot(AI 智慧助理)、AI OCR 影像文字辨識系統,這樣一來,員工查詢內部機密文件時,完全不需要將資料上傳至外部雲端。

其次是擁抱開源模型,現場展示了 QNAP 設備可順利支援如 Qwen、Llama、DeepSeek 等主流開源模型,作為開發團隊的 AI Co-Pilot。

另一個則是企業端的 AI 成本控制與節省,攤位上有一句幽默的標語「地端養蝦,飼料免費,OpenClaw 地端免費跑」,其實精準戳中了企業依賴雲端 API 導致成本不可控的問題。如果能讓將日常高頻率的 AI 推論任務移至地端,能大幅省下驚人的 API 呼叫費用。

重點三,AI 賦能維運與資安,建立系統級的防護網

除了應用面的擴展,AI 如何協助 IT 維運與資訊安全,也是本次展覽的一大看頭。

Veeam 在「不知講堂」帶來的《AI 賦能營運,Veeam 從自動化備份到威脅偵測的演進之路》,正好呼應了現代資安防禦的趨勢。傳統的備份只是被動的最後防線,但結合 AI 後,備份系統能夠主動監控資料的異常變動(例如勒索軟體加密行為),在威脅發生初期就發出警報並阻斷。

同時,擷發科技探討的《讓 AI 專案可部署、可維運,AIVO 的系統級實踐》,也提醒了所有從業人員,寫出一個厲害的 AI 模型只是起點,如何建立穩健的 MLOps 架構,讓專案在企業環境中穩定、安全地執行,才是真正考驗工程實力的所在。

CyberQ 觀點

2026 年的 AI 發展,已經沒有前兩年那種大量模醒大戰的浮躁,取而代之的是深耕特定領域、注重成本效益與資訊安全的務實態度。從雲端算力的集中,到 Edge AI 與地端部署的百花齊放,企業正在尋找最適合自己的 AI 混合架構。

如果你正在評估為公司導入 AI 系統,強烈建議開始將「地端 RAG 架構」與「開源模型本地端部署」納入考量,這將是兼顧效率與資安合規的優秀解法之一。