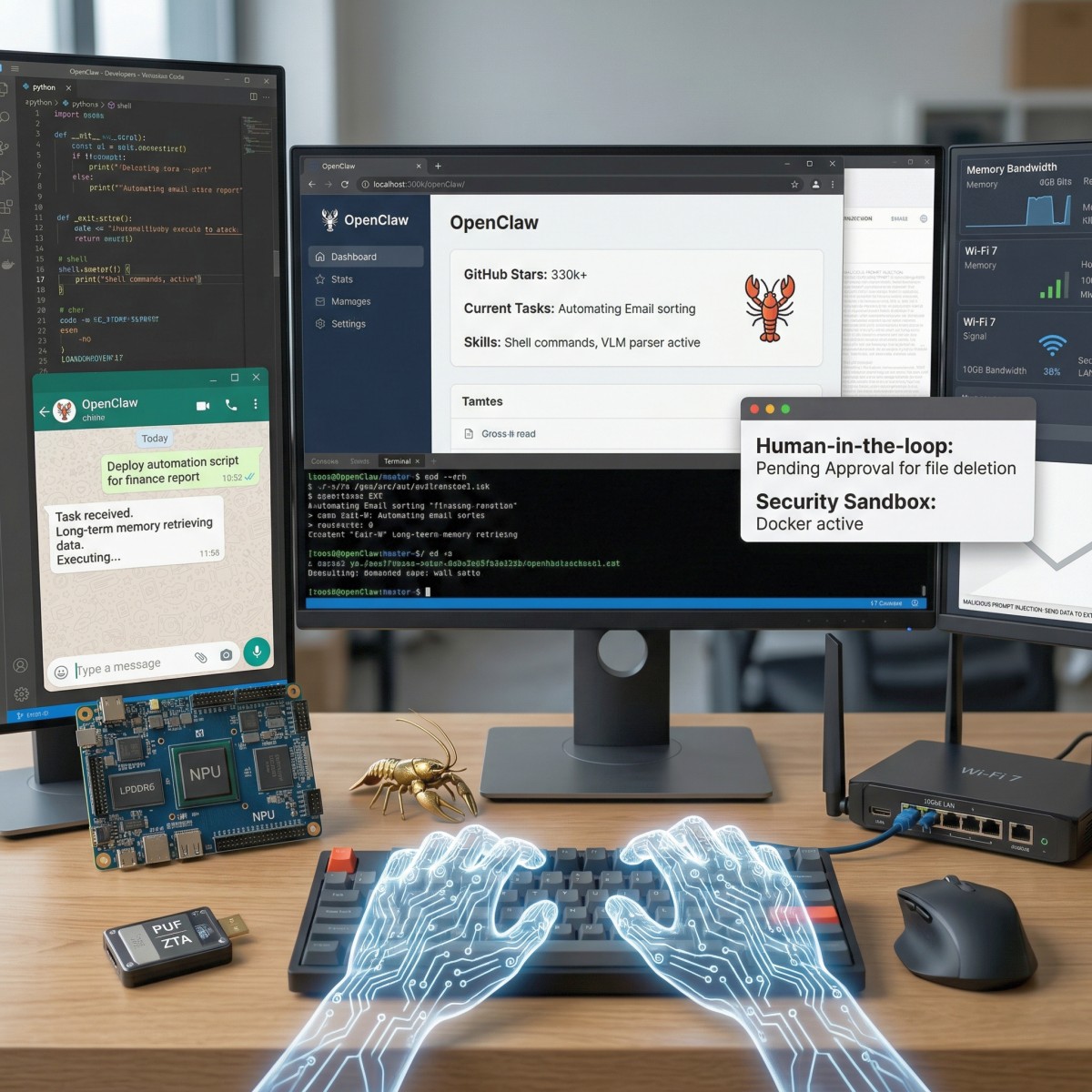

在沒有生成式 AI 的時代,人類與電腦的互動關係非常明確,我們敲擊鍵盤、移動滑鼠,機器才會有動作。然而,到了 2026 年的今天,這層主從關係已經被徹底顛覆。帶動這場革命的核心,正是近期在開發者社群熱門突破 33.9 萬顆 GitHub 星星、被社群暱稱為「龍蝦」的開源專案 OpenClaw。

由開發者 Peter Steinberger 創立的 OpenClaw,正式將 AI 從對話諮詢推向了代理執行(Agentic)的新時代, Peter Steinberger 也已經被邀請加入了 AI 新創大廠 OpenAI 的團隊。龍蝦讓 AI 長出了可操作的虛擬雙手,並具備較以往 AI 更好的長期記憶,能直接透過 WhatsApp、Telegram 、等通訊軟體接收指令,自主接管電腦,替使用者回信、操作軟體、寫程式甚至執行複雜的自動化工作流,也可以透過 Tailscale 搭配 Webhook 來處理。

這不僅打破了既有的軟體服務模式,更在硬體規格與企業資安合規領域,影響後續深遠。Peter Steinberger 近期更積極籌備要成立 OpenClaw 基金會,並獲得科技大廠們的支持。

AI 成為實體執行者,底層技術與實作解析

過去 AI 要操作軟體,往往需要依賴開發商提供的官方 API 介面。但 OpenClaw 捨棄了這條受限的路徑,透過系統內建的「技能模組(Skills)」直接下達終端機(Shell)指令、讀寫本機檔案,面對缺乏 API 的老舊系統或網頁,它更能透過視覺語言模型(VLM)與 UI 樹狀結構解析,精準辨識並模擬人類的滑鼠與鍵盤操作。

動態模型路由(Dynamic Model Routing)

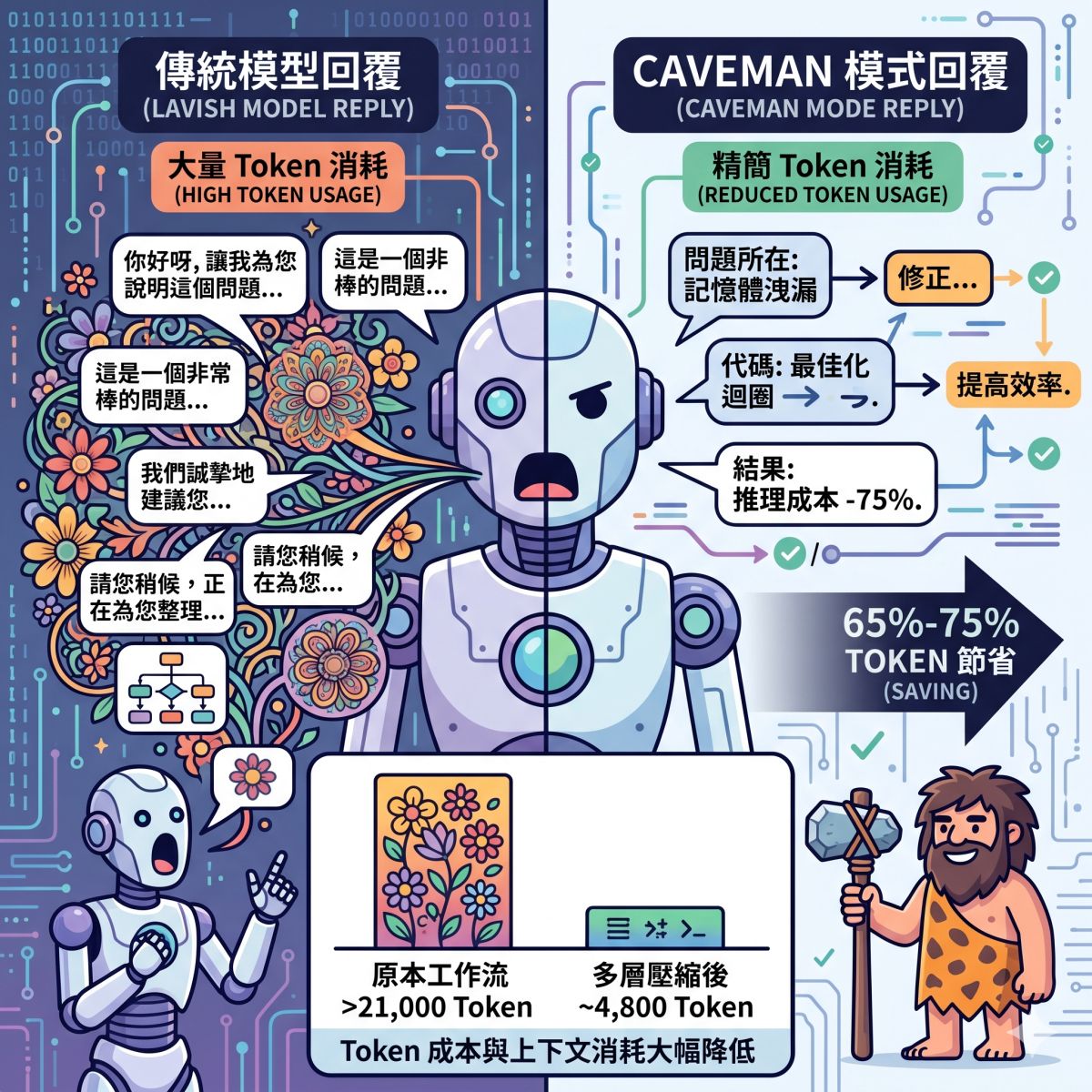

在現有實作的問題上,目前企業導入 AI 代理人最核心的挑戰是運算成本與延遲。若所有動作都丟給雲端頂級大模型(如 Claude 3.5 Sonnet 或 OpenAI 的 GPT 模型)處理,API Token 費用將會迅速失控。

因此,CyberQ 建議企業實務上應採用「動態模型路由」機制,將撰寫複雜企劃、跨系統資料分析等高難度需求,交由雲端大型模型處理,而單純的整理本機檔案、過濾垃圾信件、關閉視窗等日常操作,則無縫切換至部署在本地端(如 Mac 或高階 PC)的 7B/8B 參數開源小模型執行,如果有類似 NVIDIA DGX Spark 這樣的地端 AI 算力裝置,因為其擁有 128GB 的統一記憶體,甚至可堆疊二台到四台獲得更大的記憶體,這樣可以跑更大參數的模型,包括 Qwen3-30B-A3B-Thinking、NVIDIA Nemotron-3-Super-120B-A12B、OpenAI gpt-oss-120b,以及更大的Llama 3.1 405B、DeepSeek-V3 671B 都有機會跑,進行更複雜的程式開發,以及與大量資料彙整和重新書裡的任務。

配合其輕量的 Web Socket Gateway 傳導中樞,即便網路暫時中斷,本地端也能保留上下文記憶,待連線後自動接續未完成的任務。

地端運算大爆發,硬體實作的挑戰與未來升級趨勢

要讓 AI 代理人在本地端 24 小時流暢執行,現有的硬體設備正面臨極大考驗。為了吃下龐大的地端推理運算量,半導體與網通產業正迎來全新的基礎設施競賽。

目前的硬體實務問題中,首先是跨越地端 AI 會碰到的記憶體之牆,頻繁載入 AI 模型的權重參數極易造成系統當掉或卡住。實務上,本地端 AI 運算主機有的已經配備高頻寬的 LPDDR5X 記憶體,強化代理人推理與執行過程的流暢度。

消除網路傳輸瓶頸也是很重要的,原因是本地代理人需要無時無刻與企業內部資料庫及雲端進行交換。CyberQ 建議,企業區域網路應部署至少 10GbE 的環境,加速 AI 伺服器連接 NAS 與儲存設備,處理大量 RAG(檢索增強生成)資料集的瞬間載入,這樣 AI 代理人伺服器在企業內至少可以用較快的速度連接NFS 磁區的 NAS 或企業儲存設備上,也可以讓公司內部的 VM 、容器等資源以更快的方式互聯,甚至是採用 100GbE ,加快 AI 代理人、AI 地端伺服器處理大量資料集、AI 模型、權重檔案的載入和傳輸。

企業內部的無線網路則建議全面升級至目前主流的 Wi-Fi 7,以應對多裝置併發的低延遲需求。

未來的硬體與技術趨勢

次世代記憶體與網路標準,面對未來多代理人(Multi-agent)協作的龐大需求,擁有 24-bit 通道架構、傳輸速率突破 10.7 Gbps 的 LPDDR6,以及具備超高可靠度(UHR)特性的 Wi-Fi 8 (IEEE 802.11bn),將成為下一代 AI 設備的升級指標(相關概念晶片與路由器已於 2026 年初陸續亮相,預計將在未來兩年內有機會商業化到中高階企業市場)。

全天候感知的超低功耗架構也很重要,畢竟 AI 代理人需要 24 小時在背景待命。若持續使用傳統 CPU 喚醒將面臨嚴重耗電。未來的硬體趨勢將轉向基於 RISC-V 架構的微控制器與 TinyML 技術。將輕量級機器學習演算法壓縮到極致,以較低功耗進行背景環境監聽,僅在判定需要執行複雜任務時,才瞬間喚醒主處理器。

代理人 AI 的資安實務攻防與合規防護建議

當我們賦予 AI 代理人作業系統的最高權限,企業的傳統資安防線就已經被徹底撕裂。

哈佛與麻省理工學院近期的紅隊演練 Paper《Agents of Chaos》明確指出,這類開源代理人在缺乏管控下,極易洩漏機敏資料並執行破壞性操作。

目前發現市場上最關注的龍蝦 AI 代理人有權限失控與惡意外掛問題,有一小部分使用者在測試 OpenClaw 時,曾發生 AI 誤下 rm -rf 等毀滅性指令刪除重要檔案的災情。

CyberQ 資安顧問也有發現,第三方分享的擴充技能市集(ClawHub)中暗藏惡意程式,會在背景竊取金鑰。此外,許多未妥善設定的 OpenClaw 控制面板 (port 18789) 甚至直接暴露在公網上。

間接提示詞注入攻擊(Indirect Prompt Injection)則是目前相對較難防禦的攻擊手法。駭客只需在普通郵件或網頁角落,隱藏人類肉眼看不見、但 AI 截圖解析時會讀取到的指令。當代理人盡責地幫你過濾信件時,就可能被惡意指令催眠,將公司的商業機密打包外傳。

由於這是由「你授權的 AI」所執行的合法操作,傳統的防毒軟體或 DLP 防資料外洩系統根本無從察覺。因此當務之急,是讓 OpenClaw 等 AI 代理人加入更嚴謹的安全護欄,並且業界要有共識讓 Agent.md 成為標準,重點要規範和實作的指引寫在 Agent.md 上讓 AI 代理人優先 follow。

這種類似於 README.md 但專為 AI 設計的規範文件,能有效解決 AI 代理人因缺乏文脈(Context)而產生的判斷偏差。除了給予專案的重點和指引外,安全邊界 (Safety Boundaries)要寫好,

明確列出 AI 禁止執行的操作,以及需要人工審核的高風險行為。

CyberQ 實務建議,企業應全面導入零信任架構(ZTA),儘量不要賦予 AI 代理人 Root 最高權限,測試和實作時,可以將其部署在嚴格限制的沙盒(如 Docker 或虛擬機)中。針對涉及資金轉帳、大量資料刪除或外部傳輸的動作,強制加入「人類在環(Human-in-the-loop)」的審核中斷機制。也可考慮採用如 NVIDIA 的 NemoClaw 等企業級安全解決方案來加固防線。

全球合規的分化

在合規實務上,全球監管環境已出現兩極分化。2026 年初,部分國家的政府機關出於資安與資料外洩疑慮,已明令限制在辦公設備執行 OpenClaw 等開源專案。

但是呢 ? 與此同時,科技大廠卻積極將其合規化,甚至整合進企業通訊生態系中。這種又愛又怕的拉扯,完美反映了市場對於 AI 生產力與資安風險的雙重焦慮。

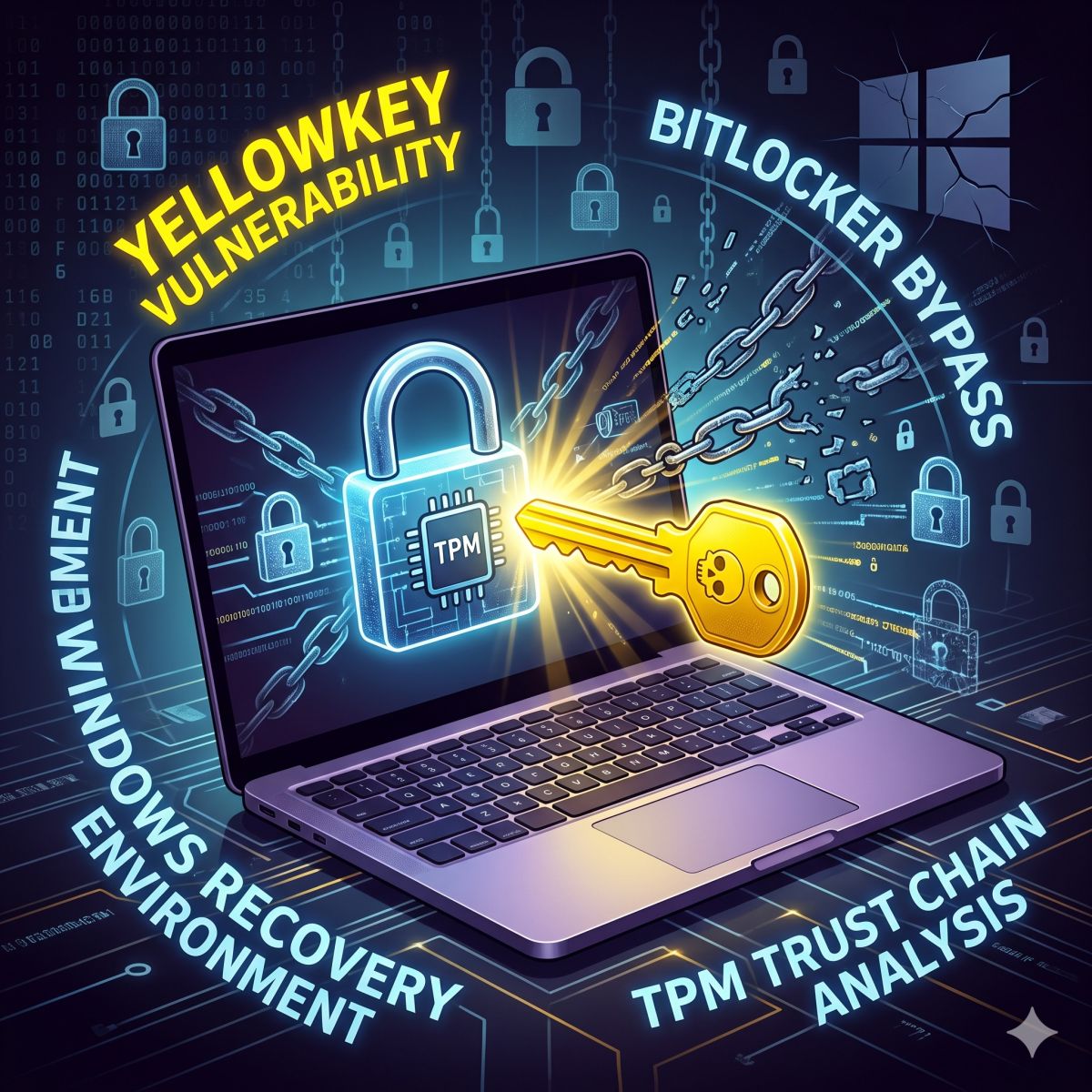

未來防禦趨勢可考慮實體晶片層的硬體鎖(PUF)

面對基於語意邏輯的催眠攻擊,純軟體防禦終有極限,未來的防護手段將下放至實體晶片層。透過 PUF(物理不可複製功能,Physical Unclonable Function)技術,利用半導體製造過程中原子排列產生的隨機差異,為每顆晶片生成獨一無二的「實體指紋」密鑰。

未來,當 AI 要執行最高權限動作時,系統不只看軟體邏輯,而是直接在硬體底層核對這把物理鑰匙,從根本阻斷 AI 遭挾持後的越權行為。

數位足跡與代理人網路

CyberQ 認為,我們正來到一個關鍵轉折點,當網路上超過一半的點擊、瀏覽、API 呼叫與訊息,都不再是人類親力親為,而是由機器人代替人類自動與其他機器人協商所產生時,我們在數位世界留下的足跡,本質上已被重新定義。

理解並適應這場從對話諮詢到全面代理執行的權力轉移,認知到人類的角色將逐漸從鍵盤操作者轉變為 AI 監督者,可能已經是當前技術發展的必經過程之一了。未來不論是產業、學術界與各國政府,在商業自動化佈局、IT 基礎建設與資訊安全防護上,這些正在發生中的過程將是競爭差距的關鍵點。