在前文 你的電腦跑得動本地 AI 嗎?CanIRun.ai一鍵硬體檢測神器解析與效能解密 的解析中,我們看到了 Apple 的統一記憶體(Unified Memory)架構在本地端 AI 領域展現了不錯的優勢。受惠於 CPU 與 GPU 共享同一塊高頻寬記憶體池的設計,Mac 避開了傳統 PC 常見的資料傳輸瓶頸,也就是資料需要在系統記憶體與獨立顯卡 VRAM 之間來回搬運。這讓 Mac 成為目前執行高參數 LLM 時,具備相對較高性價比的機器了。

為了讓廣大的 Mac 用戶們能更精準地挑選模型,CyberQ 以 Mac 客戶實作的經驗來評估,額外補充這份不同記憶體級距的模型選搭與採購建議。

你的 Mac 記憶體,決定了你的地端 AI 天花板

8GB 記憶體 (入門級 M1/M2 Air 等) 空間吃緊的求生術

8GB 設備的極限非常明顯,因為你必須保留至少 3GB 給 macOS 系統維持基本運作,剩下的空間才能給很弱的地端 AI 用,基本上CyberQ 是不建議你拿 8GB 記憶體的 MAC 去跑任何 AI 模型。

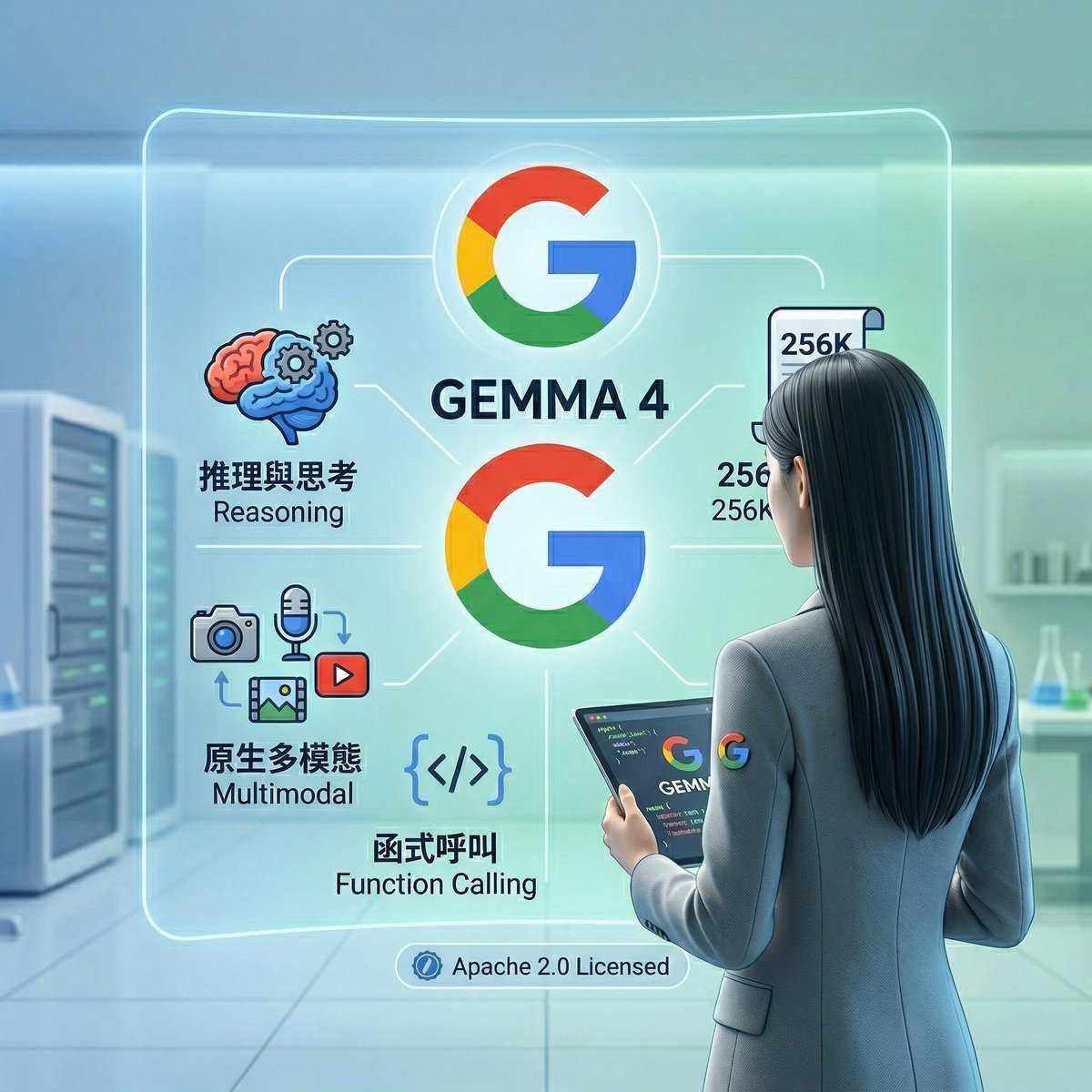

如果你還是想要在 MacBook Neo 這種機器上跑本地端 AI ,微軟的 Phi-4 Mini (3.8B) 、極度壓縮(Q2 量化)的 Qwen3-8B 或 Google Gemma 4:e2b,進行簡單部署勉強可用。

16GB ~ 24GB 記憶體:日常工作與程式開發的較低規格區

這個區間的 Mac 已經能順暢跑動市面上多數的優質中小型模型。包括 MacBook Air、MacBook Pro 與 Mac Mini 都很適合,這區間的記憶體價格也相對較低成本可購入。

CyberQ 認為包括 Qwen2.5-14B (Q4 量化) 是這個量級下的可用模型,能在留下 IDE 開發軟體所需空間的同時,處理 Python 或 Rust 程式碼,生成速度可達 35-45 tok/s,另外來自中國的 GLM-4-9B (Q8 高精度) 也是可選之一,而最新的 Google Gemma 4:e4b 一定能跑,Gemma 4:26b 就很勉強了,如果你的 Mac 有 24GB 記憶體,就還可以用,只是會慢。

36GB ~ 64GB 記憶體 (M3 Pro / M4 Pro/Max):可接近 GPT-4 級的生產力

在這個容量下,你可以負擔得起較高精度的量化模型,這能大幅降低 AI 亂說話的幻覺(Hallucination)。包括 MacBook Pro 、Mac Studio 與 Mac Mini 都很適合。

可採用 Qwen3-Coder 32B (Q6) 進行專業級專案代碼重構,或使用 Mixtral 8x7B 進行快速腦力激盪。若願意犧牲一點速度,甚至能執行負責高層戰略推理的 Llama 3.1 70B (Q3 量化)。

96GB ~ 512GB 記憶體 (Mac Studio / 頂規 MacBook Pro):中大型模型可跑

過去需要花費龐大資金建置資料中心才能跑的模型,現在 Mac 大容量記憶體的單機工作站就能解鎖。

如果你擁有 256GB 記憶體可跑動 Llama 3.1 405B,擁有 512GB 記憶體的的話,甚至能裝載震撼業界的 DeepSeek-V3 / R1 (671B, Q4 量化),讓你在消費級硬體上體驗不可思議的思維鏈 (Chain of Thought)深度推理能力,或是執行 Command R Plus (104B) 來讀取整個龐大企業文件庫進行 RAG 檢索,但這樣投入的購買金額就會非常高了。

Mac 平台 採購價格比較表

以下是 CyberQ 彙整的 Mac 平台若要能夠跑 AI 運算的採購價格比較表,可和上面的資料做對照參考。32GB 記憶體是基本低消,64GB 對開發者來說就算是夠用了,128GB 則能夠做更多事情,網路上還有人疊加多台上去跑 MAC 算力叢集的。

| 設備型號 | 32GB (或 36GB) | 64GB (或 72GB) | 128GB |

| Mac mini | ~NT$ 33,900 (M4 / 32GB) | ~NT$ 67,900 (M4 Pro / 64GB) | 不支援 |

| MacBook Air | ~NT$ 49,900 (M5– / 32GB) | 不支援 | 不支援 |

| MacBook Pro | ~NT$ 68,900 (M5 Pro / 32GB) | ~NT$ 102,900 (M5 Max / 64GB) | ~NT$ 172,400 (M5 Max / 128GB) |

| Mac Studio | NT$ 67,900 (M4 Max / 36GB) | ~NT$ 92,400 (M4 Max / 64GB) | ~NT$ 120,400 (M4 Max / 128GB) |

榨乾 Mac 效能的 3 個規則

如果你準備好透過終端機,也就是官方推薦使用介面極簡的 Ollama 進行環境建置,新版 Ollama 已經針對蘋果 M 系列晶片使用的 MLX 最佳化,可以在 Mac 上大展身手,CyberQ 建議以下幾點。

死守60% 記憶體防線,千萬不要貪心讓模型把記憶體塞滿。為了確保系統穩定不崩潰,載入的模型權重(Weight)大小盡量不要超過總記憶體的 60%。剩下的 40% 空間必須留給 macOS 系統,以及會隨著你跟 AI 聊天字數不斷膨脹的KV Cache(上下文快取記憶體)。

開啟蘋果專屬加速機制,確保你的運行環境有開啟並支援針對 Apple Silicon 最佳化的 Flash Attention (GQA 分組查詢注意力) 技術,這能大幅降低處理「長文本」或超大上下文視窗時所吃掉的記憶體容量。

注意主動散熱避免處理器和 GPU 降頻運轉,本地 AI 推論是非常高壓密集的計算任務。如果你正在用 MacBook Pro (筆電) 跑大模型,請務必架高筆電散熱或手動透過軟體將風扇轉速拉高。避免晶片在長時間運算下因過熱而啟動降頻保護(Thermal Throttling),導致 AI 吐字速度雪崩式下滑。

CyberQ 認為,在 AI 時代,未來升級設備時,RAM 記憶體的大小絕對比 CPU 核心數更重要! 結合 CanIRun.ai 的硬體健檢與這份專屬選型指南,你的 Mac 們,有機會成為適合自己且完全私密無限制的專屬 AI 工作站。