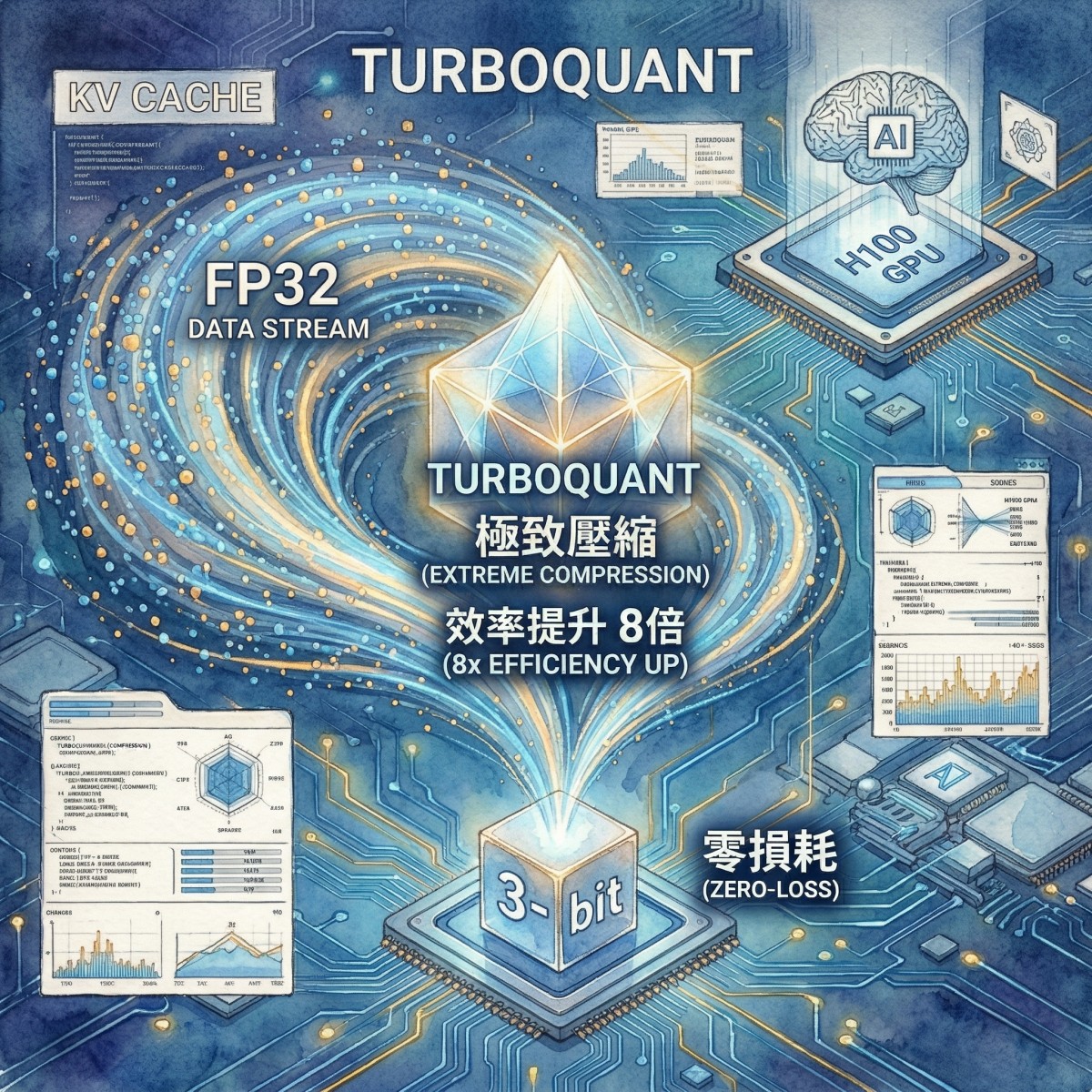

在當今的 AI 發展中,大型語言模型(LLMs)與向量搜尋引擎雖然展現了驚人的能力,但其背後的硬體資源消耗也成為了企業與開發者面臨的重大挑戰。特別是在處理長文本或複雜上下文時,鍵值快取(KV Cache)的記憶體佔用往往會成為系統效能的瓶頸。

為了解決這個資源耗損的問題,Google Research 近期發表了全新的壓縮演算法 TurboQuant。這項技術透過理論基礎紮實的量化機制,在不犧牲模型準確度的前提下,實現了優秀的記憶體壓縮比例,為 AI 架構設計帶來了新的進步。

如何減少記憶體額外開銷?

TurboQuant 的核心在於解決傳統向量量化技術中常見的「記憶體額外開銷(Memory Overhead)」。傳統方法在量化時,通常需要針對每個小區塊儲存全精確度的常數,這反而削弱了壓縮的整體效益。

TurboQuant 巧妙地結合了兩項即將在 ICLR 2026 與 AISTATS 2026 發表的關鍵演算法:

PolarQuant(極座標量化):這是一項跳脫傳統思維的壓縮技術。它放棄了傳統的笛卡兒座標系(X, Y, Z),轉而將向量轉換為極座標。透過分離「半徑」(代表資料的強度)與「角度」(代表方向或語意),演算法能夠將資料映射到固定且可預測的圓形網格上。這種做法免去了系統執行昂貴的資料正規化步驟,徹底消除了傳統方法必須承擔的記憶體額外開銷。

QJL(量化 Johnson-Lindenstrauss 轉換):這是一種零額外開銷的 1 位元技巧。在 PolarQuant 完成高品質壓縮後,TurboQuant 會保留微小的 1 位元壓縮能力給 QJL。QJL 宛如一個數學除錯機制,能夠消除幾何轉換中殘留的偏差,確保注意力分數(Attention Score)的計算精確度不受影響。

3-bit 壓縮與 8 倍加速效能

在包含 LongBench、Needle In A Haystack 等標準長文本基準測試中,TurboQuant 展現了令人驚豔的技術重點:

極致壓縮且零準確度損失:TurboQuant 能夠將 KV 快取極端量化至僅需 3 位元(3-bit),且過程中完全不需要對模型進行重新訓練或微調,模型的推論準確度亦絲毫不受影響。

大幅降低記憶體足跡:在長文本的「大海撈針」測試中,不僅維持了完美的下游任務表現,更將 KV 快取的記憶體體積縮減了至少 6 倍。

硬體加速最佳化:在 H100 GPU 運算環境下,4 位元的 TurboQuant 相較於 32 位元未量化的金鑰,在計算注意力邏輯(Attention Logits)時,達到了高達 8 倍的效能提升。

硬體市場的震撼與「Google 的 DeepSeek 時刻」

然而,TurboQuant 帶來的顛覆性影響遠不止於系統架構與資安層面,它更在資本市場與硬體產業鏈投下了震撼彈。就在技術發表後,投資人擔憂 AI 對記憶體的龐大需求將被演算法大幅削減,隨即引發了美光、三星與 SK 海力士等大廠的恐慌性拋售潮,Cloudflare 執行長 Matthew Prince 更將此突破形容為「Google 的 DeepSeek 時刻」。

但從產業發展的長遠視角來看,這其實是科技史上經典的「傑文斯悖論(Jevons Paradox)」。TurboQuant 帶來的本質並非消滅硬體需求,反而是有機會讓我們能釋放更多的算力潛能。TurboQuant 憑藉其與資料無關(Data-oblivious)且無需重新訓練的隨插即用特性,開源社群在短短數日內便火速將其整合至主流的推論框架中。

當 AI 的記憶體稅被演算法大幅削弱,反而會促使開發者無縫解鎖百萬 Token 級別的超長文本應用。長遠而言,這項底層技術的突破打破了阻礙長文本 AI 普及的記憶體高牆,未來在大邊緣運算與智慧應用,預期將會更無所不在,市場也會進入黃金階段。

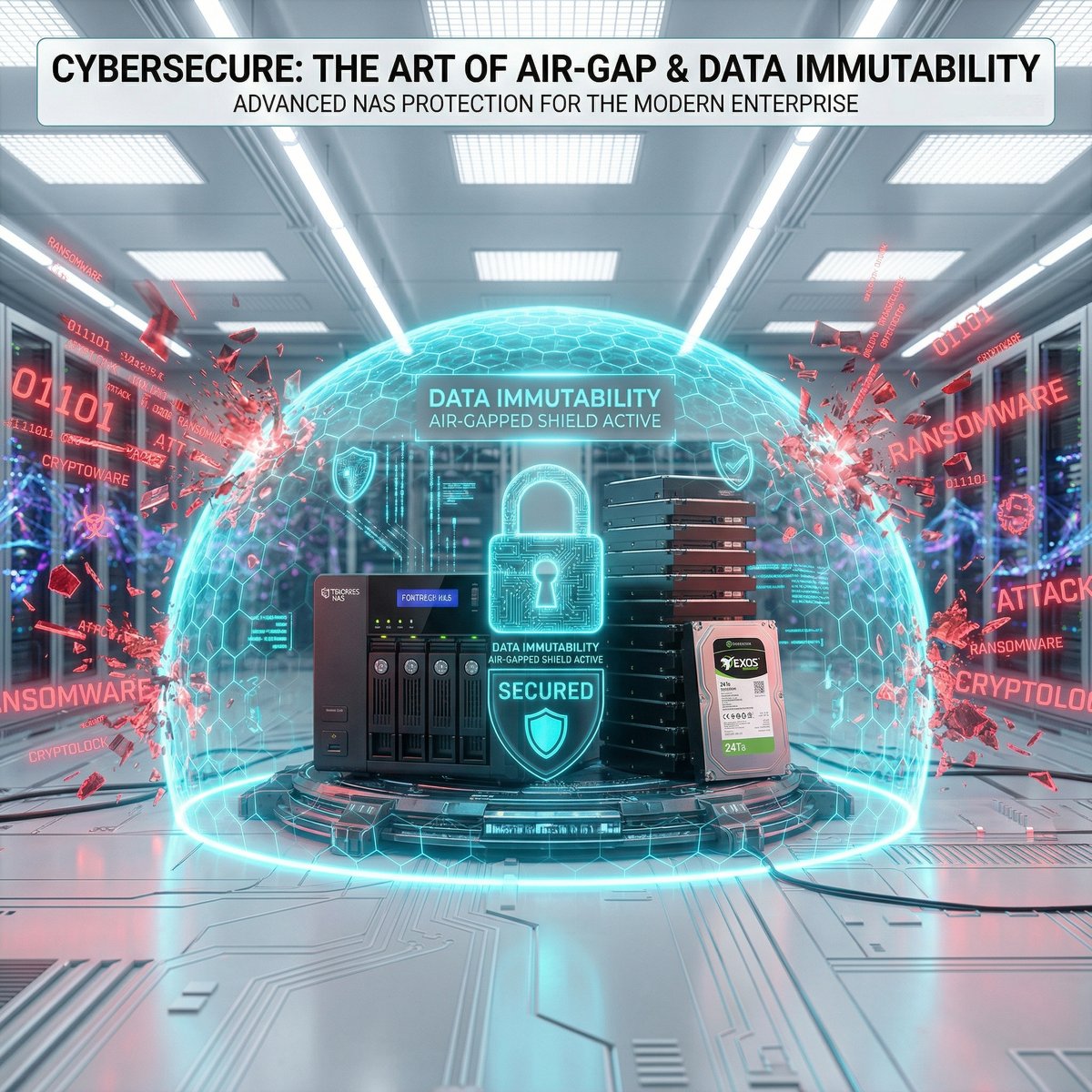

產業影響與架構安全意涵

CyberQ 認為,從系統架構與資訊安全的角度來審視,TurboQuant 的突破不僅僅是替伺服器省下成本。當我們能夠用極低的記憶體來執行強大的 AI 模型時,這意味著將大型語言模型部署於邊緣設備(Edge Devices)或地端伺服器的技術門檻大幅降低。

對於受限於資安合規要求、無法將敏感資料隨意上傳至公有雲的企業或金融機構而言,高效率的本地端部署將變得更加可行且經濟。此外,對於科技大廠而言,這項技術也將全面提升語意搜尋引擎在處理大量高維度向量時的檢索效率。

TurboQuant 及其背後的 PolarQuant 與 QJL,不僅是工程上的實用解法,更是具備嚴謹數學理論證明的演算法突破。隨著 AI 技術逐漸深入企業核心系統與關鍵基礎設施,這種兼顧運算效能與系統穩定性的底層架構改良,將是推動下一代智慧應用的關鍵一步。