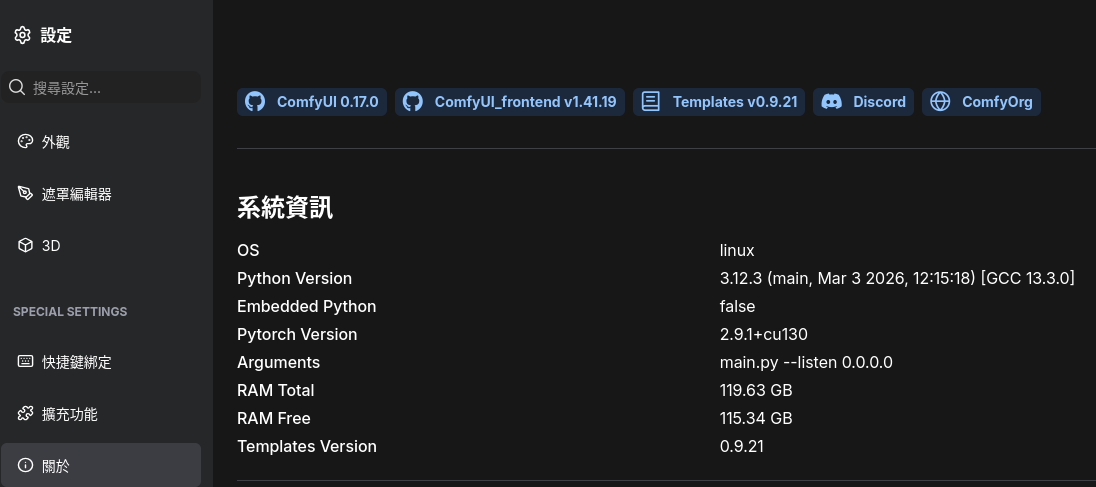

ComfyUI 近期釋出了 v0.17.0 版本更新(並迅速透過修補程式推進至 v0.17.1),為 AI 圖像生成的工作流程帶來了顯著的底層架構升級與效能改善。本次更新不僅在資源管理上導入了非同步機制,更針對近期熱門的 Flux 與 Qwen 模型擴充了支援能力,同時大幅改善了記憶體與例外狀況的處理機制。

CyberQ 實裝 ComfyUI v0.17 和 ComfyUI v0.17.1 後測試,以下為本次更新的核心更新重點。

系統架構與記憶體管理最佳化

對於需要長時間運行或處理大型工作流的使用者與開發者而言,資源調度與記憶體管理仍舊是本次更新的重頭戲。

模組化資源管理 (Modular Assets)的部份,新版導入了全新的模組化架構,並實作了非同步的雙階段掃描器 (async two-phase scanner) 與背景播種器 (background seeder)。這將有效改善資源載入的效率與系統整體的反應速度。

針對底層運算繼續進行了最佳化,進一步降低了 KV Cache 的記憶體使用量,有助於在有限的 VRAM 環境下執行更複雜的生成任務。

例外處理與相容性提升: 將 OOM_EXCEPTION 範圍擴展至 AcceleratorError 形式,並增加防護機制以確保與 torch < 2.8.0 版本的向下相容性。此外,也修復了部分模型在 batch_size > 1 時出現的錯誤。

先進模型支援 Flux 與 Qwen 系列

隨著開源模型生態的快速演進,ComfyUI 也在第一時間跟上了最新模型的需求。

Flux 2 支援新增 FluxKVCache 節點,正式支援 Flux 2 klein kv cache 模型。同時也為 Flux 模型加入了 pre-attention patches 的擴充途徑。

針對 Qwen 圖像模型,新增了 pre-attention 與 post-input patches,提升了模型微調與控制的靈活度。

LoRA 載入也就做出了修復, 解決了包裹模型 (wrapped models) 在載入文字編碼器 (Text Encoder) LoRA 時遇到的錯誤。

節點擴充與前端介面升級

使用者體驗與實用工具節點也在此次更新中繼續擴展。

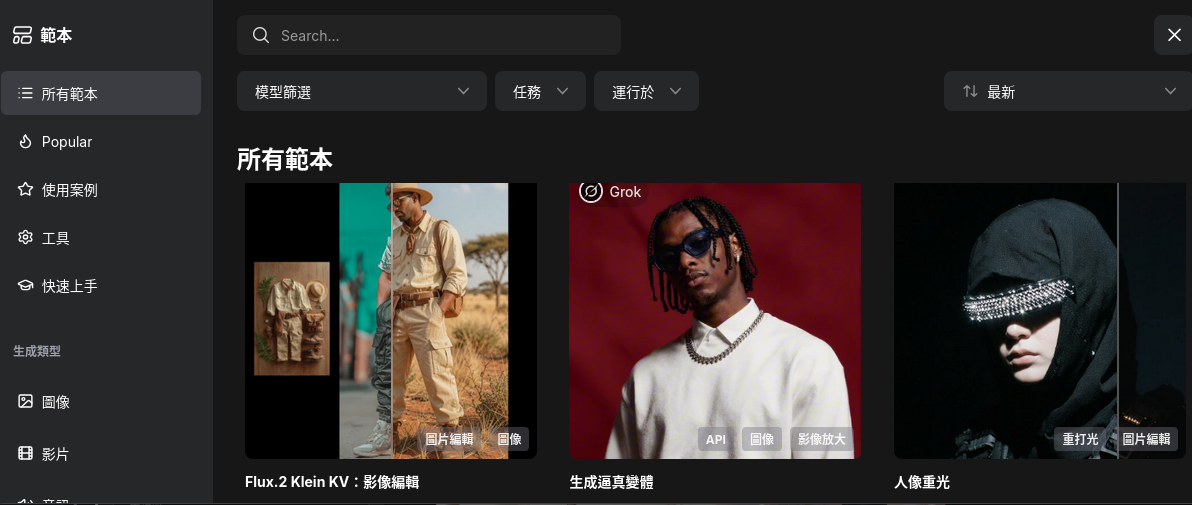

CyberQ 也測試了全新節點,這次新版增加了實用的 painter node(繪圖節點)以及 Reve Image API 節點群。

前端與模板更新的部份呢,前端套件 (comfyui-frontend-package) 一路升級到 1.41.19,並將官方工作流模板更新至 v0.9.21。此外,針對 Float gradient_stops 也調整為與前端相容的格式。

ComfyUI-Manager 也針對引導做了最佳化,在未安裝 ComfyUI-Manager 的環境下,系統現在會提供更明確的安裝引導提示。

開發者與除錯體驗強化

針對開發者與進階除錯需求,底層程式碼也進行了多項調整:

啟用 Python Faulthandler: 在主程式中開啟了 faulthandler,這對於追蹤底層 C 語言層級的崩潰(例如 Segmentation fault)將提供幫助。

現在允許模型更新 (model patches) 包含自定義的清理函數 (cleanup function),有助於避免記憶體洩漏與狀態污染。

在模型偵測階段,改為深度複製 (deep clone) 預先編輯過的權重,提升了模型狀態切換時的穩定性。

另外,原先計劃加入的外部分散式快取 API (CacheProvider) 在此次更新中被暫時還原 (Reverted),預期官方將在後續版本中進行更完善的調整。

CyberQ 認為,ComfyUI v0.17 透過模組化與記憶體最佳化穩固了底層基礎,也導入了 Flux 與 Qwen 等次世代模型的特殊需求。對於開發者而言,新增的除錯工具與生命週期管理機制,也將大幅降低開發自定義節點與更新的門檻,值得優先生升級使用。