Anthropic 最近針對開發流程中的審查瓶頸,正式發表了名為 Claude Code Review 的新功能。這項功能是利用 AI 代理,協助開發團隊針對 Pull Request 進行自動分析,捕捉人類審查可能遺漏的邏輯錯誤與安全性漏洞。

多代理系統與深度審查機制

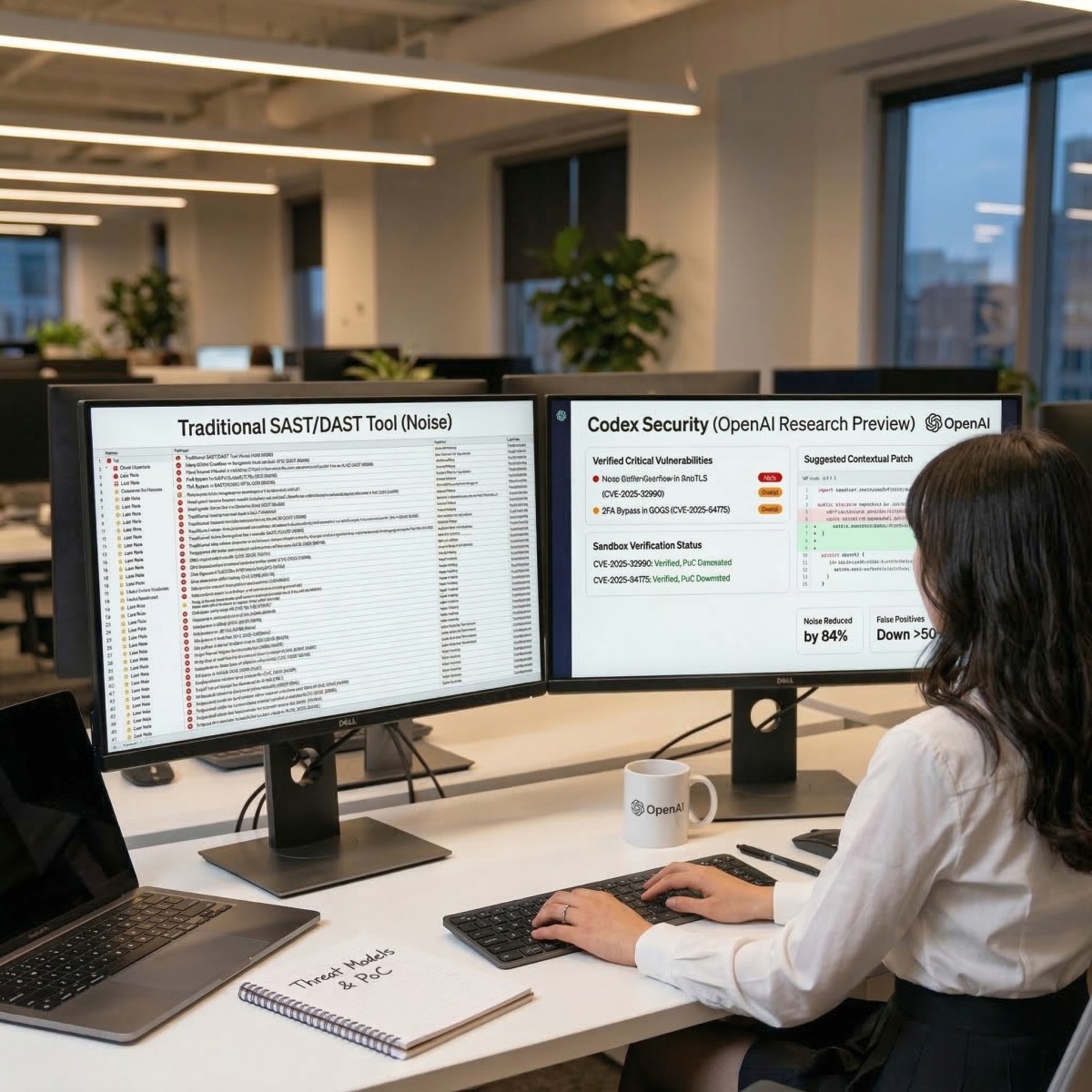

Claude Code Review 的核心在於採用多個 AI 代理平行運作。當開發者提交 PR 後,系統會派遣一組專門的代理團隊,分別針對程式碼邏輯、安全性以及潛在的迴歸錯誤進行檢查。這套系統除了進行程式碼掃描,也會結合程式碼儲存庫上下文的背景資料,進行深度驗證,設法過濾錯誤訊息。

與過去開放原始碼的 GitHub Action 版本相比,這項新功能更強調分析的深度。系統會在審查完成後提供單一的高品質總覽意見,並在有問題的程式碼行中附上具體標註。

審查結果會根據嚴重程度標記標籤,例如 Normal(代表應修復的錯誤)、Nit(代表細微建議)或 Pre-existing(代表程式碼庫原本就存在的錯誤)。

解決開發過程中的審查瓶頸

根據 Anthropic 內部的測試資料,這項工具在公司內部推行後,工程師的產出效率提升了高達兩倍之多。

在部署這套系統前,僅有百分之十六的 PR 會收到實質的審查建議。在導入 Claude Code Review 後,該比例大幅上升至百分之五十四。也就是說,AI 的協助能讓人類更專注於關鍵的架構決策,而將繁瑣的錯誤檢查交給機器。

還有一點值得我們留意,工程師對於被 AI 所標記的問題異議率極低,這可能代表該系統在控制誤判方面的表現相當穩定,確實能夠有效減少開發人員處理無效資訊的時間,進而提升整體的開發品質。

定價策略與市場反應

目前 Claude Code Review 尚處於研究預覽階段,僅開放給 Team 與 Enterprise 方案的用戶使用。定價模式採資料處理量計費,每次審查的成本平均落在15至15美元之間。

雖然在 Reddit 社群的討論中,部分開發者認為此定價與市場上其他月費制工具相比成本較高,但也有觀點認為,若是能提前攔截可能導致系統停機的重大錯誤,這筆投資對於公司而言就具有極高的價值。Anthropic 也指出,大型或複雜的 PR 會耗費較多代理資源與時間,平均審查時間會落在大約20分鐘。

CyberQ 觀點

CyberQ 認為當 AI 生成程式碼的產量已超越人力審查負荷時,開發重心將從追求速度轉向追求品質。

若能透過 AI 代理建立標準化的審查防線,這種預防性的投資將成為未來研發流程的重要環節。

首圖由 Nano Banana AI 生成