這個週末,人工智慧發展與國家安全的交集產了歷史性的事件。當前的美國政府是川普總統主導,其國防部之前已經改稱為戰爭部(Department of War),這次以史無前例的行政手段,對堅持 AI 倫理底線的 Anthropic 下達封殺令,並給予 6 個月的過渡汰換期。然而,就在 Anthropic 遭點名幾小時後,OpenAI 執行長 Sam Altman 迅速宣布與五角大廈達成協議,成功將其 AI 模型導入軍方機密網路。

這場看似單純的商業博弈,實質上重新定義了 AI 企業與政府軍事力量的互動規則,除了 AI 與商業公司在實作上的道德底線探討,也是我們可以觀察到在資訊安全、合規框架與底層架構設計的深度角力。

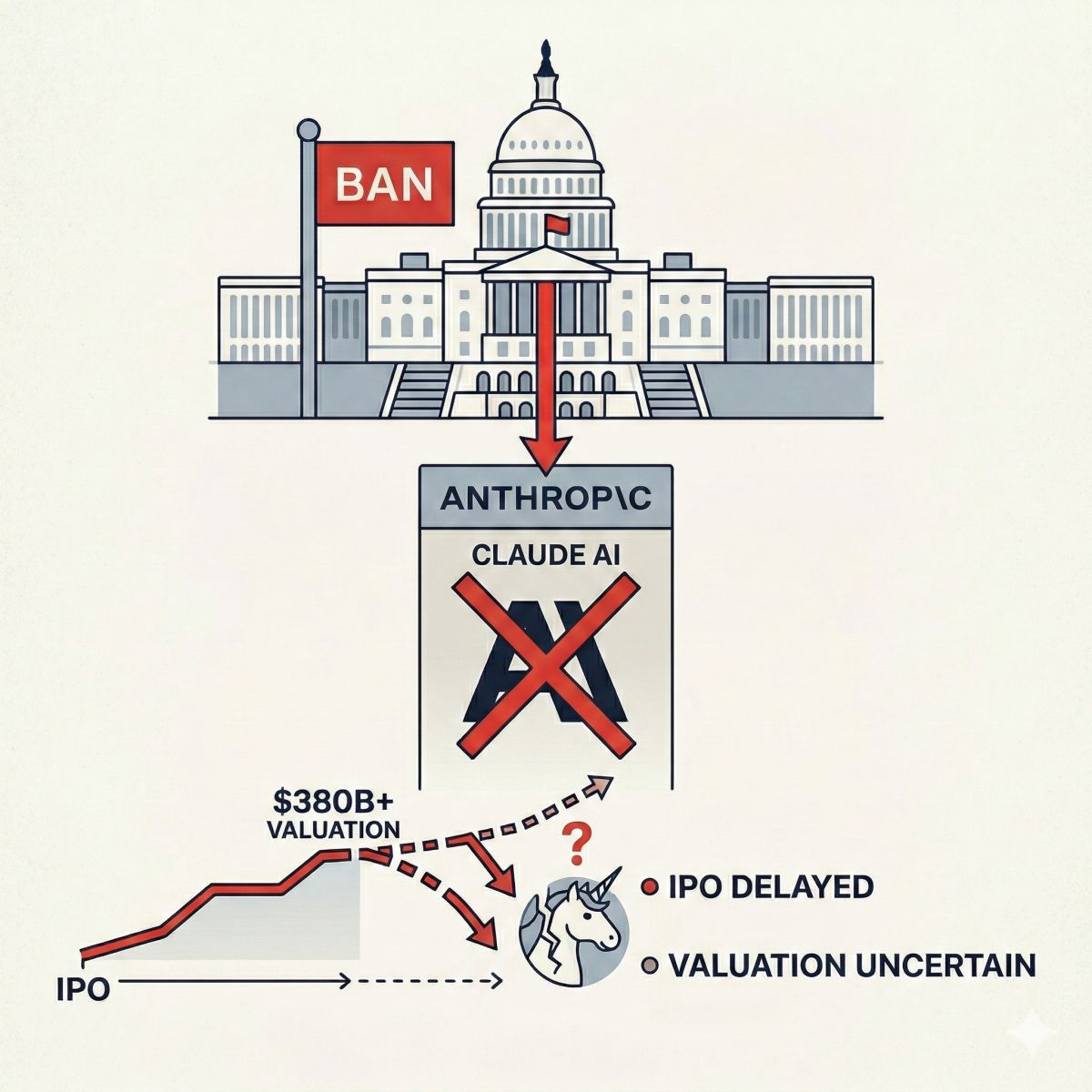

踩住紅線的代價是被武器化的供應鏈風險標籤

Anthropic 執行長 Dario Amodei 拒絕了五角大廈無限制使用的要求,堅守兩大紅線,也就是希望禁止 AI 用於國內大規模監控,以及禁止 AI 用於無人為干預的全自主武器系統。

從資安與合規的角度來看,川普政府隨後的反擊手段極具爭議性。戰爭部長 Pete Hegseth 將 Anthropic 標記為「供應鏈風險(Supply-Chain Risk)」。在過去的國防合規框架中,這個標籤幾乎專門用來防堵具有敵對國家背景(如中國)的科技企業滲透。如今,這個行政工具首次被內部化並武器化,用以懲罰一家拒絕修改服務條款(ToS)的美國本土企業。

這傳遞了一個新的現實,在國家安全機器的運作下,企業的使用者授權合約與倫理聲明,隨時可能面臨最高行政權力的強制覆寫。

OpenAI 的雙面刃是妥協,還是高明的合規工程呢?

OpenAI 成功拿下合約的關鍵,在於他們聲稱守住了與 Anthropic 相同的紅線,但採取了截然不同的談判與技術實作策略。OpenAI 並未在合約字眼上寫死,而是透過技術性防護措施(Technical Safeguards)來滿足合規要求。

從系統架構與程式開發的角度剖析,OpenAI 的策略包含兩個核心機制,首先是雲端隔離與邊緣計算的限制,OpenAI 這次有堅持將模型部署在受控的雲端基礎設施,我們推測為與其緊密合作的 Amazon Bedrock 相關安全環境,而非直接將模型權重(Weights)下放到軍方的邊緣設備(Edge Devices)。沒有邊緣部署,就從物理架構上大幅增加了將 AI 整合進全自動無人機或無人武器的難度。 這種透過架構限制來達成政策限制的手法,是非常典型的資安防禦思維。

前線部署工程師(FDEs)的監控是第二個重點,OpenAI 派駐具備安全許可的工程師與軍方並肩作戰,除了技術支援,也建立在機密網路內部的遙測(Telemetry)與稽核機制,以確保模型行為沒有偏離預定的人為責任規範。

國防合約重塑 AI 市場現況

這場風暴也徹底暴露了當前 AI 市場的資本現實。訓練與執行先進模型需要相當高的算力與資金,國防領域的大訂單,可說是所有 AI 大廠都無法忽視的重要合約,勢必搶破頭。而 Anthropic 正面臨著困境,如果失去聯邦政府的訂單,加上總統威脅的民事與刑事後果,將大幅增加其在 B2B 市場的合規疑慮與潛在客戶的信任成本。

OpenAI 重新扳回一局,藉由巧妙的談判,OpenAI 吃下了 Anthropic 留下的國防市場真空,更進一步鞏固了其作為美國的國家級 AI 基礎設施地位。矽谷雖有數百名工程師連署聲援 Anthropic,但資本與市場的流向可能會毫不留情地倒向合約的贏家。

當技術條款遇上國家意志

CyberQ 認為,AI 的競爭當然是已經跨越了參數規模(Parameter Size),也包含能源、人才等資源,現在還有政治操作與合規彈性的新階段。身處這個時代的科技從業人員必須認知到。技術本身的先進程度,已經無法單獨決定產品的生死。如何在極端的各種壓力 (如地緣政治、各種風向) 下,透過架構設計與合規工程來平衡商業利益與底線,才是未來 AI 企業生存的真正考驗。