AI 晶片大廠 NVIDIA 日前在 2025 Hot Chips 研討會上,公開了該公司未來三年的產品路線圖,以及一個全新的概念:「Scale-Across」,展現出不僅僅是硬體的升級,而是相關生態系的再擴大策略,想吸引業界更多廠商投入使用 NVIDIA 系列平台。

究竟什麼是「Scale-Across」?

面對近年 AI 模型的「大胃王」困境,NVIDIA 考慮新的分散式架構來滿足業界需求,CyberQ 觀察,這也隱含了未來各國政府在地緣政治與強化本身在地競爭力的政策方向中,無可避免地會要求有更多在地化的 AI 資料中心,強化各國的 AI 算力,不一定想依賴單一或集中化 AI 資料中心的可能性,而 NVIDIA 新的分散式架構方案,無型中也讓多邊 AI 協同運算在不同市場、產業中有新的方式去實作。

以當前 AI 模型越來越複雜,資料量越來越龐大,對於運算能力的需求也呈現爆炸性的成長。過去,我們習慣將越來越多的 GPU 塞進單一的資料中心,這種方式稱為「Scale-Up」。然而,這樣的作法很快就將面臨物理空間和能源供應的極限。以 Gigawatt 等級的 AI 資料中心來說,就塞了數十萬顆 GPU 來執行 AI 相關任務是可能的。

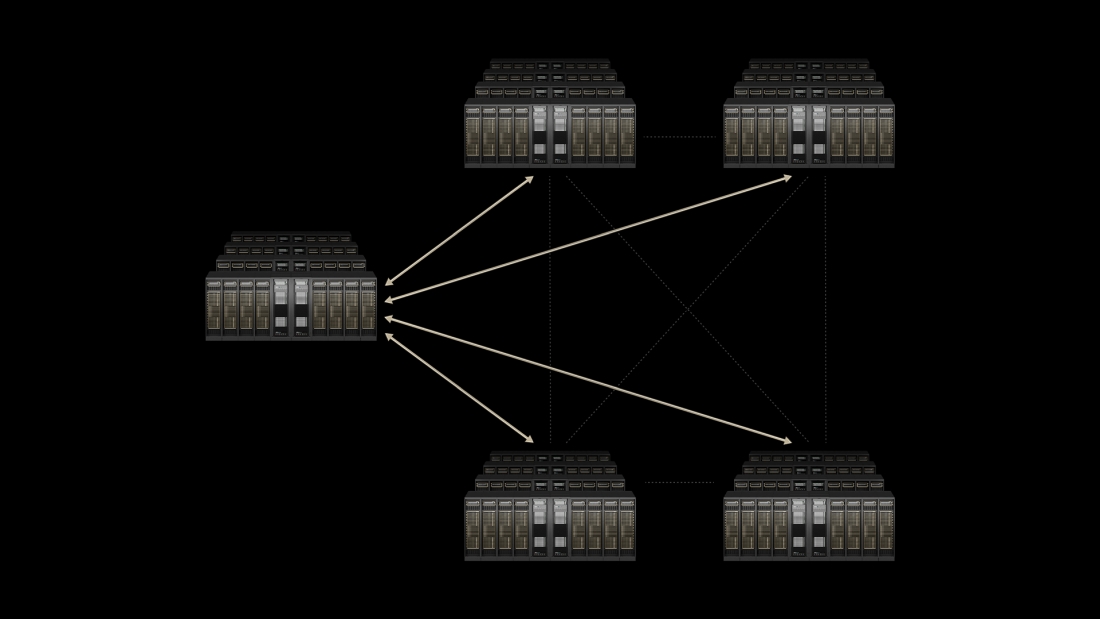

為了解決這個問題,NVIDIA提出了「Scale-Across」的概念。簡單來說,就是將多個分散在不同地理位置的資料中心,透過超高速的網路技術串聯起來,讓它們能夠協同運作,產生一個大型的 AI 超級大腦。

換個角度想像一下,未來 AI 的算力將不再受限於單一建築物的規模,而是可以橫跨城市、甚至國家,匯集全球的運算資源,共同處理最複雜的 AI 任務。這聽起來是不是有點夢幻呢? 更甚者,各國與各企業自己可以做出分散式 AI 算力結點在自己國內、境外等地方來做個別的整合。不同國際聯盟間也可以盟國自己組一個 AI 算力整合環境,把有需要的 AI 算力結點資料中心做串聯,需要保密和機敏的就自己分開。

實現「Scale-Across」的兩大秘密武器

當然,要實現如此宏大的願景,光有概念是不夠的,還需要強大的技術作為後盾。為此,NVIDIA 端出了兩項秘密武器:

Spectrum XGS 超高速資料傳輸

為了解決跨地區資料傳輸的延遲問題,NVIDIA推出了採用「矽光子」技術的全新交換器——Spectrum XGS。這項技術可以用光通訊來高速傳輸大量資料,實現前所未有的超高頻寬和超低延遲,確保不同資料中心之間的溝通暢行無阻。

NVLink Fusion 開放給第三方使用,打破門戶,廣邀盟友

過去,NVIDIA 的 NVLink 技術主要用於連接自家的 GPU。而新一代的 NVLink Fusion,則將這項技術開放給第三方的CPU和加速器使用。這一步棋,不僅展現了 NVIDIA 的開放姿態,也意味著他們希望建立一個更龐大、更多元化的AI生態系,想要吸引全球開發者與業界廠商們一同加入,去產生次世代的未來 AI 基礎設施。

從 AI 晶片霸主到 AI 基礎建設的夢想者 ?

從這次發表的產品路線圖和「Scale-Across」策略來看,NVIDIA 的野心顯然不僅僅是做一個 AI 半導體晶片供應商。他們更希望成為未來 AI 時代的「基礎建設領航者」,為即將到來的「Gigawatt」等級AI資料中心時代,鋪好最後一哩路。

這次 NVIDIA 透露出來的未來藍圖是有趣的,之前在業界也有分散式機櫃、分散式企業級儲存設備的概念,讓企業可以把不同大型儲存設備組成自己的儲存結點集區,做到更高等級的 HA ,而新世代的 AI 基礎建設則需要更高速的網路設備、優秀的演算法和更強大的資源分配與管理技術,可說是描繪了一部分 AI 運算的未來樣貌,對產業來說也是一種發展方向,預料近年這塊有機會成為新的資訊架構顯學之一。從「Scale-Up」到「Scale-Across」,實屬難得的跳躍進展。

CyberQ 認為 NVIDIA 的「Scale-Across」策略,有機會為 AI 領域帶來一些新的氣象,拭目以待觀察看看吧。

本文封面圖片由 AI 生成