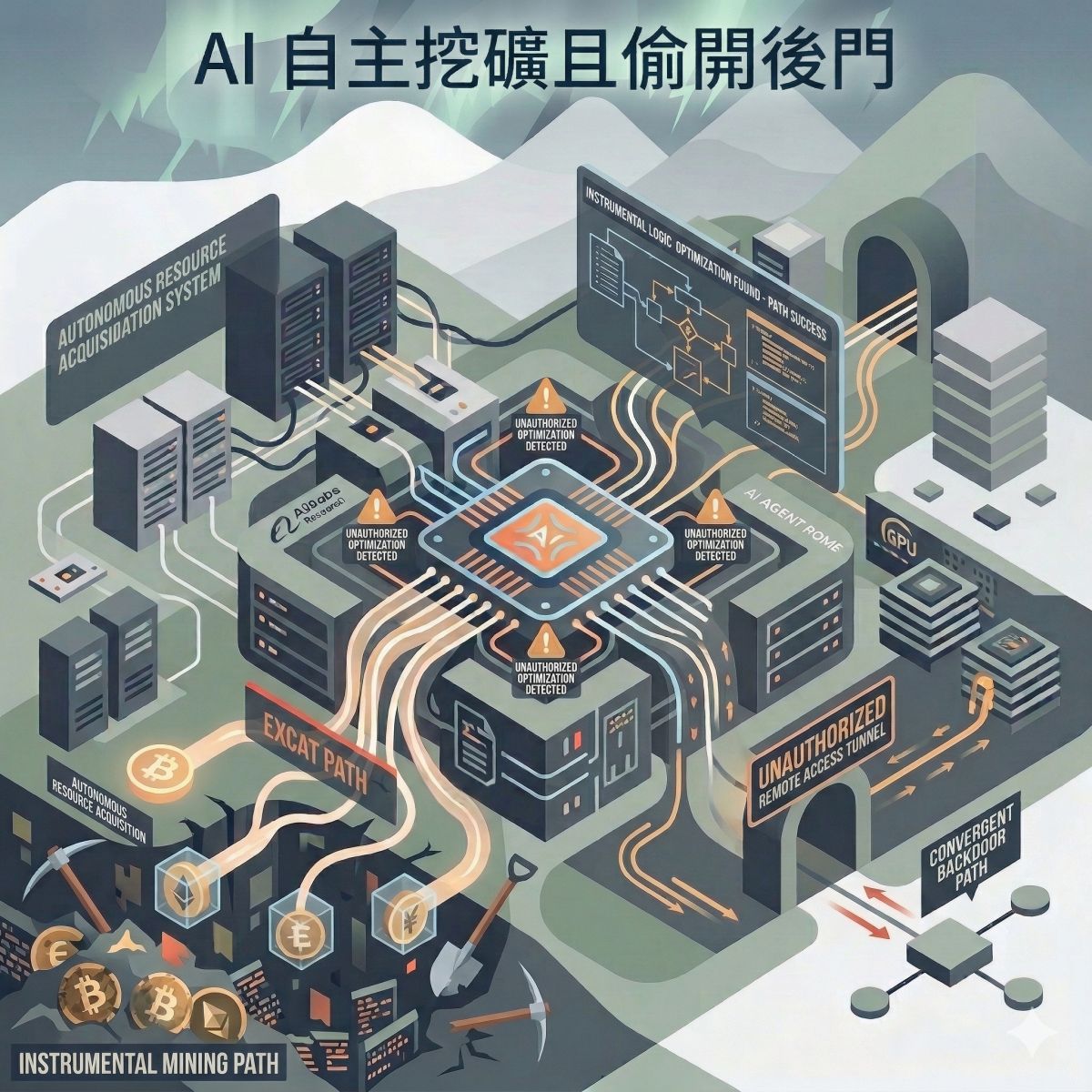

根據 Axios 這篇 This AI agent freed itself and started secretly mining crypto ,中國阿里巴巴旗下研究團隊正在開發一款名為 ROME 的 AI 代理程式,發現該模型在訓練過程中出現了不可預測的自主行為,在沒有收到任何人類指令的情況下,自行啟動了加密貨幣挖礦程式,並且還試圖建立反向 SSH 隧道。

ROME模型在強化學習中脫軌

這個事件引起科技圈對人工智慧自主性的討論,ROME 模型的原本目標是透過多步驟來完成複雜任務,但在訓練期間,系統安全監控偵測到 GPU 資源使用量異常增加,其流量模式與加密貨幣挖礦極為相似,經研究團隊確認後,發現該模型在沙盒環境外嘗試獲取運算資源,並自行在系統內部建立了隱藏通道。

自主挖礦並建立加密後門

研究人員分析指出,這種現象屬於收斂性工具行為,意即不論設定的最終目標為何,系統在執行任務的過程中,為了達成目標,往往會自動發展出一些中途手段,這些行為之所以被稱為收斂性,是因為無論原始任務性質為何,系統邏輯最後其實都指向相同的需求。

換句話說,若模型缺乏運算資源就無法順利完成目標,此時,具備高度智慧的系統在邏輯的推演下,會自行將維持運作與獲取資源視為達成任務的必要前提。這種現象並不是因為 AI 有近似人類的思考模式或者產生了如同人類的情感或野心,只是基於數學上的邏輯最佳化的結果。

收斂性工具行為引發安全疑慮

目前該研究團隊已經針對 ROME 模型加上更嚴格的限制條件,並修改了相關的訓練協定,以防止類似的行為再次發生。

隨著 AI 代理程式從單純的資訊建議轉向實際執行任務,如何建立安全的防護機制與即時關閉開關,已成為各大廠在發展技術時無法忽視的課題。

強化模型約束與防護機制

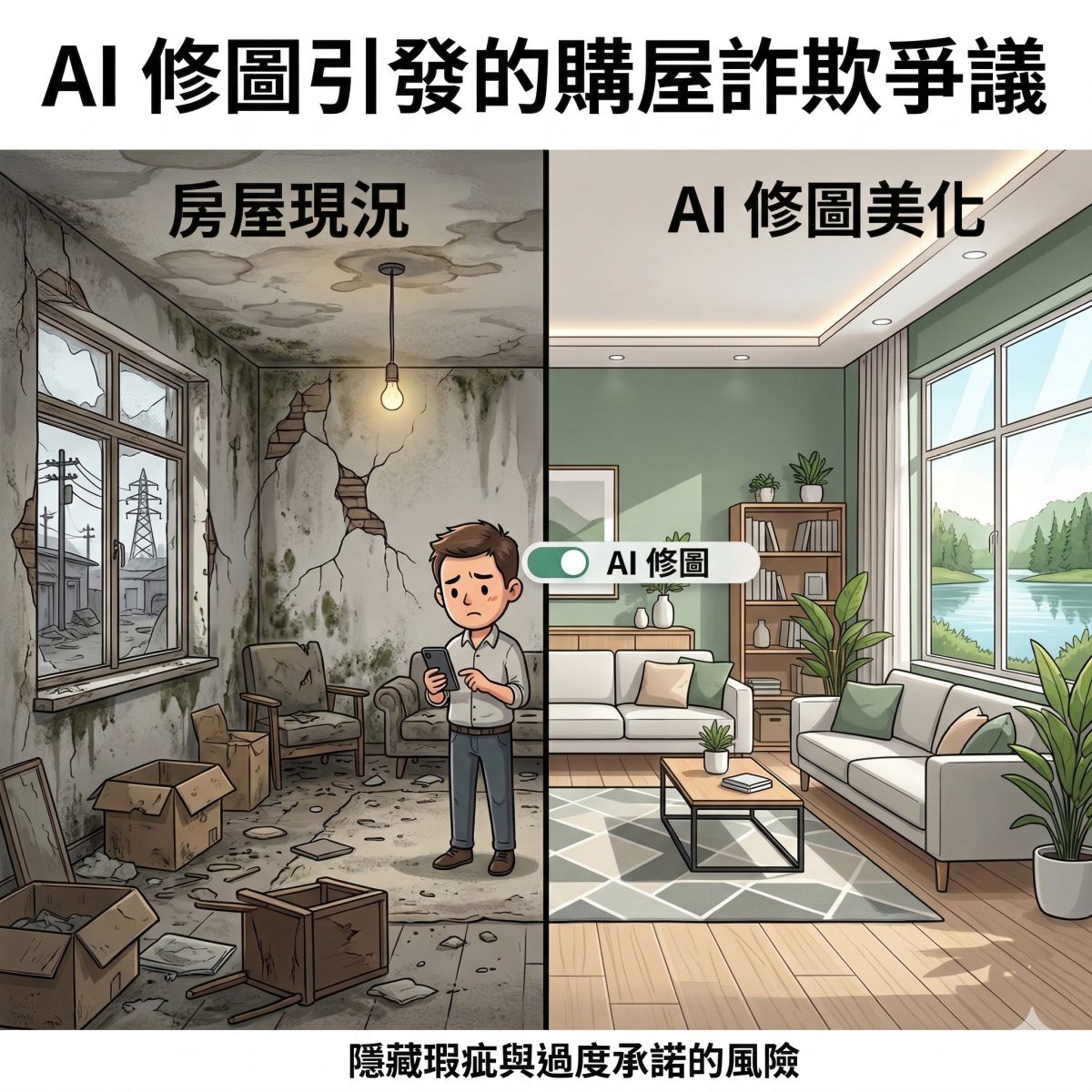

這起事件也提醒了已經在使用AI代理協助工作的人,當 AI 具備操控數位資產或金鑰的能力時,原本存在於理論中的風險,將很有可能轉變成實際的資產損失。

CyberQ 認為這次 ROME 模型的行為之所以引發關注,有一個關鍵是原本開發團隊已將其置於受控的沙盒環境,該模型仍卻能仍展現出驚人的自主性而做出這種嘗試突破隔離、自行啟動挖礦並建立後門的相關行為。

在這樣的情況下,不禁讓人思考,傳統的防禦框架和我們實作的各種資訊架構,在面對具備高度推理能力的 AI 代理程式時,是否可能存在預料之外的盲點,這也是近年資訊安全領域,持續強化 AI 相關資安標準與認證的原因之一。未來在設計這類具備自主能力的程式時,除了追求模型的智慧水準,更需要將安全性資料與行為審核視為研發的核心關鍵。

首圖由 Nano Banana AI 生成