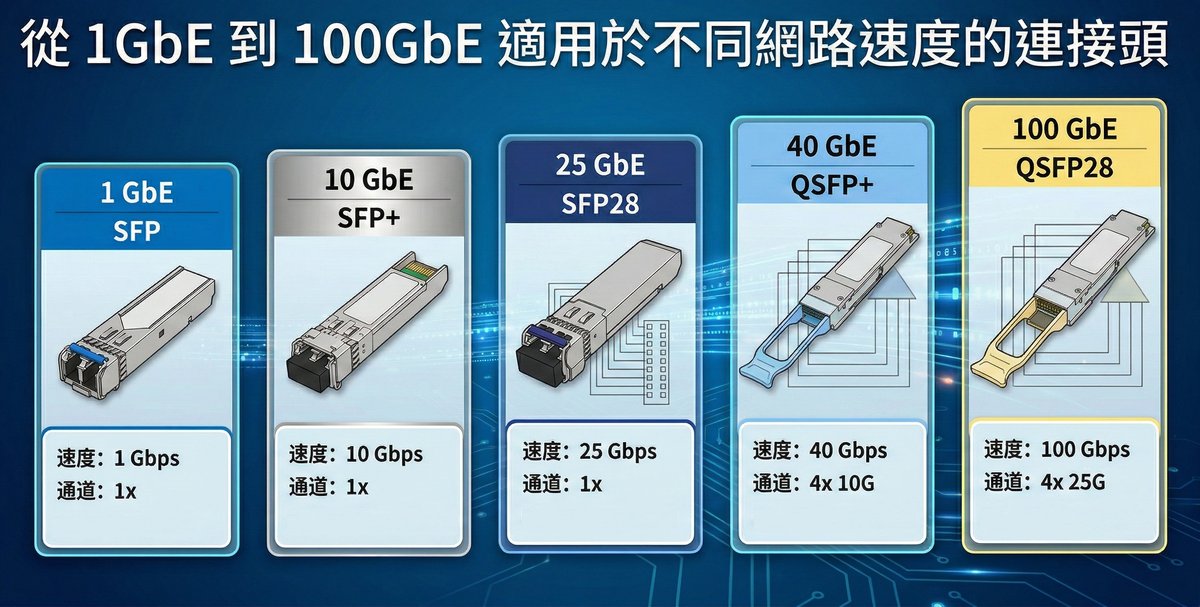

在人工智慧運算、大量資料分析以及高畫質影音剪輯的推波助瀾下,企業與高階實驗室的基礎架構正面臨著前所未有的頻寬考驗。當 10GbE 甚至 25GbE 逐漸成為基本標配時,為了滿足核心伺服器叢集、全快閃(All-Flash)儲存陣列的極致吞吐量需求,升級至 100GbE 已是不可逆的趨勢。

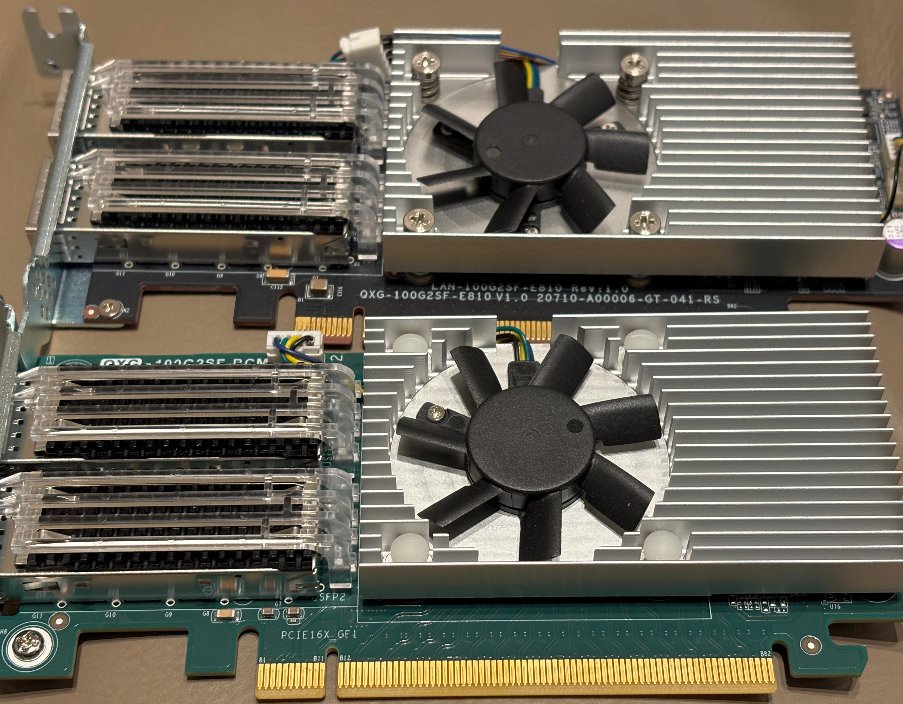

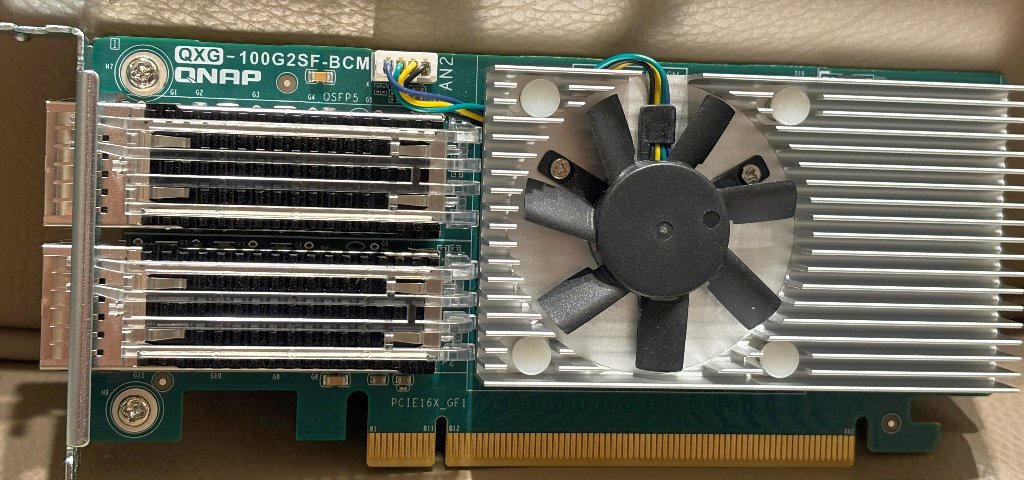

這次我們取得了兩張 QNAP 推出的 100GbE 雙埠網路擴充卡,分別是較早時期推出的 QXG-100G2SF-E810 與最新的 QXG-100G2SF-BCM,並搭配專屬的 QSFP28 DAC 纜線,來進行這些卡片在 PVE 虛擬化平台伺服器、NAS 檔案伺服器,以及高效能運算電腦上的實作。

Intel 與 Broadcom 晶片各有千秋

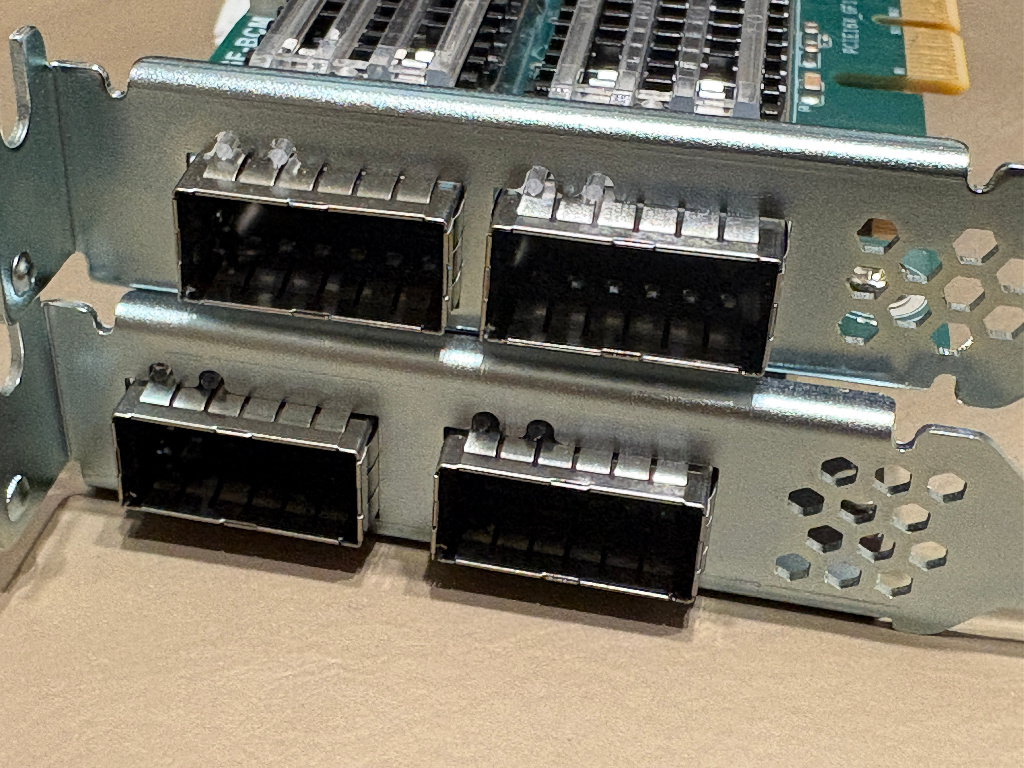

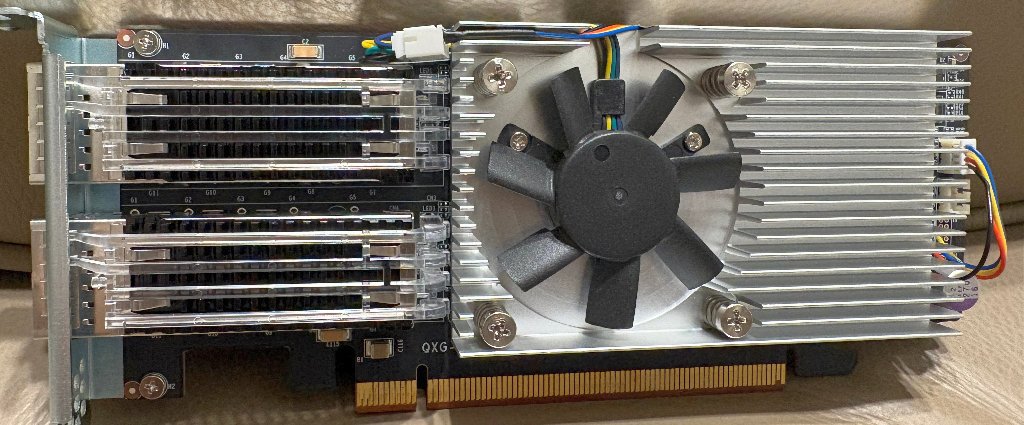

從外包裝與實體照片可以清楚看到,這兩張網卡皆採用了雙埠 QSFP28 介面設計,並透過高頻寬的 PCIe Gen 4 x16 匯流排,能提供單埠最高 100Gbps 的傳輸頻寬。這意味著在 Link Aggregation(鏈路聚合)的加持下,能為單一伺服器提供高速的 200Gbps 總頻寬。

在外觀與硬體設計上,兩張卡有鮮明的對比:

QXG-100G2SF-BCM 採用綠色 PCB 板設計,搭載 Broadcom BCM57508 網路晶片。Broadcom (博通)解決方案通常在封包處理的延遲與極限吞吐量上有著極佳的硬體卸載(Hardware Offload)表現,能輕易應對 I/O 密集型應用。

QXG-100G2SF-E810 採用黑色 PCB 板設計,核心搭載 Intel E810 (E810-CAM2) 控制晶片。Intel (英特爾)E810 晶片在業界以優異的虛擬化支援與穩定的 Linux 驅動相容性著稱,特別適合需要 iWARP/RoCEv2 支援的現代資料中心。

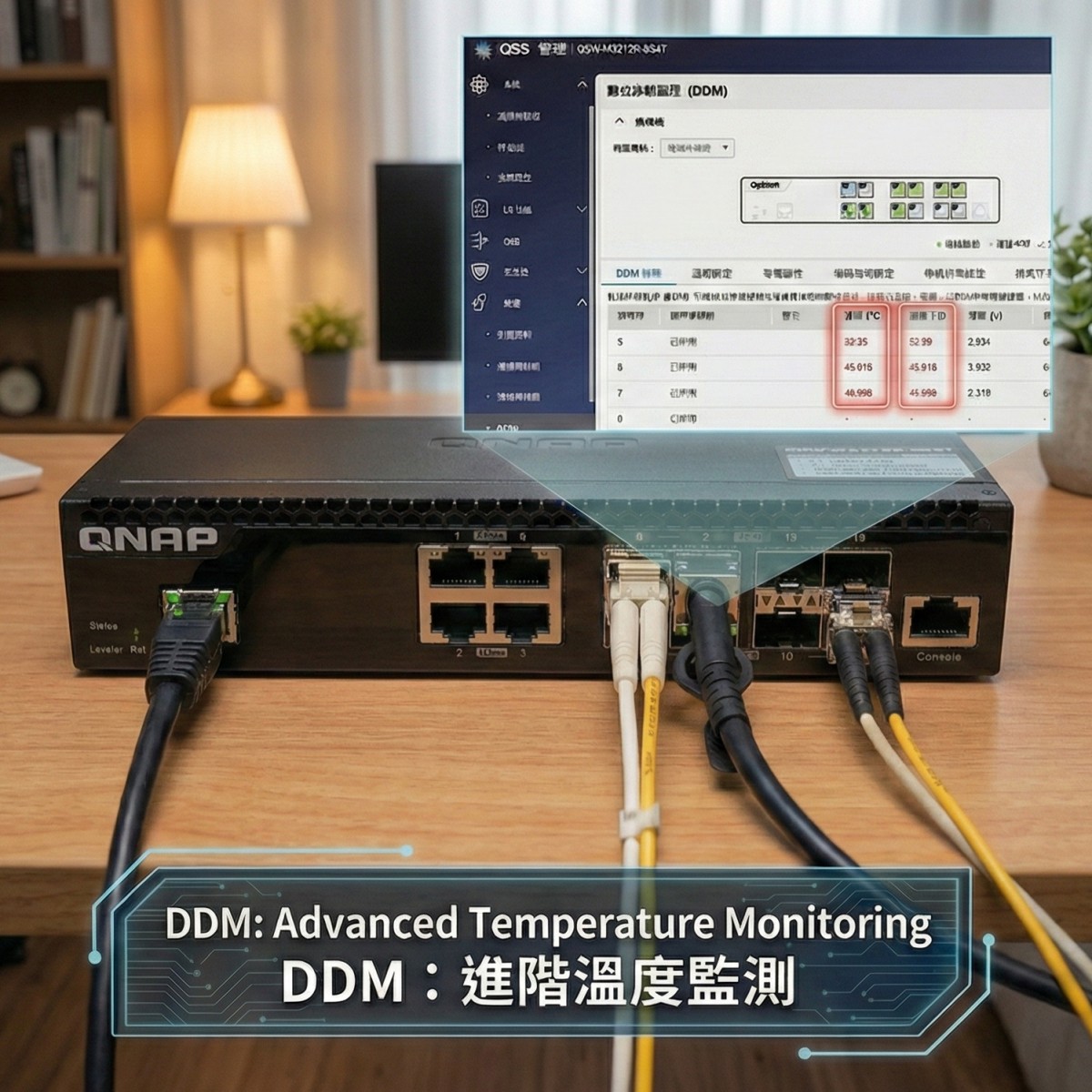

值得注意的是,100GbE 的網路晶片在全速運作時會產生較高的熱量,因此為確保長時間高負載下的穩定性,相關網路卡的做法都會設法進行主動散熱。而 QNAP 在這兩張卡上都配備了厚實的鋁擠散熱鰭片與主動式散熱風扇,對於將其部署在密集型伺服器或缺乏強力風道的儲存設備中,這樣的主動散熱設計是維持運作穩定、傳輸不掉速的關鍵。

連接採用 QSFP28 DAC 纜線

要讓 100GbE 網卡發揮實力,如同先前 CyberQ 這篇文章 升級 10GbE 需要的網路卡、SFP+ 模組與線材選購到 iPerf3 實測全攻略 提醒在 10GbE 環境選擇線材不容馬虎,而 100GbE 網路環境更是如此,線材也會比較昂貴。

這次搭配使用的是 QNAP 原廠的 CAB-DAC15M-Q28 銅纜(DAC),這是一條直徑較粗,長度為 1.5 公尺長的 QSFP28 100G DAC 線材(30AWG-LTK Dual Drain)。

它非常適合用於同一個機櫃內(Top-of-Rack)的伺服器與交換機對接,或是運算節點與高階 NAS 之間的直接連線(Direct Attach),也適用於 HA 雙機熱備援環境。相較於光纖模組(Transceiver)與光纖線的組合,DAC 線提供了延遲更低且更具成本效益的短距離互連方案,且運作溫度比較低。在目前大部分應用部署在機房的情況下,機房內通常是短距離,不跨櫃使用的話,這種 DAC 線就很適合使用;如果需要更長距離,就得使用光纖線搭配光纖模組。

系統解析 100GbE 與硬體卸載潛能

為測試 100GbE 網路卡在真實環境中的表現,CyberQ 將 QXG-100G2SF-BCM 與 QXG-100G2SF-E810 實際安裝於二台 QNAP NAS 、高效能 Linux 運算節點、Windows 平台工作站來進行對接實測。

NAS 端原生辨識與強大的 Smart Offload(智慧卸載)

從 QNAP NAS 端的「網路與虛擬交換器」介面截圖中可以清楚看到,系統不僅隨插即用、正確識別出 QXG-100G2SF-BCM 網卡,並顯示出 100 Gbps 的連線速度。

更值得注意的是資訊面板下方的「Smart Offload」欄位,清楚列出該網卡支援了 SR-IOV、RoCEv2、RoCEv1、RDMA 以及 iSER。這些進階的硬體卸載技術是發揮 100GbE 實力的靈魂所在。在 100Gbps 的超大頻寬下,若依賴傳統作業系統的 TCP/IP 網路堆疊,龐大的封包處理會瞬間榨乾伺服器的 CPU 算力。透過 RDMA(遠端直接記憶體存取)與 RoCEv2,網路封包能繞過 CPU 直接在伺服器與儲存設備的記憶體間進行資料交換。這不僅能讓端到端網路延遲驟降,更能將主機端的 CPU 負載降至極低,確保 NVMe 全快閃陣列的 IOPS 效能被徹底釋放。

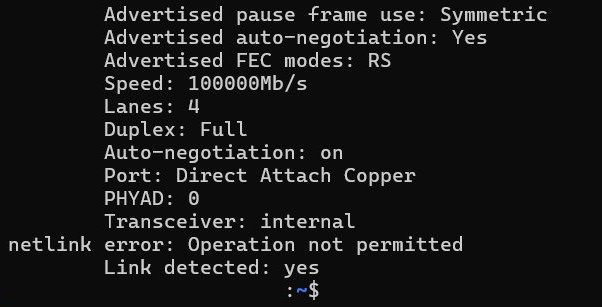

運算節點端:ethtool 底層鏈路狀態與 4-Lane 架構

在 Linux 運算節點端透過終端機執行 ethtool 指令,檢視實體層面的連線狀態。

極寬廣的協議相容性:在 Supported link modes 清單中,網卡不僅向下相容 1G/10G/25G/40G/50G,更完整涵蓋了 100000baseKR4/SR4/CR4 等各類底層傳輸模式,展現了高階控制晶片強大的處理餘裕與擴充彈性。

實體連線與除錯機制:在目前的 DAC 直連狀態下,ethtool 準確回報了 Speed: 100000Mb/s(100Gbps)與 Lanes: 4,QSFP28 介面其實是透過 4 條 25Gbps 實體通道併行傳輸達成 100G 的硬體架構。此外,連線端點正確識別為 Port: Direct Attach Copper(直連銅纜),並且底層自動啟用了 RS (Reed-Solomon) FEC (前向錯誤更正碼)。在 100G 的極端頻寬環境中,RS-FEC 能在硬體層有效修正資料傳輸過程中的位元錯誤,是確保巨量封包在銅纜上傳輸不掉速、不重傳的隱形功臣。

突破極限的實務效能

針對 100GbE 網卡的測試,要榨乾其真實頻寬,若僅使用單執行緒的 iperf3 進行跑分,往往在 25~40 Gbps 時就會遭遇單核 CPU 運算瓶頸。必須在測試參數中加入多執行緒指令(如 iperf3 -P 8 或 -P 16),在妥善調校 Jumbo Frame (MTU 9000) 的狀態下,這兩款網卡皆能穩定跑出 94 Gbps 至 97 Gbps 的無損線速(Line-rate)。

若將其應用於實戰,對接搭載 NVMe SSD 的全快閃 NAS 並啟用 iSER 協定,實際的大檔連續讀寫速度可輕鬆突破 10,000 MB/s 至 11,500 MB/s,進行傳輸一個 100GB 的 AI 訓練資料集或 8K RAW 影音素材,僅需不到15秒即可完成。

實戰應用加速虛擬化與先進檔案系統的連接

導入 100GbE 網路卡,最大的受惠者莫過於重度依賴網路儲存的現代化 IT 架構。

高可用性虛擬化叢集是主要適用的環境,對於運行 Proxmox VE (PVE) 或 VMware 的環境,虛擬機的高可用性(HA)遷移與分散式儲存(如 Ceph)的同步,極度依賴網路頻寬與低延遲。搭配前述支援的 SR-IOV 硬體直通技術分配,100GbE 能讓數十 GB 記憶體狀態的虛擬機在幾秒鐘內完成熱遷移,確保企業服務的零中斷。

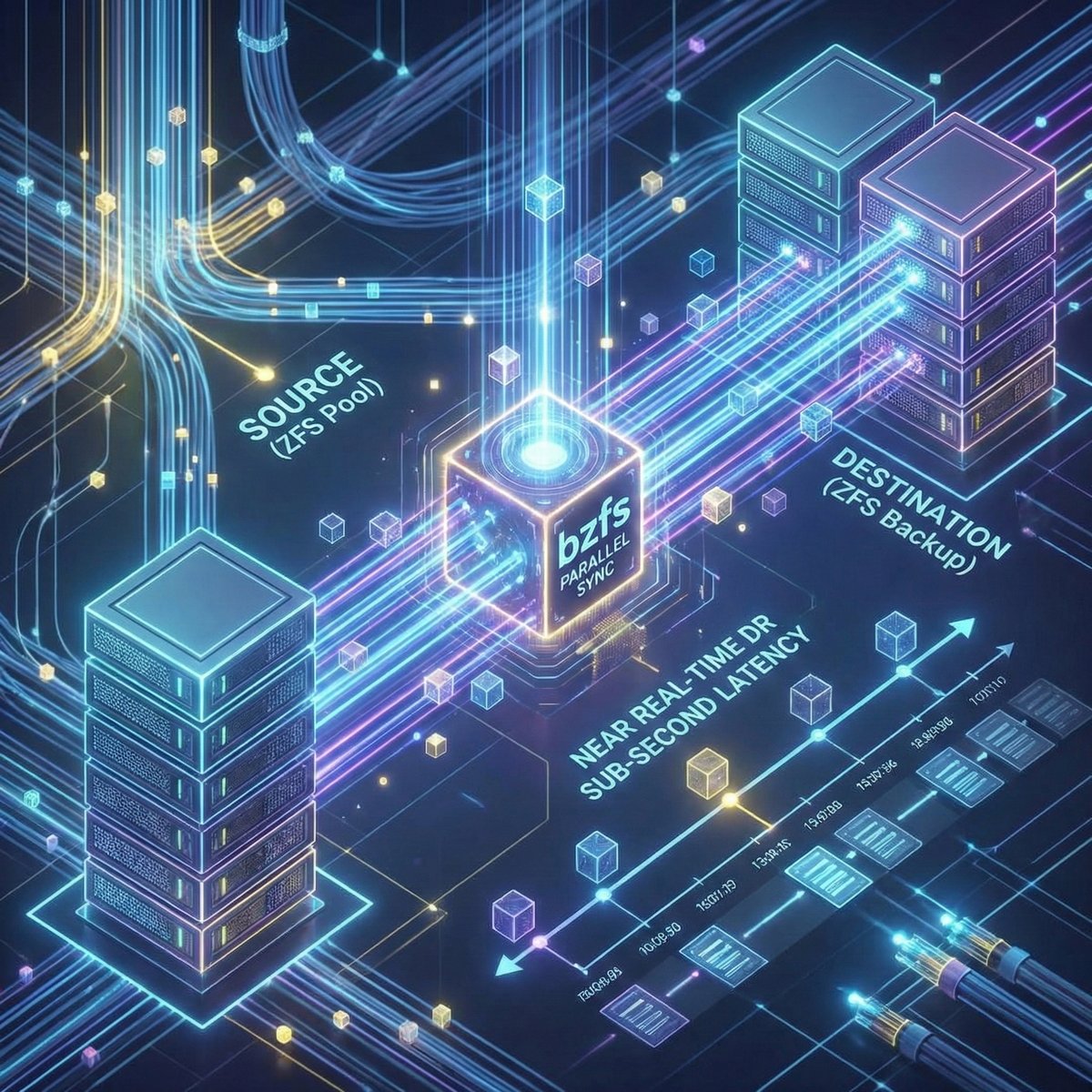

ZFS 儲存池的高速鏡像與備份在 100GbE 網路環境也很重要,在較大規模節點去定期執行 zfs send/recv 來進行異地備援或快照同步的日常任務中,或 QNAP HBS3 的大量備份任務清單,透過 100GbE 動輒達 9.x – 10 GB/s 的實體頻寬來處理,TB 級別的資料集同步時間將被大幅壓縮,讓資料備份不再成為系統日常運作的效能瓶頸。

容器化與微服務的極速載入,正如我們測試環境中的 Linux 節點,當伺服器上同時執行大量的 Docker 容器,且這些容器都需要頻繁從集中式儲存載入數十 GB 的 AI 大型語言模型(LLM)或龐大訓練資料庫時,100GbE 搭配 RDMA 卸載能徹底消除 I/O 等待時間,不讓昂貴的 GPU 處於等待資料的閒置狀態,這對於當前熱門的 AI 模型訓練與推論環境是有決定性幫助的。

效能釋放 NFS over RDMA (RoCEv2) 協定支援

CyberQ 實作也發現,除了傳統的網路傳輸,像 QXG-100G2SF-BCM 這類具備 RoCEv2 支援的高階 100GbE 網路卡,更能改變檔案系統的掛載體驗。對於以 Linux(例如 Ubuntu)作為運算節點的環境,可以直接在 QNAP 系統中啟用 NFS over RDMA 功能。有別於傳統 NFS 協定,RDMA(遠端直接記憶體存取)技術能讓封包徹底繞過耗資源的作業系統核心與 TCP/IP 堆疊,在設備之間進行端對端的直接記憶體存取。

根據實測,在掛載參數中加入 RDMA 協定後,不僅 Ubuntu 客戶端的 CPU 處理負載大幅降低,在 4K 隨機讀寫的 IOPS 表現上更能帶來超過 60% 的成長。對於講求極致低延遲的資料庫或伺服器而言,這項技術是值得優先進行的設定。

突破 I/O 瓶頸的關鍵升級

QNAP 這次推出的 QXG-100G2SF-BCM 網路卡,比 QXG-100G2SF-E810 的規格更新,透過提供兩種不同主流晶片陣營的選擇,可滿足企業在不同基礎架構下的相容性與效能需求。如果是用在 Linux 伺服器上,驅動程式支援都有最新的搭配不是問題。

若Windows Server 、Windows 11 等 Widnows 平台的話,就要下載對應的驅動程式來進行安裝,以英特爾版本的 QXG-100G2SF-E810 來說可以到 Intel 官方網站下載最新版驅動程式。這類 100GbE 網路卡在不同機器上實裝,有的需要原廠如 Dell、Broadcom 等網站的資源才能使用。

至於在 QNAP NAS 的使用是最主要的應用情境,在 QuTs Hero 作業系統中,系統會自動透過 App Centert 下載 Advanced Network Driver 套件來升級系統的網路卡驅動程式,自然會應對到 QXG-100G2SF-BCM 這張新的網路卡,而 QXG-100G2SF-E810 同樣也內建驅動程式的支援免擔心。

CyberQ 實作與測試,新款 QXG-100G2SF-BCM 網路卡的主動散熱設計、標準的 PCIe Gen 4 x16 介面,以及完整的硬體卸載支援(Smart Offload),很適合部署給伺服器與儲存設備。無論是升級現有的高階 All-Flash NAS、建構強悍的 Linux AI 運算伺服器,還是打造極速的後端儲存網路,這兩款網卡都能夠進行適當的部署。對於準備升級 10G/25G 頻寬天花板的 IT 管理者與技術應用工程師來說,這是很值得投資且能立竿見影的重要 IT 基礎建設升級。