近期,開源的自主 AI 代理框架龍蝦「OpenClaw」席捲了科技圈,不僅讓讓 AI 擁有電腦操控權成為現實,其帶動的本地端(Local)AI 部署狂潮甚至一度讓高階 Mac mini 賣到缺貨。然而,強大權限的背後卻隱藏著隱憂,近日全球逾 4 萬台 OpenClaw 系統因預設網路設定不當而暴露於駭客攻擊風險中。

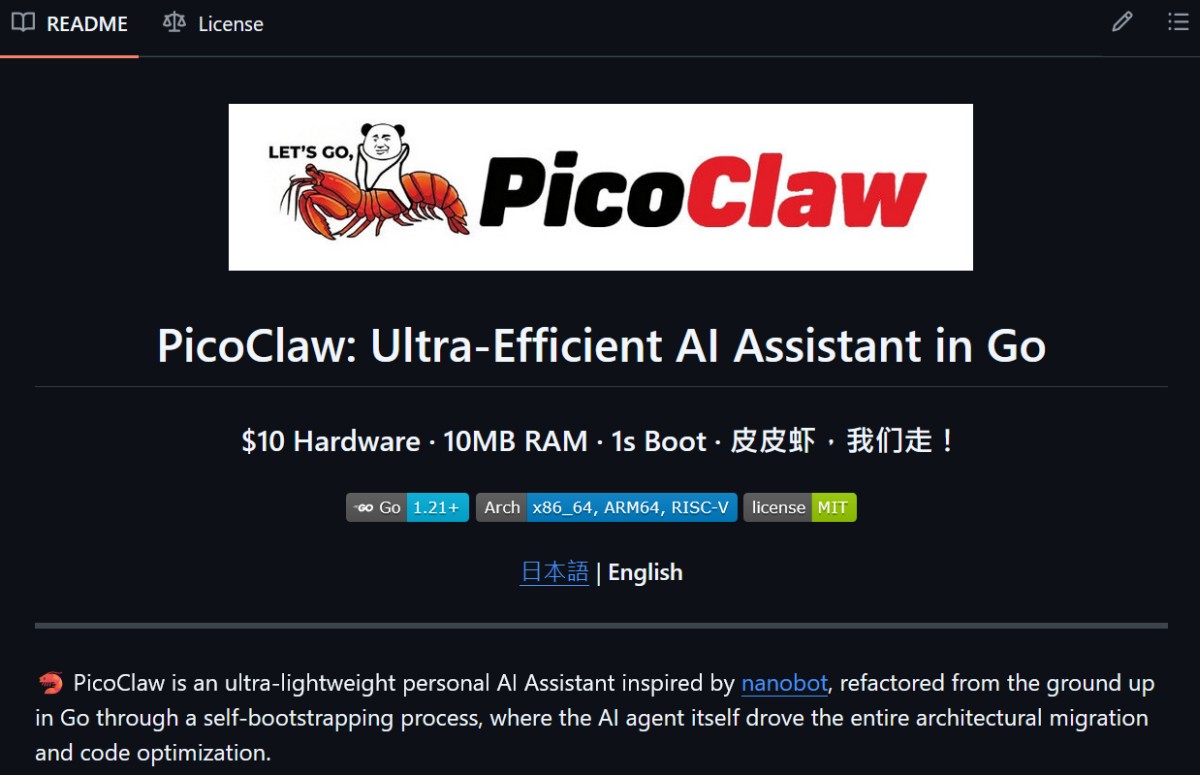

當市場還在爭論 OpenClaw AI 代理的便利性與資訊安全如何平衡時,Sipeed 在 GitHub 上推出了一個極具顛覆性的專案sipeed/picoclaw。這款標榜超輕量級的個人 AI 助手,正以一種截然不同的邊緣運算(Edge Computing)思維,重新定義市場對 AI Agent 的想像。

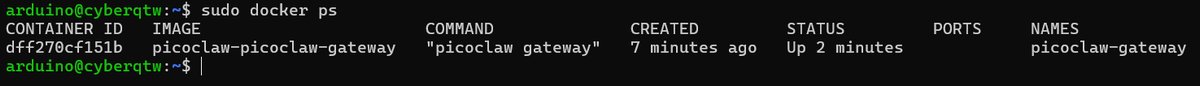

CyberQ 也做了 PicoClaw 在 Arduino Uno Q 開發版上的實測,是可以用 Docker 來部署的。

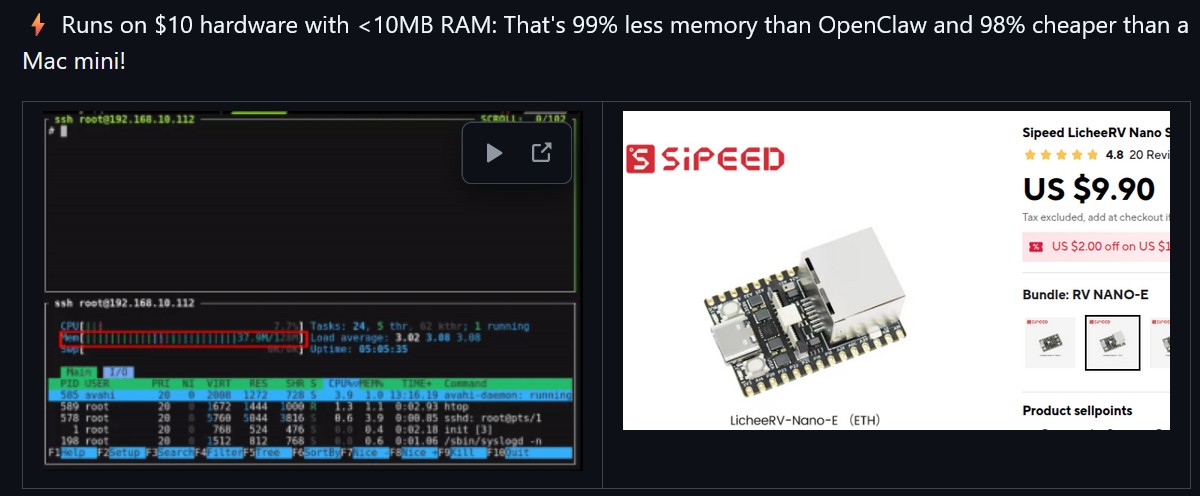

突破硬體枷鎖,只要 10MB 記憶體與 1 秒極速啟動

如果你曾經嘗試在本地端運行 AI 模型,以及本地端的 代理,一定深知其對 CPU、RAM 以及整體系統資源的龐大消耗。而 PicoClaw 的核心理念是極致的輕量化與低成本。

透過 Go 語言從零重構,PicoClaw 成功將常駐記憶體佔用壓縮至 小於 10MB,相較於傳統 OpenClaw 的核心功能,其資源消耗減少了驚人的 99%。這意味著,開發者不再需要動輒上千美元的設備,只需一塊市價約 10 美元 的單板電腦(SBC)或國產開發板,就能順暢運行專屬的個人 AI 助理。

PicoClaw 的核心技術指標:

極致輕量,單一獨立的二進位檔案(Binary),無繁瑣依賴。

極速啟動,即使在 0.6GHz 的低階單核處理器上,也能在約 1 秒內啟動,速度提升達 400 倍。

跨架構支援,原生支援 RISC-V、ARM 與 x86 架構,幾乎能部署在大部分的 Linux 設備上。

社群熱議 95% 由 AI 生成的魔法與實用性擴展

PicoClaw 在 GitHub 發布後,迅速在 Hacker News(Show HN)與開發者社群中引發熱烈討論。其中最讓程式開發者津津樂道的是其AI 自舉(Bootstrapping)過程,該團隊透露,PicoClaw 內部高達 95% 的核心程式碼,是由 AI 代理 Agent 自主生成與架構遷移的。這不僅是一次成功的工程實踐,更是「AI 開發 AI」的有趣範例。

在實用性方面,PicoClaw 巧妙地避開了大而全的盲點,專注於提供相對較小且彈性的模組化設計,我們就可以靈活地將其他平台的 LLM 透過 API 導入,支援透過 OpenRouter 呼叫各種先進的 AI 模型,同時還可以搭配其他在地化模型來推論使用。

它和 OpenClaw 一樣也支援多通訊閘道,支援 Telegram、Discord 等通訊軟體,使用者能在 2 分鐘內完成配置,直接與部署在邊緣設備上的 AI 進行對話。

PicoClaw 還內建實用工具,支援免費的 Brave Search API 進行網路檢索,並內建基於 Cron 表達式的定時任務系統(例如:輸入「每天早上 9 點提醒我」或「10分鐘後提醒我」),可滿足我們的日常自動化需求。

從資安與合規視角看物理隔離的優勢

從近期業界對於自主式 AI 代理的資安疑慮來看,PicoClaw 的出現恰好切中了一個關鍵的市場痛點。

傳統的 AI 代理(如 OpenClaw)通常安裝在使用者的主力工作機上,擁有讀取個人檔案、發送電子郵件與執行 Shell 指令的最高權限。一旦遭遇惡意 Prompt Injection(提示詞注入)或釣魚攻擊,機密資料極易無聲無息地外洩。

相較之下,PicoClaw 提供了一種符合「最小權限原則(PoLP)」與「零信任架構」的完美解法,採用硬體級別的物理隔離。將 AI 助理部署在便宜、獨立的 RISC-V 或 ARM 低功耗硬體上,不僅能作為智慧家庭或 IoT 節點的控制中樞,更能從物理層面將其與包含敏感商業資料的主力電腦隔離開來。這種「隔離執行」的策略,大幅縮小了攻擊面(Attack Surface)。CyberQ 認為,即便設備遭到入侵,損失也被嚴格侷限在該單一節點內。對於注重合規性與企業資安防護的環境而言,這無疑是一條更安全、更可控的 AI 落地路徑。

為什麼不能在邊緣設備直接跑模型?

從硬體物理限制來看,目前即使是極小的開源模型(例如 Qwen 1.5B 或 Llama-3 8B),要在本地端達到具備實用邏輯推理與呼叫工具(Tool Calling)的能力,通常也需要數 GB 甚至十幾 GB 的記憶體空間。

對於一台時脈僅 0.6GHz、記憶體可能只有 64MB 或 256MB 的低成本 RISC-V 或是 ARM 單板電腦(SBC)來說,直接載入並運行 LLM 是完全不切實際的。因此,PicoClaw 的策略是「放棄本地推理,專注於代理邏輯與環境控制」。

PicoClaw 的實際運作架構為端雲分離

PicoClaw 扮演的是一個高度最佳化過的輕量級通訊閘道(Gateway)與任務協調者,它的 10MB 記憶體主要用來處理以下工作:

通訊介接: 監聽 Telegram、Discord 或釘釘等通訊軟體的訊息。

排程與工具: 處理 Cron 定時任務、執行本地 Shell 指令、呼叫 Brave Search API 進行網路檢索。

上下文管理: 管理對話記憶(Memory)與組裝提示詞(Prompt)。

當需要進行「思考」時,PicoClaw 會將組裝好的上下文透過 API 傳送出去。目前它的設定檔(config.json)中原生支援:

OpenRouter: 開發者最愛用的聚合 API,可以自由橋接 Claude 3.5 Sonnet、GPT-4o 或是其他頂級大模型。

智譜(Zhipu): 針對需要連接在地化模型(如 GLM-4)的場景。

進階玩法:如何實現「完全不連外網」的純地端部署?

如果你偏好自建服務(Self-hosted)、注重極致的資訊安全,不希望對話資料上傳到公有雲 API,開源社群目前也正在推動讓 PicoClaw 支援 Ollama 等本地端 API 協定(例如 GitHub 上這個專案的 Issue #75 有討論到此功能)。

在實際的網路架構上,你可以採取「控制節點與運算節點分離」的策略:

將 PicoClaw 部署在極便宜的開發板或輕量級 Ubuntu 虛擬機上,或者是 QNAP NAS 中的 Ubuntu Linux Station 或虛擬機,作為前端的「實體隔離控制中樞」。然後將比較吃重的 LLM 推理運算(Inference)交給區域網路中算力強悍的設備來扛。例如,CyberQ 直接透過內網 API 呼叫架設在 NVIDIA DGX Spark 與配備 64GB RAM 和 NVIDIA RTX A2000 顯示卡的 QNAP TS-855X NAS 上跑本地端模型。

這樣做的優勢在於:

最小攻擊面: 對外(或對 IoT 設備)暴露的只有 PicoClaw 這個極精簡的節點。

資料不落地: 核心商業邏輯與對話資料絕對不會離開你的機房,完美符合資安合規要求。

資源極致分配: 高耗能的強大伺服器專心做矩陣運算,便宜的低功耗設備負責 24 小時長期待機與排程。

當 PicoClaw 遇上新世代 SBC,以 Arduino UNO Q 部署實戰為例

當看到 PicoClaw 標榜極致輕量、能在低成本硬體上執行時,許多硬體玩家(Maker)腦海中浮現的第一個疑問或許是:「那我手邊的 Arduino 可以跑嗎?」

如果是傳統的 Arduino Uno R3 或 R4,受限於微控制器(MCU)缺乏完整作業系統與記憶體極小的物理限制,確實無法直接運行。但如果手邊擁有的是新世代的 Arduino UNO Q(由高通與 Arduino 攜手打造的產品),這將是部署 PicoClaw 的絕佳實作。

為什麼 Arduino UNO Q 是完美載體?

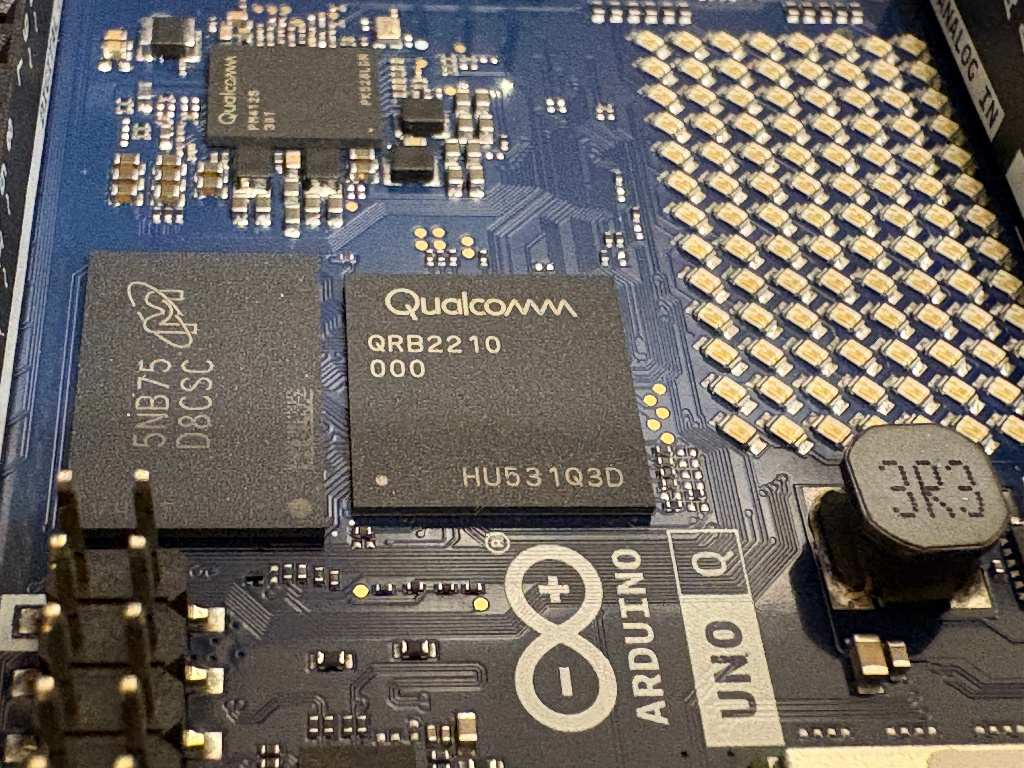

CyberQ 實測 Arduino UNO Q 來部署,嚴格來說,Arduino UNO Q 已經不再是單純的微控制器,而是一台具備強大 AI 加速能力與連網功能的單板電腦(SBC)。它搭載了高通 QRB2210 多核心 SoC、充裕的 2GB / 4GB LPDDR4X 記憶體以及 16GB 的 eMMC 儲存空間,還能夠掛載額外的 SSD,並能順暢執行具備 Xfce 桌面環境的 Debian Linux 以及容器(Container)技術。

這種一顆大腦,兩套神經系統的獨特設計,讓 PicoClaw 的部署很優雅:

大腦(Linux 核心部署),由於 UNO Q 具備完整的 Linux 環境,CyberQ 實測可以直接透過 SSH 連入,玉部署 PicoClaw 的 Go 語言編譯檔(Binary)部署在高通核心上。僅佔不到 10MB 記憶體的 PicoClaw 在這裡負責與外部的 LLM API(如 OpenRouter 或在地化模型)通訊、處理複雜對話邏輯以及執行 Cron 定時任務。

橋接(Bridge API 溝通),當 AI 代理判斷需要與實體世界互動時(例如:根據 API 抓取的天氣預報來改變燈號),PicoClaw 可以透過執行環境中的 Python 腳本,呼叫 UNO Q 專屬的 Bridge API。

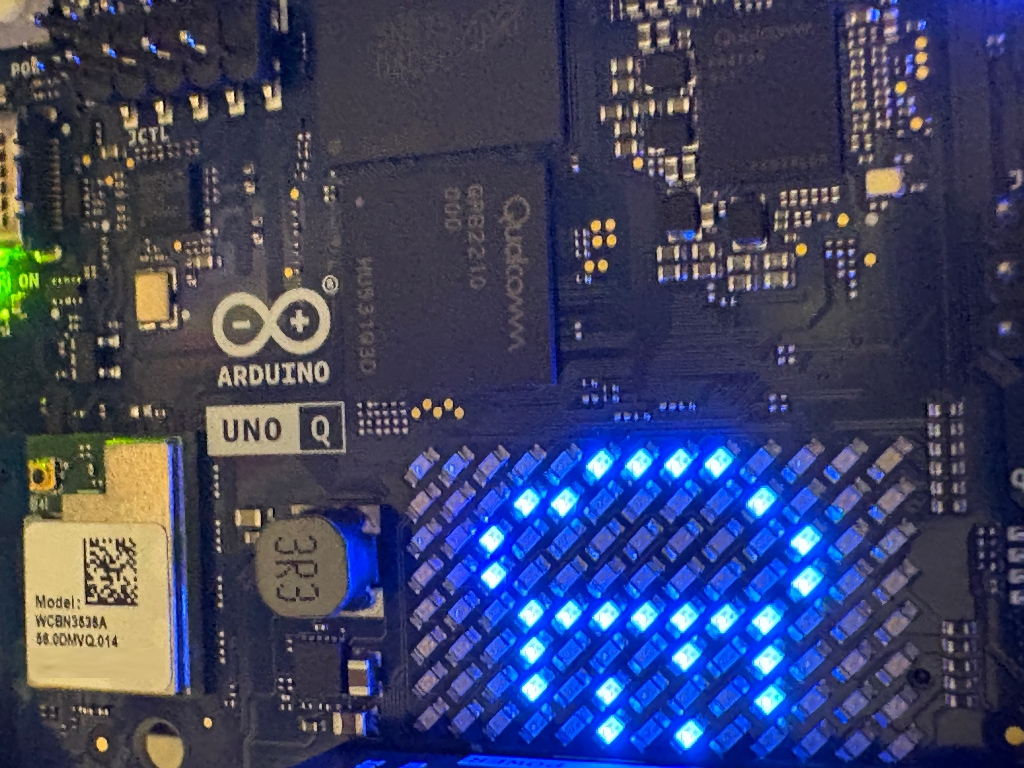

四肢(MCU 精準控制),指令透過 Bridge 瞬間傳遞給底層的 Renesas RA4M1 微控制器,由主機板上的 C++(.ino)程式碼接手,精準且零延遲地驅動板載的 12×8 LED 矩陣,或是控制外接的各種 IoT 感測器與作動機構。

PicoClaw 官方提供的安裝方式有兩種,第一種是直接 git 下來再直接 build 的部署方式:

git clone https://github.com/sipeed/picoclaw.git

cd picoclaw

make deps

# Build, no need to install

make build

# Build for multiple platforms

make build-all

# Build And Install

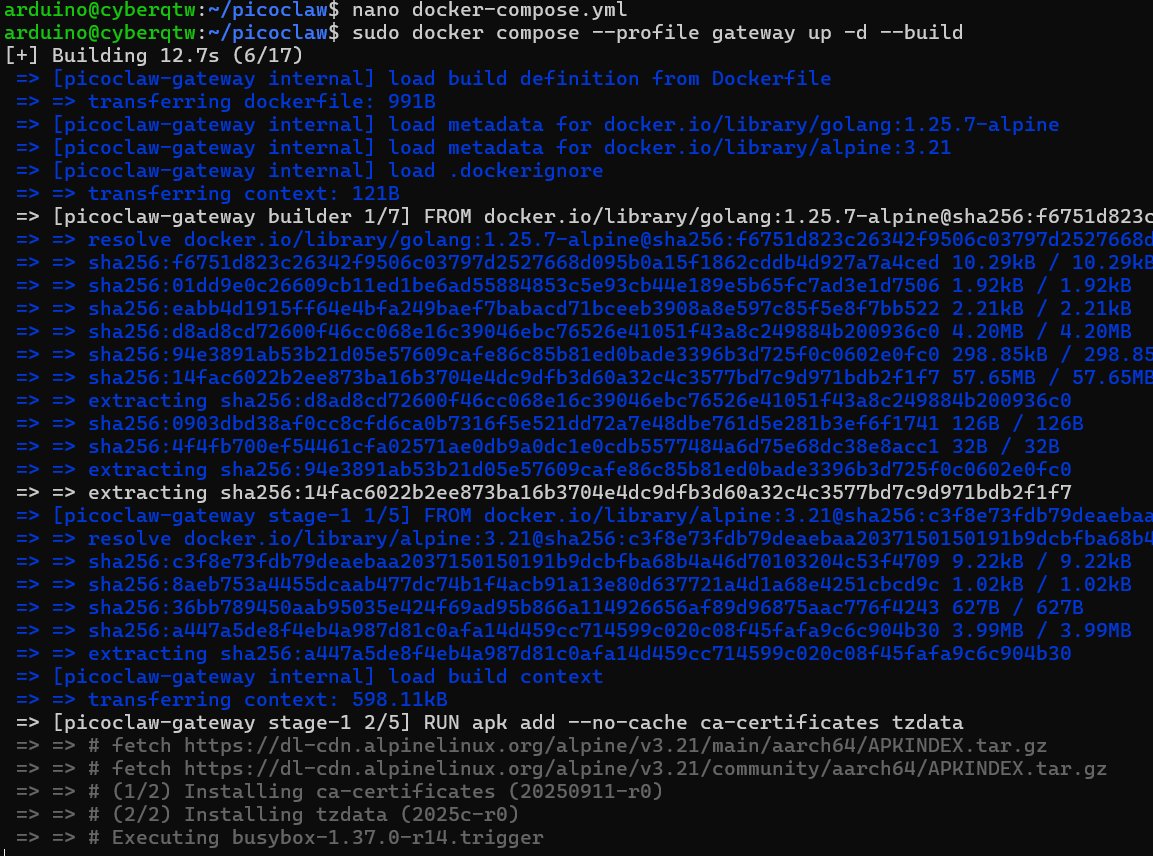

make install以及第二種則是用 Docker Compose 部署的方式 ,但也是要 git 下來後再 build docker 部署,好處是容器化 :

# 1. Clone this repo

git clone https://github.com/sipeed/picoclaw.git

cd picoclaw

# 2. Set your API keys

cp config/config.example.json config/config.json

vim config/config.json # Set DISCORD_BOT_TOKEN, API keys, etc.

# 3. Build & Start

docker compose --profile gateway up -d

# 4. Check logs

docker compose logs -f picoclaw-gateway

# 5. Stop

docker compose --profile gateway downAgent Mode (One-shot)

# Ask a question

docker compose run --rm picoclaw-agent -m "What is 2+2?"

# Interactive mode

docker compose run --rm picoclaw-agentRebuild

docker compose --profile gateway build --no-cache

docker compose --profile gateway up -dCyberQ 實測是用 Docker Compose yaml 來部署,考量其容器化的彈性,以及不會在 Linux 中 build 不小心把系統弄亂,同時也指定了映射硬體的 Arduino Uno Q 的 STM32 通訊做未來後續使用。

寫法如下 :

services:

# ─────────────────────────────────────────────

# PicoClaw Agent (One-shot query)

# 執行方式: docker compose run --rm picoclaw-agent -m "Hello"

# ─────────────────────────────────────────────

picoclaw-agent:

build:

context: .

dockerfile: Dockerfile

container_name: picoclaw-agent

profiles:

- agent

volumes:

- ./config/config.json:/root/.picoclaw/config.json:ro

- picoclaw-workspace:/root/.picoclaw/workspace

entrypoint: ["picoclaw", "agent"]

stdin_open: true

tty: true

# UNO Q 硬體映射 (確保在單次除錯時也能呼叫硬體 Tool)

devices:

- "/dev/ttyS1:/dev/ttyS1" # 依據實際 STM32 通訊埠調整

# ─────────────────────────────────────────────

# PicoClaw Gateway (Long-running Bot)

# 執行方式: sudo docker compose --profile gateway up -d --build

# ─────────────────────────────────────────────

picoclaw-gateway:

build:

context: .

dockerfile: Dockerfile

container_name: picoclaw-gateway

restart: unless-stopped

profiles:

- gateway

volumes:

# Configuration file

- ./config/config.json:/root/.picoclaw/config.json:ro

# Persistent workspace (sessions, memory, logs)

- picoclaw-workspace:/root/.picoclaw/workspace

command: ["gateway"]

# --- UNO Q 專屬環境與硬體最佳化 ---

devices:

- "/dev/ttyS0:/dev/ttyS0" # 預留映射底層給 STM32 通訊 (Primary)

- "/dev/ttyS1:/dev/ttyS1" # 預留映射底層給 STM32 通訊 (Secondary)

environment:

- TZ=Asia/Taipei # 校正 Agent 內部時間,確保 Log 與排程時間準確

logging:

driver: "json-file"

options:

max-size: "10m"

max-file: "3" # 限制 Log 總大小不超過 30MB,保護 eMMC 寫入壽命

volumes:

picoclaw-workspace:nano docker-compose.yml 修改存檔後,直接執行以下指令讓 Docker 重新載入設定並重啟常駐服務:

sudo docker compose –profile gateway up -d –build

Build 完 docker image 大概要 5 分多鐘,之後就是設定一連串 PicoClaw 的使用,概念和 OpenClaw 是類似的,CyberQ 除了雲端 AI API 資源導入外,也有使用本地端 QNAP NAS 上跑的 Ollama、以及 NVIDIA DGX Spark 上的大語言模型來做搭配使用,可省掉寶貴的 token 費用。

在 PicoClaw 的主程式或 Agent 初始化區塊中,如果將我們另外寫好程式的 Schema 與 Handler 註冊進去。當你在 Telegram 傳送:「我現在心情有點糟,板子可以給我一點鼓勵嗎?」

這種範例中,寫程式來做一個互動的數位應用,讓 UNO Q 面板 的 LED 矩陣可以顯示指定的圖形,PicoClaw 搭配 Arduino Uno Q 的運作流程將會是:

LLM 分析語意,決定呼叫 control_unoq_led_matrix 工具,並自動傳遞 {“pattern”: “heart”} 或 {“pattern”: “smile”} 的 JSON。

Go 程式攔截並驗證參數。

透過 Docker 映射的 /dev/ttyS1 將指令傳給 STM32 MCU。

UNO Q 面板亮起愛心,隨後 LLM 在 Telegram 回覆:「已經在板子上點亮一顆愛心了,希望你心情好一點!」

透過容器化部署加上嚴謹的工具介面設計,我們以非常安全且高效地將這塊強大的 Edge AI 開發板轉變為具備實體互動能力的 AI 代理核心。

邊緣運算的典範轉移,推動 AI 繼續普及的道路

CyberQ 認為,PicoClaw 的誕生,不僅僅是程式碼體積的縮小,它代表著一種全新的市場趨勢,AI 不只是只存在於雲端巨頭的機房,或極少數高階運算設備中。它能在 10MB 記憶體、10 美元的極低階硬體上流暢運作,正是因為它巧妙地將推理與執行分開。

過去我們在部署 AI Agent 時,往往需要一台樹莓派或迷你電腦作為主控端,再用傳輸線外接一塊 Arduino 作為執行端。而 Arduino UNO Q 有不錯的新單板電腦混合架構,直接在一張比信用卡大不了多少的板子上,我們能有優於以往的協同實作。透過將軟體架構做到精簡,PicoClaw 成功 AI Agent 下放至新台幣幾百元到一千多元的低成本硬體中,讓 AI 代理應用能更普及。

對於關注 AI 落地應用與效能實測的開發者、物聯網開發者、資安研究人員,或是想親手打造無隱私疑慮專屬助理的科技愛好者來說,將輕量的 PicoClaw 與內建高通算力的 Arduino UNO Q 結合,不僅大幅縮減了實體部署的體積,更是將「AI 賦能實體硬體」的潛力做更多的發揮。這絕對是今年邁向 Agentic AI 與機器人新時代,最值得動手實作的專案之一。