Google DeepMind 近期發布了 Gemini 應用程式中一項重大的功能升級。之前我們有做過這篇報導 :

繼續深入探究這次更新的重點,是解決長期以來 AI 圖片編輯在修改人物或寵物照片時,普遍存在的「樣貌失真」問題。透過更先進的上下文理解與生成能力,新模型讓使用者能以自然語言進行精細、多輪的圖片編輯,同時確保主體(如人臉、寵物特徵)的高度一致性,吸引了全球大量的開發者與用戶持續在 Google Gemini AI 平台和 Imagen4 平台上使用。

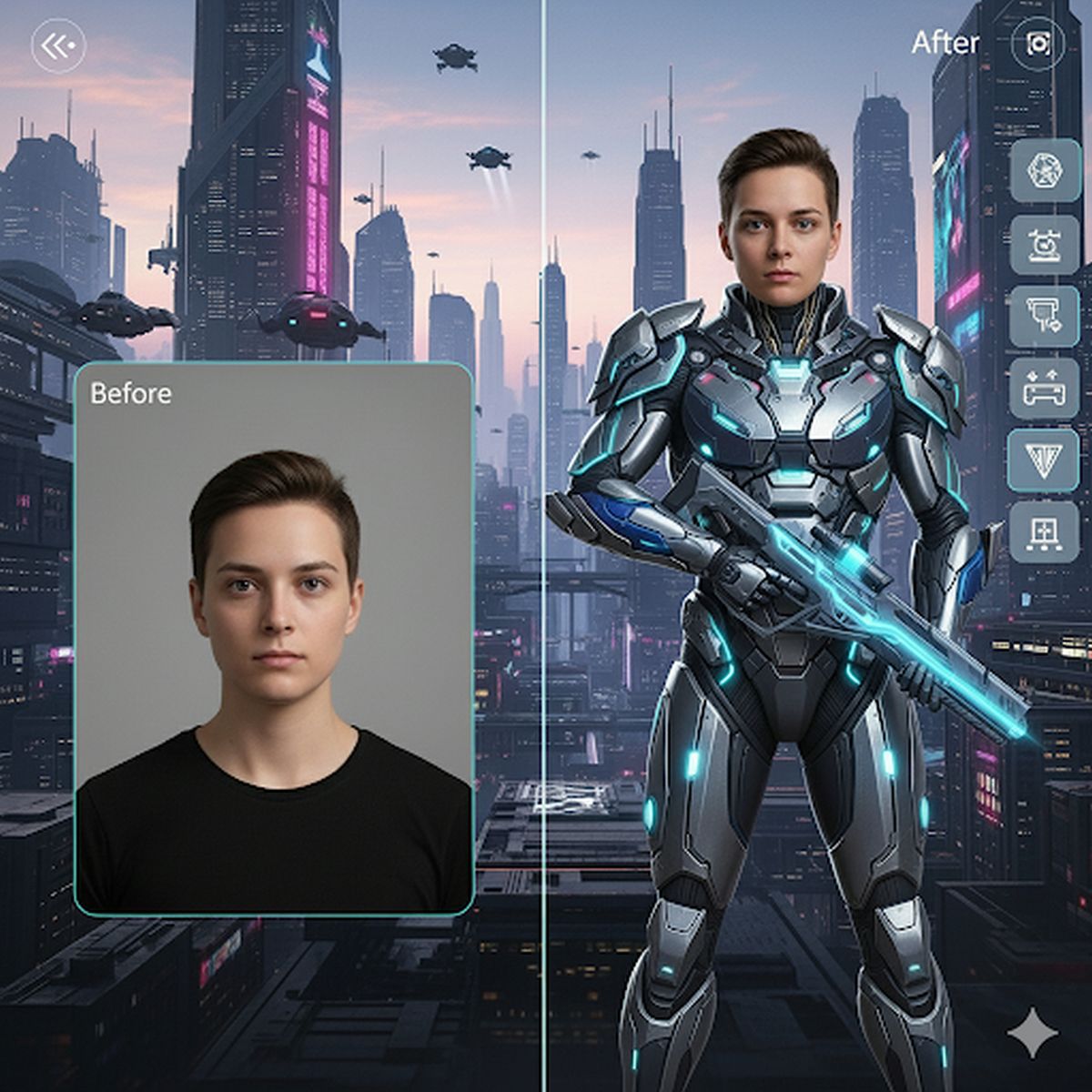

很多開發者只要付費使用 Gemini 圖像生成 Api ,就可以做出很好用的衣服試穿網站、AI 換臉、AI 專業肖像照合成等多種網站或 App 服務,基於 Google Gemini Api 的產業端圖片應用也正蓬勃發展。

核心技術突破:維持「外觀一致性」

過去,使用者在利用 AI 工具為照片中的人物更換服裝或背景時,常會發現主角的臉部特徵或神韻也跟著產生微妙、甚至明顯的變化,生成結果「相似,但又不完全是同一個人」。Google 這次更新的關鍵技術突破,便在於維持樣貌的一致性 (Appearance Consistency)。

使用者現在可以透過 Gemini 執行以下複雜的編輯任務,而無需擔心主角失真,還可以將特定人物或寵物的照片,無縫置入全新的場景,例如把一張在客廳拍攝的寵物照,背景更換為「正在外太空漫步」;或為人物「換上一套未來感的盔甲」、「將直髮換成捲髮」等。模型更支援將不同照片中的人物或寵物提取出來,能將多張不同照片自然地融合到同一張新的圖片中,創造出全新的合照。使用者還能上傳一張參考圖片,將其獨特的藝術風格(例如油畫的筆觸、特定電影的色調)應用到自己想要編輯的照片上。

操作流程革新:多輪對話式編輯

除了生成品質的提升,Gemini 在人機互動流程上也進行了革新,引入了多輪對話式編輯 (Multi-turn, Conversational Editing) 的概念。這徹底改變了傳統圖片編輯軟體需要精通複雜工具欄的模式,也超越了多數 AI 工具「一次性 Prompt 指令」的限制,其工作流程更接近與一位專業設計師的溝通,使用者上傳圖片後,可以透過下達語言指令對圖面進行局部編輯,例如「把這件藍色外套拿掉」。

在 Gemini 產生初步結果後,使用者可以繼續下達一系列的追問指令來進行微調,例如「幫他穿上一件黑色皮夾克」、「讓夾克看起來舊一點,多點磨損痕跡」、「背景加上下雨的街景」,模型會理解上下文,持續在同一張圖片上進行疊代修改。這種對話式的流程,極大地降低了專業影像編輯的門檻,讓普通使用者也能透過簡單的口語化指令,完成精細的創意修改。

AI 倫理與透明度實踐

面對生成式 AI 內容可能被濫用的疑慮,Google 在此次更新中也強調了其在責任與透明度上的實踐。所有透過 Gemini 應用程式建立或進行大幅度編輯的圖片,都會被嵌入兩種標記:可見浮水印(在圖片上直接加入標示,表明其為 AI 生成)、SynthID 數位浮水印(一種嵌入在圖片像素中,肉眼無法察覺的數位浮水印,能更穩定地標示其來源,即便經過裁切或壓縮等修改,仍有機會被偵測)。

CyberQ 觀點 : 精準編輯將帶來業界的改變

Gemini 此次的影像編輯功能升級,不僅僅是單點的技術展示,它更揭示了未來 AI 工具發展已經從「生成」到「精準編輯」,AI 的能力正從天馬行空的「無中生有」,進化到能理解並精準修改現有內容的細節,這使其在專業工作流程中的實用性大幅提升,強大的 AI 功能正被直接整合進使用者熟悉的應用程式與對話介面中,透過自然語言取代複雜的專業操作。

隨著這類技術的成熟,它將對內容創作、廣告行銷、個人娛樂等領域將產生深遠的影響,傳統影像處理軟體的工作流程與市場格局,也可能因此迎來新的變革。

首圖採用 Google Gemini AI 生成